検索API対ナレッジサプライチェーン: AIデータインフラストラクチャガイド

Sora Fujimoto

AI Solutions Architect

TL;DR

- 検索APIツールは、迅速な発見に役立ちますが、本格的なAIシステムのすべてのニーズを満たすわけではありません。

- 知識サプライチェーンには、発見、抽出、検証、保存、調整、モニタリングが含まれます。

- SERP APIは順位付けられた検索結果を収集するのに役立ち、ウェブスクレイピングAPIはページレベルのコンテンツを収集します。

- 強力なウェブデータインフラストラクチャは、新鮮さ、ソースの質、監査可能性、ポリシーに配慮した収集に依存します。

- AIデータパイプラインは、取得とパース、拡張、ガバナンス、および下流のモデル使用を接続する必要があります。

- 承認された自動化の場合、検証ステップが収集フローを妨げる場合、信頼性レイヤーが必要になることがあります。

はじめに

簡単な答えは、検索APIは取得インターフェースであり、知識サプライチェーンはAIデータインフラストラクチャの運用モデルです。この記事は、現在のウェブデータを取得しながら品質やコンプライアンスを失わないAIエンジニア、テクニカルファウンダー、SEOチーム、データプラットフォーム構築者向けです。検索インターフェース、SERP API、およびより広範なウェブデータインフラストラクチャスタックの間で選択する際、正しい決定はリスク、新鮮さ、および下流の使用に基づきます。コアな価値は実用的な明確さです。各オプションが適合する場所、破綻する場所、そしてより信頼性のあるAIデータパイプラインを設計する方法がわかります。

検索APIと知識サプライチェーンの紹介

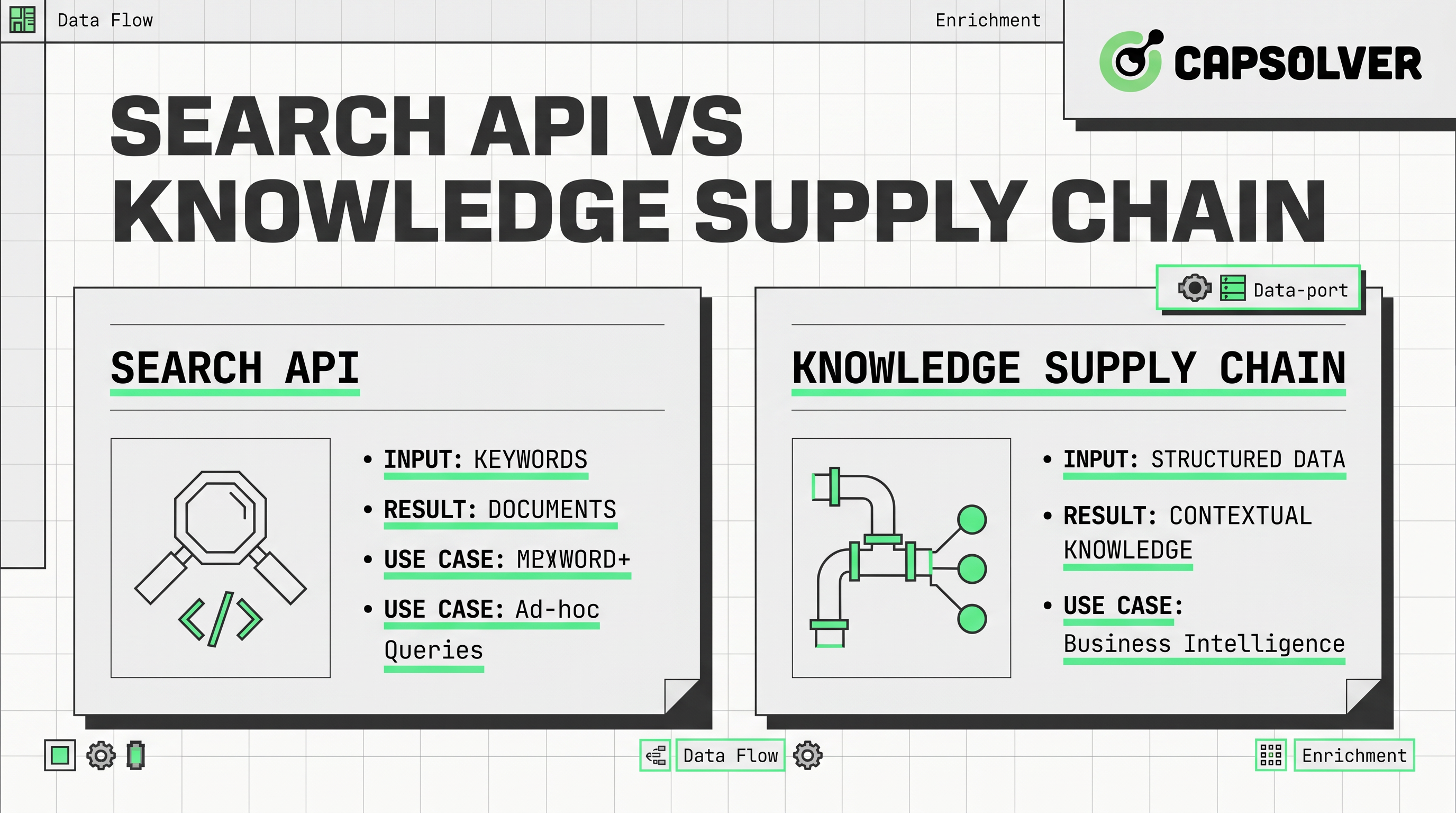

主な違いはアーキテクチャにあります。検索APIは通常、クエリを受け取り、インデックスから順位付けられたリンク、スニペット、または要約された結果を返します。これにより、チームが迅速な答え、軽量な拡張、または初期段階のプロトタイプが必要な場合に魅力的になります。

知識サプライチェーンは設計上より広範です。AIのデータ取得を、ソース発見から収集、検証、保存、変換、配信までの継続的なフローとして扱います。このモデルはエージェントシステム、マーケットインテリジェンスツール、繰り返し可能な意思決定をサポートする取得レイヤーに適しています。

この違いが重要である理由は、AIシステムが受け取ったものを基に動作するからです。NIST AIリスク管理フレームワークは、信頼できるAIが設計、開発、使用、評価の実践に依存していることを説明しています。実際には、取得レイヤーがリスク表面の一部です。

もう一つの理由はポリシーです。Google Search Centralは、robots.txtが主にクローラーのトラフィックを管理するために使用され、コンテンツを隠すための万能な方法ではないと述べています。この注意喚起は、ウェブデータインフラストラクチャを構築するあらゆるチームにとって重要です。コンプライアンスは最初のリクエストの前に始まります。

データ取得システムにおける検索APIの動作

最も単純な説明は、検索APIが発見レイヤーに位置することです。テキストクエリを順位付けられた結果に変換し、チャットボット、コピロット、またはリサーチアシスタントにフィードします。

ほとんどの検索ツールは、スピードと開発者向けの利便性を最適化しています。これは通常、インデックス済みデータ、キャッシュされた結果、または事前に構築された関連性レイヤーを意味します。低リスクのタスクではこれで十分です。サポートボット、SEOのアイデアツール、またはプロトタイプエージェントは、システムが深い証拠よりも方向性が必要な場合にこの種の取得エンドポイントをよく利用します。

SERP APIは狭義です。検索エンジン結果ページと関連する結果要素に焦点を当てています。これは、順位トラッキング、クエリモニタリング、および競合SEOリサーチに役立ちます。しかし、SERP APIは依然として検索レイヤーを反映しており、完全なコンテンツレイヤーではありません。システムが実際のページテキスト、構造化フィールド、または歴史的比較が必要な場合、通常は別のステップが必要です。

ここでは、発見と知識の混同が起こります。発見はどこを調べるかを示します。知識は実際にそこに存在するものを取得、解析、確認する必要があります。検索エンドポイントは最初の部分を補助しますが、AIデータパイプライン全体を完了しません。

AIアーキテクチャにおける知識サプライチェーンとは何か

より良い定義は運用的です。知識サプライチェーンは、オープンウェブからモデル、エージェント、アナリスト向けの意思決定可能なコンテキストにデータを移動するシステムです。

サプライチェーンの概念は最近の業界記事で頻繁に登場しますが、多くの記事は比喩で止まります。実用的なバージョンには6つのレイヤーがあります。最初は検索インターフェース、SERP API、フィード、サイトマップ、または既知のソースを通じた発見です。2番目はウェブスクレイピングAPI、ブラウザオートメーション、または直接のソースコネクタを通じた抽出です。3番目はHTML、JSON、PDF、メタデータを一貫した記録に変換する正規化です。4番目は新鮮さ、重複、所有権、ソース品質をチェックする検証です。5番目は検索のための保存とインデックス化です。6番目はAIデータパイプラインが結果をRAGシステム、評価者、またはエージェントツールに送る調整です。

モデルコンテキストプロトコルはここでの有用なヒントを提供します。MCPドキュメンテーションは、AIアプリケーションをデータソース、ツール、ワークフローに接続するオープン標準として定義しています。これは検索レイヤーを置き換えるものではありませんが、知識サプライチェーンが取得を超えるインターフェースを含む理由を示しています。

要するに、検索APIはツールです。知識サプライチェーンはシステムです。

検索APIと知識サプライチェーンの主な違い

最も明確な答えは運用制約にあります。検索APIは通常、高速検索に最適化されています。知識サプライチェーンは、実際の作業負荷下でのデータ品質に最適化されています。

比較要約

| 次元 | 検索API | SERP API | 知識サプライチェーン |

|---|---|---|---|

| 主な仕事 | クエリベースの発見 | 検索結果の収集 | AIのためのエンドツーエンドデータ取得 |

| 一般的な出力 | リンク、スニペット、要約 | 順位付けられたSERP要素 | 完全なコンテンツ、メタデータ、履歴、検証 |

| 最適な用途 | プロトタイプ、アシスタント、軽量なリサーチ | SEOモニタリング、結果のトラッキング | エージェント、インテリジェンスシステム、本格的なAI |

| 新鮮さのコントロール | 制限されており、プロバイダーに依存 | 検索レイヤーで中程度 | 直接収集と組み合わせると高くなります |

| 証拠の深さ | 低〜中 | 低〜中 | 高 |

| ガバナンスの適合性 | 制限されています | 中程度 | 強い |

| AIデータパイプラインでの役割 | 最初のステップ | SERPに焦点を当てた最初のステップ | 複数ステップの運用モデル |

現在の記事における競争的なギャップは実用的なガイドラインです。多くの投稿は検索ツールが高速であることを説明し、知識サプライチェーンが戦略的であることを説明します。しかし、実際のウェブデータインフラストラクチャ内で1つが終わる場所と他の1つが始まる場所を説明するものは少ないです。この境界がシステムの信頼性を決定します。

2番目の違いは監査可能性です。モデルがスニペットだけから答えを出す場合、チームはソース変換経路を検証できません。知識サプライチェーンがページコンテンツ、タイムスタンプ、抽出ログ、品質チェックを保存すると、同じ答えは見直しや改善が容易になります。

3番目の違いは失敗コストです。発見APIが古くなった要約を返しても、プロトタイプチャットアプリはまだ受け入れ可能かもしれません。同じ問題が価格インテリジェンスやポリシーモニタリングに影響を与えると、コストははるかに高くなります。

AIエージェントとデータインフラストラクチャの使用ケース

フィット感は使用ケースを通じて最も簡単に見ることができます。システムが迅速な方向性が必要な場合、検索APIはよく機能します。エージェントはこの取得レイヤーを使用して、候補となるURL、最近の言及、またはトピックのクラスターを発見し、より深い取得が始まる前にします。

検索対応のタスクの場合、SERP APIはよく機能します。SEOチームは順位モニタリング、有料およびオーガニック結果の分析、地域ごとのクエリテストにSERP APIを使用します。出力は役立ちますが、依然として1つの証拠レイヤーにとどまります。

運用的なタスクの場合、知識サプライチェーンがより良いです。価格モニタリング、リードインテリジェンス、ポリシーの追跡、カタログの拡張、調達のリサーチ、ニュースの検証は、順位付けられた結果を超えたものが必要です。抽出、タイムスタンプ、スキーマコントロール、信頼性のあるAIデータパイプラインが必要です。

これは内部ツールが重要になる場面でもあります。エージェントを構築するチームは、AIエージェントフレームワーク、最適なデータ抽出ツール、LLMトレーニングのためのデータ収集のスケーリングを1つのスタックに統合できます。これらのコンポーネントは、発見、抽出、調整を分離して評価するのが簡単になります。上流の入力を同じツールカテゴリとして扱うのではなく、です。

ウェブスクレイピングとデータエンジニアリングツールへの影響

最大の教訓は、取得だけでは信頼できるデータを生成しないことです。ウェブスクレイピングAPIはリンクを実用的な記録に変換するため重要です。データエンジニアリングレイヤーは重要です。生のページコンテンツは不一でノイズが多く、多くの場合重複しています。

これはコンプライアンスに基づく収集設計が重要である理由です。ロボットのガイドライン、レートリミット、アクセスポリシー、契約上の制限を尊重してください。Googleのクローラーガイドは、トラフィック管理とクロール動作がウェブの通常の運用環境の一部であることを明確にしています。良いウェブデータインフラストラクチャはサーバーの負荷を軽減し、ソースルールをドキュメント化し、監査トレールを保持する必要があります。

ツールの観点から、スタックは通常次のようになります。発見APIまたはSERP APIがターゲットを特定します。ウェブスクレイピングAPIまたはブラウザツールがコンテンツを収集します。AIデータパイプラインが記録をパース、拡張、保存します。評価ツールが新鮮さとソースの信頼性をスコアリングします。その後、エージェントフレームワークまたはRAGシステムが結果を使用します。

運用上の信頼性についても現実的な注意が必要です。一部の承認された自動化フローは、収集またはモニタリングを妨げる検証ステップに遭遇することがあります。そのような場合、チームはキャプチャが自動化を妨げる理由や価格モニタリングAIエージェントなどのサポートサービスを追加することがあります。それがあなたのスタックの一部であれば、CapSolverはそのシナリオのドキュメント済みAPIパターンを提供するため関係があります。

CapSolverについて話す際の最も安全な方法は、公式ドキュメンテーションに近づくことです。以下の例は、CapSolverのAPIガイドに記載されたドキュメントされたcreateTaskリクエスト形式を模倣しており、承認された自動化環境でのみ使用する必要があります。

json

POST https://api.capsolver.com/createTask

Host: api.capsolver.com

Content-Type: application/json

{

"clientKey": "YOUR_API_KEY",

"appId": "APP_ID",

"task": {

"type": "ImageToTextTask",

"body": "BASE64 image"

}

}この例は知識サプライチェーンのコアではありません。信頼性のサポートコンポーネントです。主なポイントは変わりません。発見、収集、ガバナンスは一緒に設計されるべきです。

CapSolverのボーナスコードを取得する

瞬時に自動化予算を拡大!

CapSolverアカウントをチャージする際にボーナスコードCAP26を使用すると、すべてのチャージで5%のボーナスが追加されます。制限はありません。

CapSolverダッシュボードで今すぐ取得してください

結論

実用的な結論は簡単です。検索APIはシステムが情報を見つけるのを助けますが、知識サプライチェーンはシステムがそれを信頼し、再利用し、運用可能にするのを助けます。あなたの作業が探索的であれば、この取得レイヤーで十分かもしれません。あなたの作業が製品、収益、またはコンプライアンスに影響を与える場合、抽出、検証、保存が組み込まれたより広範なウェブデータインフラストラクチャが必要です。

ほとんどのチームにとって、勝ちの設計はハイブリッドです。発見には発見APIまたはSERP APIを使用してください。コンテンツ収集にはウェブスクレイピングAPIを使用してください。その後、明確なソースポリシー、モニタリング、レビューを備えたAIデータパイプラインに両方を接続してください。これはAIのためのデータ取得で最も耐久性のあるパスです。

次のステップを計画する際、現在のスタックをレイヤーごとに監査してください。発見が終わる場所、証拠が始まる場所、ガバナンスが記録される場所を尋ねてください。この演習は、より高速なインターフェース、より深いパイプライン、または両方が必要かどうかを明らかにすることが通常あります。

質問と回答

検索APIはSERP APIと同じですか?

いいえ。検索APIは広範な取得インターフェースであり、SERP APIは検索エンジン結果ページと関連する結果要素に焦点を当てています。

このような取得インターフェースがAIアプリケーションに十分ですか?

プロトタイプ、内部アシスタント、低リスクのリサーチタスク、およびパイプラインの初期発見ステップでは、多くの場合十分です。

なぜ知識サプライチェーンが本格的なAIに適しているのですか?

知識サプライチェーンは、抽出、正規化、検証、保存、調整を追加します。これらのレイヤーは新鮮さ、監査可能性、再利用性を向上させます。

ウェブスクレイピングAPIはこのモデルでどこに位置しますか?

ウェブスクレイピングAPIは発見の後に位置します。URLとソースページを構造化されたコンテンツに変換します。

AIデータインフラストラクチャに関する記事でCapSolverを言及する理由は何ですか?

一部の承認された自動化ワークフローは、発見後の検証ステップで中断されることがあります。この狭い文脈では、CapSolverは、より広範なポリシーに配慮したシステム内の1つのコンポーネントとして運用継続性をサポートできます。

もっと見る

Jun 03, 2026

AIエージェントがCloudflare Turnstileに詰まっている?解決策はこちら

あなたのAIエージェントがCloudflare Turnstileで詰まっていますか?自動化されたブラウザが遮断される理由を学び、有効なトークンを準拠して生成、インジェクト、送信するための3ステップの修正手順に従ってください。

May 28, 2026

urllib3 と Requests: どの Python の HTTP ライブラリを使うべきですか?

PythonのHTTP処理におけるurllib3とRequestsを比較する。速度、コントロール、再試行、セッション、スクリーピングの適合性、そして実際の使い勝手でそれぞれのライブラリが最も適しているのはいつかを学ぶ。