कैसे नौकरी के अवसर ब्लॉक न होते हुए निकालें

Lucas Mitchell

Automation Engineer

TL;Dr:

- रिजिडेंटियल प्रॉक्सी के घूर्णन का उपयोग करें: मुख्य नौकरी बोर्ड या पेशेवर नेटवर्किंग प्लेटफॉर्म द्वारा चिह्नित होने से बचने के लिए उच्च गुणवत्ता वाले रिजिडेंटियल आईपी का उपयोग करें।

- ब्राउजर फिंगरप्रिंट के अनुकरण करें:

curl_cffiजैसे उपकरण के साथ वास्तविक ब्राउजर प्रोफाइल के एलएस फिंगरप्रिंट और HTTP हेडर को मेल करें। - कैप्चा को स्वचालित रूप से प्रबंधित करें: क्लाउडफ़ेयर टर्नस्टाइल और reCAPTCHA चुनौतियों के साथ निपटने के लिए एक विश्वसनीय सॉल्वर के रूप में CapSolver के साथ एकीकृत करें।

- रोबोट्स.टीएक्स्ट और दर सीमाओं का सम्मान करें: यादृच्छिक देरी के साथ एथिक स्क्रैपिंग नियमों का पालन करके लंबे समय तक एक्सेस बनाए रखें।

परिचय

नौकरी के विज्ञापनों के लिए वेब स्क्रैपिंग भुगतान एजेंसियों, बाजार अनुसंधानकर्ताओं और नौकरी संग्रहकर्ताओं के लिए एक मूलभूत बन गया है। हालांकि, मुख्य नौकरी बोर्ड ने अपने विशिष्ट डेटा की सुरक्षा और साइट स्थिरता सुनिश्चित करने के लिए जटिल सुरक्षा जांच उपायों का उपयोग किया है जो आपके डेटा संग्रह को सेकंड में रोक सकते हैं। यदि आपने कभी नौकरी पोस्टिंग के लिए स्क्रैप करते समय तुरंत आईपी बैन या अंतहीन सत्यापन लूप का सामना किया है, तो आप एक अकेले नहीं हैं। चुनौति यह है कि आपके स्वचालित स्क्रिप्ट को मानव ब्राउजिंग व्यवहार से अलग करना मुश्किल है। इस गाइड आपको एक व्यापक तकनीकी मार्गदर्शिका प्रदान करती है जो आपको नौकरी के विज्ञापनों को बिना ब्लॉक हुए प्रभावी ढंग से स्क्रैप करने में मदद करती है जबकि एक कम डिटेक्शन प्रोफाइल बनाए रखती है।

नौकरी बोर्ड क्यों आपके स्क्रैपर को ब्लॉक करते हैं

नौकरी प्लेटफॉर्म और पेशेवर नेटवर्किंग साइट अपने संपत्ति डेटा की सुरक्षा और साइट स्थिरता सुनिश्चित करने के लिए भारी राशि के निवेश करते हैं। वे आमतौर पर चार लेयर के साथ स्क्रैपर की पहचान करते हैं और ब्लॉक करते हैं।

आईपी-आधारित विश्वसनीयता और दर सीमा

अधिकांश नौकरी बोर्ड एक ही आईपी पते से आने वाले अनुरोधों की संख्या की निगरानी करते हैं। यदि आप एक निश्चित सीमा से अधिक हो जाते हैं, तो आपकी आईपी को अस्थायी या स्थायी रूप से ब्लैकलिस्ट कर दिया जाता है। डेटासेंटर आईपी विशेष रूप से खतरनाक हैं क्योंकि वे सर्वर फार्म के साथ संबंधित होने के लिए आसानी से पहचाने जा सकते हैं, वास्तविक उपयोगकर्ता के बजाय।

ब्राउजर और टीएलएस फिंगरप्रिंटिंग

आधुनिक एंटी-बॉट प्रणाली जैसे क्लाउडफ़ेयर और डेटाडॉम आपके यूजर-एजेंट के बाद भी देखते हैं। वे अपने टीएलएस (ट्रांसपोर्ट लेयर सुरक्षा) हैंडशेक का विश्लेषण करते हैं, विशिष्ट सिफर सुट्स और एक्सटेंशन की जांच करते हैं। यदि आपकी पायथन स्क्रिप्ट में डिफ़ॉल्ट requests लाइब्रेरी का उपयोग करते हैं, तो इसका जेएए3 फिंगरप्रिंट तुरंत बता देगा कि यह एक बॉट है।

व्यवहार विश्लेषण

मानव उपयोगकर्ता प्रत्येक 0.5 सेकंड में लिंक पर क्लिक नहीं करते हैं या पूरी तरह से रैखिक पैटर्न में नेविगेट नहीं करते हैं। जो स्क्रैपर रोबोटिक व्यवहार दिखाते हैं - जैसे निश्चित अंतराल के साथ अनुरोध या कम कैसी छवि लोड - तेजी से व्यवहार विश्लेषण इंजन द्वारा चिह्नित कर दिए जाते हैं।

कैप्चा और जावास्क्रिप्ट चुनौतियां

जब एक साइट संदिग्ध होती है लेकिन निश्चित नहीं होती है, तो यह एक चुनौती उत्पन्न करती है। यह एक सरल जावास्क्रिप्ट निष्पादन जांच हो सकती है या एक जटिल कैप्चा हो सकती है। इनको हल करने के लिए स्वचालित तरीका नहीं होने पर, आपका स्क्रैपिंग वर्कफ़्लो पूरी तरह से रुक जाएगा।

अपरिचित नौकरी स्क्रैपिंग के लिए आवश्यक तकनीक

एक टिकाऊ स्क्रैपर बनाने के लिए, आपको प्रत्येक डिटेक्शन लेयर के साथ विशिष्ट तकनीकी उपायों का उपयोग करना होगा।

1. रिजिडेंटियल प्रॉक्सी घूर्णन का अनुमोदन

एक आईपी का उपयोग करना ब्लॉक होने का सबसे तेज़ तरीका है। बजाय इसके, आपको रिजिडेंटियल प्रॉक्सी के एक समूह का उपयोग करना चाहिए। डेटासेंटर आईपी के विपरीत, रिजिडेंटियल आईपी इंटरनेट सेवा प्रदाता (आईएसपी) द्वारा वास्तविक घरेलू उपयोगकर्ताओं को आवंटित किए जाते हैं, जो वास्तविक ट्रैफिक से अलग करने में अधिक कठिन हैं।

| प्रॉक्सी प्रकार | डिटेक्शन जोखिम | लागत | सबसे अच्छा उपयोग केस |

|---|---|---|---|

| डेटासेंटर | उच्च | कम | कम सुरक्षा वाली साइट, परीक्षण |

| रिजिडेंटियल | कम | मध्यम | उच्च सुरक्षा नौकरी बोर्ड और खोज इंजन |

| मोबाइल (4जी/5जी) | बहुत कम | उच्च | अत्यधिक हमलावर एंटी-बॉट प्रणाली |

जब आप नौकरी के विज्ञापनों को स्क्रैप करते हैं, तो अपने प्रॉक्सी प्रदाता के साथ स्वचालित घूर्णन का समर्थन सुनिश्चित करें। इससे यह सुनिश्चित होता है कि प्रत्येक अनुरोध - या प्रत्येक सत्र - एक अलग भौगोलिक स्थान और आईपी से आता है।

2. टीएलएस फिंगरप्रिंट अनुकरण का मास्टरी

जैसा कि पहले बताया गया है, मानक प per लाइब्रेरी जैसे requests या urllib के विशिष्ट टीएलएस फिंगरप्रिंट होते हैं। इसे हल करने के लिए, आपको curl_cffi का उपयोग करना चाहिए, जो आपकी स्क्रिप्ट को वास्तविक ब्राउजर जैसे क्रोम या फायरफॉक्स के टीएलएस हैंडशेक के अनुकरण की अनुमति देता है।

python

from curl_cffi import requests

# क्रोम 120 टीएलएस फिंगरप्रिंट के अनुकरण करना

response = requests.get(

"https://www.target-job-board.com/jobs?q=software+engineer",

impersonate="chrome120",

headers={

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36",

"Accept-Language": "en-US,en;q=0.9",

}

)

print(response.status_code)अपने यूजर-एजेंट को संबंधित टीएलएस प्रोफाइल के साथ मेल करके, आप क्लाउडफ़ेयर या एकामाई के द्वारा ब्लॉक होने की संभावना को बहुत कम कर देते हैं।

3. कैप्चा का उपयोग करके कैपसॉल्वर के साथ प्रबंधन

सही हेडर और प्रॉक्सी के साथ भी, आपको अंततः एक चुनौती का सामना करना पड़ेगा। नौकरी बोर्ड बार-बार क्लाउडफ़ेयर टर्नस्टाइल या reCAPTCHA का उपयोग करते हैं ताकि उपयोगकर्ताओं की पुष्टि की जा सके। इसका हाथ से हल करना पैमाने पर असंभव है। इसके बजाय CapSolver आपके ऑटोमेशन स्टैक के लिए आवश्यक हो जाता है।

CapSolver विभिन्न कैप्चा प्रकार हल करने के लिए एक बिना खटखटाने वाला एपीआई प्रदान करता है। उदाहरण के लिए, यदि आप नौकरी खोज एपीआई का उपयोग करते समय एक क्लाउडफ़ेयर टर्नस्टाइल चुनौती का सामना करते हैं या मुख्य रोजगार प्लेटफॉर्म के लिए स्क्रैपिंग करते हैं, तो आप निम्नलिखित आधिकारिक कार्यान्वयन का उपयोग कर सकते हैं:

python

import requests

import time

api_key = "YOUR_CAPSOLVER_API_KEY"

site_key = "0x4XXXXXXXXXXXXXXXXX" # लक्ष्य साइट के HTML में पाया जाता है

site_url = "https://www.target-job-board.com"

def solve_turnstile():

payload = {

"clientKey": api_key,

"task": {

"type": 'AntiTurnstileTaskProxyLess',

"websiteKey": site_key,

"websiteURL": site_url

}

}

res = requests.post("https://api.capsolver.com/createTask", json=payload)

task_id = res.json().get("taskId")

if not task_id:

return None

while True:

time.sleep(1)

result_res = requests.post("https://api.capsolver.com/getTaskResult", json={"clientKey": api_key, "taskId": task_id})

result = result_res.json()

if result.get("status") == "ready":

return result.get("solution", {}).get('token')

if result.get("status") == "failed":

return None

token = solve_turnstile()इसे अपने कार्यप्रवाह में एकीकृत करके, आपके स्क्रैपर के कार्य को मानव हस्तक्षेप के बिना जारी रखने की अनुमति मिलती है, जो आपके डेटा पाइपलाइन की अवधि को दुरुस्त रखता है।

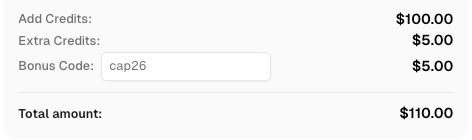

CapSolver बोनस कोड के साथ अपना बोनस प्राप्त करें

अपने स्वचालन बजट को तत्काल बढ़ाएं!

CapSolver खाता में रीचार्ज करते समय बोनस कोड CAP26 का उपयोग करें ताकि प्रत्येक रीचार्ज पर 5% बोनस मिले — कोई सीमा नहीं।

अपने CapSolver डैशबोर्ड में अब इसे रीडीम करें

4. अनुरोध हेडर और रेफरर का अनुकूलन

एक सामान्य गलती "नग्न" अनुरोध भेजना है। वास्तविक ब्राउजर हमेशा एक Referer हेडर और विभिन्न Sec-CH-UA (क्लायंट हिंट्स) हेडर भेजते हैं। जब आप नौकरी के विज्ञापनों को स्क्रैप करते हैं, तो हमेशा रेफरर को साइट के होमपेज या पिछले खोज परिणाम पृष्ठ पर सेट करें।

- यूजर-एजेंट: हाल के, लोकप्रिय स्ट्रिंग का उपयोग करें।

- रेफरर:

https://www.google.com/या साइट के स्वयं के डोमेन। - एक्सेप्ट-एन्कोडिंग:

gzip, deflate, br(अपने कोड में इनके डिकंप्रेस करने की क्षमता सुनिश्चित करें।)

अनुकूलन सारांश: स्क्रैपिंग रणनीतियां

| रणनीति | प्रभावकारिता | कार्यान्वयन मेहनत | सिफारिश किया गया लिए |

|---|---|---|---|

| बेसिक पायथन अनुरोध | बहुत कम | कम | असुरक्षित निजी ब्लॉग |

| हेडलेस ब्राउजर (सीलियन) | मध्यम | मध्यम | भारी जावास्क्रिप्ट वाली साइट |

| स्टील्थ ब्राउजर + प्रॉक्सी | उच्च | उच्च | उच्च सुरक्षा रोजगार प्लेटफॉर्म |

| वेब स्क्रैपिंग एपीआई | बहुत उच्च | कम | एंटरप्राइज स्केल नौकरी डेटा निकालना |

नैतिक और कानूनी विचार

तकनीकी सफलता महत्वपूर्ण है, लेकिन आपको नैतिक स्क्रैपिंग के लिए भी प्राथमिकता देनी चाहिए। हमेशा साइट के robots.txt फ़ाइल और उपयोग की शर्तों की जांच करें। विश्व विस्तार वेब संस्था (W3C) के निर्देशों के अनुसार, नैतिक डेटा संग्रह लक्ष्य सर्वर के स्वास्थ्य के सम्मान के साथ अत्यधिक अनुरोधों से बचने में होता है। साथ ही, इलेक्ट्रॉनिक फ्रंटियर फाउंडेशन ने जोर देकर कहा है कि सार्वजनिक रूप से उपलब्ध डेटा के स्क्रैपिंग सामान्य रूप से सुरक्षित है, लेकिन आप अनुमति के बिना निजी उपयोगकर्ता जानकारी या लॉगिन दीवार के पीछे डेटा के एक्सेस के बारे में बचना चाहिए।

निष्कर्ष

ब्लॉक होने के बिना नौकरी के विज्ञापनों को स्क्रैप करना एक बहु-स्तरीय दृष्टिकोण की आवश्यकता होती है। CapSolver के माध्यम से रिजिडेंटियल प्रॉक्सी घूर्णन, टीएलएस फिंगरप्रिंटिंग और स्वचालित कैप्चा हल करने के साथ एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक बल्कि एक

और देखें

Jun 03, 2026

AI एजेंट क्लाउडफ़्लेयर टर्नस्टाइल पर फंस गया? यहां ठीक करने का तरीका है

आपका AI एजेंट Cloudflare Turnstile पर फंस गया? स्वचालित ब्राउजर क्यों ब्लॉक कर दिए जाते हैं और एक वैध टोकन संगत रूप से जनरेट करें, इंजेक्ट करें और सबमिट करें।

May 28, 2026

urllib3 विरुद्ध Requests: कौन सा पायथन HTTP लाइब्रेरी उपयोग करें?

पायथन एचटीटीपी कार्य के लिए urllib3 और Requests की तुलना करें। गति, नियंत्रण, पुन: प्रयास, सत्र, स्क्रैपिंग के लिए उपयुक्तता और वास्तविक अभ्यास में प्रत्येक पुस्तकालय कब सबसे अच्छा होता है जानें।