Como raspar a Amazon: Guia de 2026 para Extração Ética de Dados e Resolução de CAPTCHA

Emma Foster

Machine Learning Engineer

10-Apr-2026

TL;Dr:

- A raspagem de dados da Amazon em 2026 exige técnicas avançadas para superar medidas anti-bot sofisticadas.

- Práticas éticas de raspagem, incluindo o respeito a

robots.txte a gestão da taxa de solicitações, são essenciais. - Proxies e agentes de usuário rotativos são essenciais para manter anonimato e evitar bloqueios de IP.

- Desafios de CAPTCHA, especialmente o AWS WAF, são comuns e podem ser resolvidos efetivamente usando serviços especializados como CapSolver.

- Um abordagem passo a passo que abrange a configuração do ambiente, integração de API, tratamento de solicitações e processamento de dados garante a extração bem-sucedida de dados.

- Otimização de desempenho por meio de raspagem concorrente e distribuída pode melhorar significativamente a eficiência.

Introdução

No cenário dinâmico do comércio eletrônico, a extração de dados da Amazon permanece uma tarefa crítica para empresas e pesquisadores. Seja para análise de concorrência, monitoramento de preços, pesquisa de produtos ou identificação de tendências de mercado, a raspagem da Amazon fornece insights valiosos. No entanto, à medida que as tecnologias de raspagem evoluem, as medidas anti-bot empregadas por plataformas como a Amazon também se tornam mais avançadas. Este guia de 2026 oferece um framework abrangente e prático para raspagem ética e eficiente da Amazon, focando em etapas práticas, exemplos de código e soluções para desafios comuns, incluindo a CAPTCHA do AWS. Para uma perspectiva adicional sobre o bypass do WAF, consulte este guia de raspagem da Amazon com bypass de WAF. Abordaremos as ferramentas, técnicas e melhores práticas necessárias para garantir que seus esforços de extração de dados sejam bem-sucedidos e sustentáveis.

Compreendendo as Medidas Anti-Raspagem da Amazon

A Amazon, como muitas plataformas online grandes, emprega um conjunto de tecnologias sofisticadas de anti-raspagem para proteger seus dados e garantir uso justo. Essas medidas são projetadas para detectar e desencorajar o acesso automatizado, variando de bloqueios de IP básicos a desafios avançados de CAPTCHA. Compreender essas defesas é o primeiro passo para construir uma solução robusta e resistente de [técnicas de anti-deteção de raspagem](https://www.capsolver.com/blog/web scraping/web-scraping-anti-detection-techniques).

Técnicas Comuns de Anti-Raspagem:

- Bloqueio de IP e Limitação de Taxa: Solicitações repetidas de um único endereço IP em um curto período podem levar a bloqueios temporários ou permanentes. A Amazon monitora a frequência e os padrões de solicitações para identificar e restringir o tráfego automatizado.

- Verificação de User-Agent e Cabeçalhos: Os sites frequentemente inspecionam cabeçalhos HTTP, especialmente a string

User-Agent, para identificar tráfego de navegador legítimo. User-Agents não padrão ou ausentes podem acionar alertas. - Desafios de CAPTCHA: CAPTCHAs (Teste de Turing Automatizado Público para Diferenciar Computadores e Humanos) são projetados para diferenciar usuários humanos de bots. A Amazon usa frequentemente CAPTCHA do AWS WAF, que envolve desafios baseados em JavaScript ou tarefas de reconhecimento de imagens.

- Armadilhas e Potes de Mel: Links ou elementos ocultos em uma página, invisíveis para usuários humanos, mas detectáveis por raspadores automatizados, podem servir como armadilhas para identificar e bloquear bots.

- Carregamento de Conteúdo Dinâmico: Muitas partes das páginas da Amazon são carregadas dinamicamente usando JavaScript, tornando difícil para raspadores baseados em solicitações HTTP acessar todos os dados.

Raspagem Ética: Melhores Práticas e Conformidade

Considerações éticas e legais são fundamentais em qualquer empreendimento de raspagem. Cumprir esses princípios não apenas garante conformidade, mas também contribui para a viabilidade a longo prazo das suas operações de raspagem. Sempre priorize a coleta responsável de dados para evitar consequências legais e manter uma relação positiva com as fontes de dados.

Diretrizes Éticas Principais:

- Revisar

robots.txt: Sempre verifique o arquivorobots.txt(por exemplo,https://www.amazon.com/robots.txt) para entender quais partes do site são proibidas para rastreamento. Respeitar essas diretrizes é uma prática ética fundamental. - Respeitar os Termos de Serviço: Familiarize-se com os Termos de Serviço da Amazon. Embora alguns termos possam restringir a raspagem, entender os mesmos ajuda a tomar decisões informadas e mitigar riscos.

- Limitação de Taxa: Implemente pausas entre solicitações para evitar sobrecarregar os servidores da Amazon. Isso previne bloqueios de IP e reduz a carga no site alvo. Uma prática comum é introduzir pausas aleatórias entre 5 a 15 segundos.

- Se identificar (de forma responsável): Use uma string

User-Agentdescritiva que inclua suas informações de contato. Isso permite que os administradores do site entrem em contato caso tenham preocupações, promovendo transparência. - Raspar apenas dados publicamente disponíveis: Foque em dados acessíveis publicamente e que não exijam credenciais de login. Evite raspar informações pessoais ou sensíveis.

Guia Passo a Passo para Raspagem da Amazon em 2026

Esta seção apresenta um guia detalhado e prático para configurar seu ambiente de raspagem, lidar com solicitações e processar dados, com foco especial na integração de resolução de CAPTCHA.

Etapa 1: Preparação do Ambiente

Antes de escrever qualquer código, certifique-se de que seu ambiente de desenvolvimento esteja corretamente configurado. O Python é uma escolha popular para raspagem com Python devido à sua rica ecossistema de bibliotecas.

Propósito: Estabelecer uma base estável e eficiente para seu projeto de raspagem.

Operação:

-

Instalar Python: Se não estiver instalado, baixe e instale o Python 3.8+ no site oficial.

-

Criar um Ambiente Virtual: Isola suas dependências do projeto.

bashpython3 -m venv amazon_scraper_env source amazon_scraper_env/bin/activate # No Windows, use `amazon_scraper_env\Scripts\activate` -

Instalar Bibliotecas Essenciais:

requests: Para fazer solicitações HTTP.BeautifulSoup4: Para analisar conteúdo HTML.lxml: Um analisador HTML rápido, frequentemente usado com BeautifulSoup.selenium(opcional): Para renderização de conteúdo dinâmico, se necessário.webdriver_manager(opcional): Para gerenciar drivers de navegador para Selenium.

bashpip install requests beautifulsoup4 lxml # Se usando Selenium: # pip install selenium webdriver_manager

Notas: Atualize regularmente suas bibliotecas para aproveitar os últimos recursos e patches de segurança.

Etapa 2: Fazer Solicitações Iniciais e Tratar Anti-Raspagem Básica

Comece com solicitações básicas, focando em rotação de agentes de usuário e implementação de pausas para imitar padrões de navegação humana.

Propósito: Enviar solicitações para a Amazon e recuperar conteúdo HTML, minimizando o risco de bloqueio imediato.

Operação:

- Rotacionar Agentes de Usuário: Mantenha uma lista de agentes de usuário comuns e os rotacione com cada solicitação. Isso faz seu raspador parecer diferentes navegadores.

- Implementar Pausas: Introduza pausas aleatórias entre solicitações para evitar disparar limites de taxa.

python

import requests

import time

import random

from bs4 import BeautifulSoup

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/109.0.0.0 Safari/537.36',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/109.0.0.0 Safari/537.36',

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/108.0.0.0 Safari/537.36',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/108.0.0.0 Safari/537.36',

'Mozilla/5.0 (X11; Linux x86_64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/108.0.0.0 Safari/537.36',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/16.1 Safari/605.1.15',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 13_1) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/16.1 Safari/605.1.15',

]

def fetch_amazon_page(url):

headers = {'User-Agent': random.choice(user_agents)}

try:

response = requests.get(url, headers=headers, timeout=10)

response.raise_for_status() # Lança uma exceção para erros HTTP

time.sleep(random.uniform(5, 15)) # Pausa aleatória

return response.text

except requests.exceptions.RequestException as e:

print(f"Falha na solicitação: {e}")

return None

# Exemplo de uso:

# product_page_url = "https://www.amazon.com/dp/B08XYZ123"

# html_content = fetch_amazon_page(product_page_url)

# if html_content:

# soup = BeautifulSoup(html_content, 'lxml')

# # Processar objeto soupNotas: Para cenários mais avançados, considere usar um serviço de rotação de proxies para gerenciar um pool de endereços IP, aumentando ainda mais sua anonimidade durante a raspagem da Amazon. Para mais insights sobre a integração de proxies, consulte integração de proxies para resolução de CAPTCHA. Isso é crucial para operações em larga escala.

Etapa 3: Lidando com Desafios de CAPTCHA com CapSolver

A Amazon frequentemente utiliza CAPTCHA do AWS WAF para bloquear solicitações automatizadas. Esses desafios podem ser baseados em tokens (requerendo um ambiente de navegador real) ou classificação de imagens. O CapSolver oferece soluções robustas para ambos os tipos, permitindo integrar de forma contínua a resolução de CAPTCHA ao seu fluxo de raspagem da Amazon.

Propósito: Resolver programaticamente desafios de CAPTCHA do AWS WAF e continuar a extração de dados sem interrupções.

Operação:

O CapSolver fornece dois tipos principais de tarefas para CAPTCHA do AWS WAF:

AntiAwsWafTask: Para desafios baseados em tokens, frequentemente requerendo parâmetros comoawsKey,awsIv,awsContexteawsChallengeJS.AwsWafClassification: Para desafios de classificação de imagens, onde você fornece uma imagem e uma pergunta.

CAPTCHA Baseado em Token do AWS WAF (Exemplo em Python)

Este exemplo demonstra como resolver CAPTCHA baseado em token do AWS WAF usando o tipo de tarefa AntiAwsWafTask do CapSolver. Isso é particularmente útil quando a Amazon apresenta um desafio baseado em JavaScript.

python

import requests

import time

CAPSOLVER_API_KEY = "SUA_CHAVE_API_DO_CAPSOLVER" # Substitua pela sua chave real do CapSolver

def create_aws_waf_task(website_url, aws_key, aws_iv, aws_context, aws_challenge_js, proxy=None):

payload = {

"clientKey": CAPSOLVER_API_KEY,

"task": {

"type": "AntiAwsWafTask", # Use AntiAwsWafTaskProxyless se não quiser usar seu próprio proxy

"websiteURL": website_url,

"awsKey": aws_key,

"awsIv": aws_iv,

"awsContext": aws_context,

"awsChallengeJS": aws_challenge_js

}

}

if proxy:

payload["task"]["proxy"] = proxy # Adicione proxy se fornecido

response = requests.post("https://api.capsolver.com/createTask", json=payload)

response.raise_for_status()

return response.json().get("taskId")

def get_task_result(task_id):

payload = {

"clientKey": CAPSOLVER_API_KEY,

"taskId": task_id

}

while True:

response = requests.post("https://api.capsolver.com/getTaskResult", json=payload)

response.raise_for_status()

result = response.json()

if result.get("status") == "ready":

return result.get("solution")

elif result.get("status") == "failed":

raise Exception(f"Tarefa do CapSolver falhou: {result.get('errorDescription')}")

time.sleep(3) # Verificação a cada 3 segundos

# Exemplo de uso (substitua pelos valores reais da página de desafio da Amazon):

# website_url = "https://efw47fpad9.execute-api.us-east-1.amazonaws.com/latest"

# aws_key = "valor_da_chave_da_página_da_amazon"

# aws_iv = "valor_do_iv_da_página_da_amazon"

# aws_context = "valor_do_context_da_página_da_amazon"

# aws_challenge_js = "url_da_entrada_js_do_desafio"

# proxy_string = "http://usuário:senha@proxy:porta" # Opcional, se usar AntiAwsWafTask

# try:

# task_id = create_aws_waf_task(website_url, aws_key, aws_iv, aws_context, aws_challenge_js, proxy_string)

# print(f"ID da Tarefa do CapSolver: {task_id}")

# solution = get_task_result(task_id)

# aws_waf_token = solution.get("cookie")

# print(f"Token AWS WAF: {aws_waf_token}")

# # Use este token em suas solicitações subsequentes como cookie:

# # cookies = {'aws-waf-token': aws_waf_token}

# # response = requests.get(target_url, headers=headers, cookies=cookies)

# except Exception as e:

# print(f"Erro ao resolver CAPTCHA: {e}")Notas: Ao integrar o CapSolver, certifique-se de capturar todos os parâmetros necessários (awsKey, awsIv, awsContext, awsChallengeJS) da página de desafio da Amazon. Esses são geralmente encontrados no código-fonte da página de CAPTCHA quando um código de status 405 é retornado. Para mais detalhes, consulte a documentação do CapSolver sobre AWS WAF.

Use o código

CAP26ao se inscrever no CapSolver para receber créditos extras!

CAPTCHA de Classificação de Imagem do AWS WAF (Exemplo em Python)

Para CAPTCHAS baseados em imagens, o tipo de tarefa AwsWafClassification do CapSolver pode ser usado. Isso envolve enviar a imagem da CAPTCHA e qualquer pergunta associada ao CapSolver para reconhecimento.

python

import requests

import base64

import time

CAPSOLVER_API_KEY = "SUA_CHAVE_API_DO_CAPSOLVER" # Substitua pela sua chave real do CapSolver

def solve_aws_waf_classification(image_path, question):

with open(image_path, "rb") as f:

image_base64 = base64.b64encode(f.read()).decode("utf-8")

payload = {

"clientKey": CAPSOLVER_API_KEY,

"task": {

"type": "AwsWafClassification",

"image": image_base64,

"question": question

}

}

response = requests.post("https://api.capsolver.com/createTask", json=payload)

response.raise_for_status()

task_id = response.json().get("taskId")

get_payload = {"clientKey": CAPSOLVER_API_KEY, "taskId": task_id}

while True:

res = requests.post("https://api.capsolver.com/getTaskResult", json=get_payload)

res.raise_for_status()

data = res.json()

if data.get("status") == "ready":

return data.get("solution")

elif data.get("status") == "failed":

raise Exception(f"Tarefa de classificação do CapSolver falhou: {data.get('errorDescription')}")

time.sleep(2)

# Exemplo de uso:

# Supondo que 'captcha_image.png' seja o arquivo da imagem da CAPTCHA baixada

# question_text = "Selecione todas as imagens com uma bicicleta" # A pergunta associada à imagem

# try:

# result = solve_aws_waf_classification("captcha_image.png", question_text)

# print(f"Índices selecionados: {result}")

# # O resultado será uma lista de índices correspondentes às imagens selecionadas.

# # Em seguida, você usaria esses índices para interagir com a página da Amazon.

# except Exception as e:

# print(f"Erro ao resolver o CAPTCHA da imagem: {e}")Notas: Este método exige que você capture primeiro a imagem do CAPTCHA e a pergunta associada da página da Amazon. Isso geralmente envolve o uso de um navegador headless, como o Selenium, para renderizar a página e capturar uma captura de tela do elemento CAPTCHA. O CapSolver simplifica o processo de reconhecimento, tornando a coleta de dados da Amazon mais confiável.

Etapa 4: Extração e Processamento de Dados

Após recuperar com sucesso o conteúdo HTML, o próximo passo é analisá-lo e extrair os dados desejados. O BeautifulSoup é uma excelente biblioteca para esse propósito.

Propósito: Extrair sistematicamente pontos de dados específicos da estrutura HTML.

Operação:

- Inspeção da Estrutura HTML: Use as ferramentas de desenvolvedor do navegador para inspecionar a estrutura HTML da página da Amazon e identificar os seletores CSS ou expressões XPath para os dados que você precisa (por exemplo, nome do produto, preço, avaliações).

- Análise com BeautifulSoup: Carregue o conteúdo HTML em um objeto BeautifulSoup e use seus métodos (

find,find_all,select) para navegar e extrair dados.

python

# ... (código anterior para buscar o conteúdo HTML)

def parse_amazon_product_page(html_content):

soup = BeautifulSoup(html_content, 'lxml')

product_data = {}

# Exemplo: Extrair o título do produto

title_element = soup.select_one('#productTitle')

if title_element:

product_data['title'] = title_element.get_text(strip=True)

# Exemplo: Extrair o preço do produto

price_element = soup.select_one('.a-price .a-offscreen')

if price_element:

product_data['price'] = price_element.get_text(strip=True)

# Exemplo: Extrair a avaliação do produto

rating_element = soup.select_one('#acrCustomerReviewText')

if rating_element:

product_data['reviews_count'] = rating_element.get_text(strip=True)

# Adicione mais lógica de extração para outros pontos de dados conforme necessário

return product_data

# Exemplo de uso:

# html_content = fetch_amazon_page("https://www.amazon.com/dp/B08XYZ123")

# if html_content:

# data = parse_amazon_product_page(html_content)

# print(data)Notas: A estrutura HTML da Amazon pode mudar, então revise regularmente e atualize seus seletores. Tratamento de erros e validação robustos são essenciais para garantir a qualidade dos dados durante a coleta de dados da Amazon.

Etapa 5: Armazenamento e Gestão de Dados

Após a extração, armazene seus dados em um formato estruturado para análise posterior. Formatos comuns incluem CSV, JSON ou bancos de dados.

Propósito: Persistir os dados extraídos de forma organizada e acessível.

Operação:

- Escolha um Formato de Armazenamento: Para conjuntos de dados menores, arquivos CSV ou JSON são convenientes. Para conjuntos de dados maiores e mais complexos, considere um banco de dados (por exemplo, SQLite, PostgreSQL, MongoDB).

- Implemente a Lógica de Armazenamento: Escreva código para salvar os dados extraídos no formato escolhido.

python

import json

import csv

def save_to_json(data, filename):

with open(filename, 'w', encoding='utf-8') as f:

json.dump(data, f, ensure_ascii=False, indent=4)

print(f"Dados salvos em {filename}")

def save_to_csv(data, filename, fieldnames):

with open(filename, 'w', newline='', encoding='utf-8') as f:

writer = csv.DictWriter(f, fieldnames=fieldnames)

writer.writeheader()

writer.writerows(data)

print(f"Dados salvos em {filename}")

# Exemplo de uso:

# all_product_data = [

# {'title': 'Produto A', 'price': '$10.99', 'reviews_count': '1.234 avaliações'},

# {'title': 'Produto B', 'price': '$25.00', 'reviews_count': '567 avaliações'},

# ]

# save_to_json(all_product_data, 'amazon_products.json')

# save_to_csv(all_product_data, 'amazon_products.csv', ['title', 'price', 'reviews_count'])Notas: Ao lidar com grandes volumes de dados, considere atualizações incrementais em seu armazenamento para evitar reescanear informações existentes. Isso otimiza seu processo de coleta de dados da Amazon.

Solução de Problemas Comuns na Coleta de Dados da Amazon

Mesmo com a melhor preparação, você pode enfrentar problemas durante a coleta de dados da Amazon. Aqui estão alguns problemas comuns e suas soluções.

Problema 1: IP Bloqueado ou Limitado por Taxa

Descrição: Seu scraper recebe erros HTTP 403 (Proibido) ou 429 (Muitas Solicitações), ou as solicitações simplesmente expiram.

Solução:

- Use Proxies: Utilize um serviço de proxies rotativos para distribuir suas solicitações entre muitos endereços IP. Isso é uma das formas mais eficazes de evitar bloqueios de IP para coleta de dados da Amazon. Para mais informações sobre como evitar bloqueios, leia sobre coleta de dados sem ser bloqueado.

- Aumente os Atrasos: Estenda a duração de

time.sleep()entre as solicitações e introduza mais aleatoriedade. - Gerenciamento de Sessão: Use

requests.Session()para manter cookies e cabeçalhos entre solicitações, simulando uma sessão de navegação mais natural.

Problema 2: CAPTCHA Encontrado

Descrição: A Amazon apresenta um desafio CAPTCHA, interrompendo seu processo de coleta de dados.

Solução:

- Integre o CapSolver: Como demonstrado na Etapa 3, use a API do CapSolver para resolver automaticamente os CAPTCHAS do AWS WAF. Isso é uma solução confiável para desafios complexos encontrados durante a coleta de dados da Amazon.

- Navegadores Headless: Para CAPTCHAS baseados em JavaScript muito complexos, você pode precisar usar um navegador headless (como o Selenium com Chrome/Firefox) para renderizar a página, capturar o CAPTCHA e depois enviá-lo ao CapSolver.

Problema 3: Alterações na Estrutura HTML

Descrição: Sua lógica de extração de dados quebra porque a Amazon atualizou a estrutura HTML do site.

Solução:

- Monitoramento Regular: Revise periodicamente a saída do seu scraper e as páginas da Amazon. Configure alertas para formatos de dados inesperados ou campos ausentes.

- Seletores Flexíveis: Use seletores CSS ou expressões XPath mais gerais que sejam menos propensos a mudar. Evite depender de nomes de classes altamente específicos ou gerados automaticamente.

- Tratamento de Erros: Implemente blocos

try-exceptao redor da lógica de análise para lidar com elementos ausentes de forma elegante e registrar erros para revisão posterior.

Problema 4: Conteúdo Dinâmico Não Carregado

Descrição: Alguns dados que você espera coletar não estão presentes na resposta HTML inicial.

Solução:

- Navegadores Headless: Use o Selenium ou o Playwright para renderizar a página completa, incluindo conteúdo carregado via JavaScript. Isso permite acessar o DOM completo para coleta de dados da Amazon.

- Monitoramento de API: Inspeccione as solicitações de rede nas ferramentas de desenvolvedor do navegador para ver se os dados são carregados por meio de uma chamada de API interna. Se for o caso, você pode chamar diretamente essa API.

Otimização de Desempenho para Coleta de Dados em Grande Escala na Amazon

Para operações de coleta de dados em grande escala na Amazon, a eficiência é fundamental. Otimizar o desempenho do seu scraper pode economizar tempo e recursos.

1. Concorrência e Paralelismo

Em vez de escanear páginas sequencialmente, processe múltiplas páginas simultaneamente usando threads ou programação assíncrona.

- Threads: Use o módulo

threadingdo Python para tarefas I/O-bound (como esperar por respostas de rede). - Asyncio: Para operações I/O-bound altamente eficientes,

asynciocomaiohttppode ser muito eficaz.

Aviso: Ao usar concorrência, esteja atento às limitações de taxa da Amazon. Distribua suas solicitações cuidadosamente para evitar sobrecarregar o servidor e disparar bloqueios.

2. Coleta Distribuída

Para projetos extremamente grandes, considere distribuir suas tarefas de coleta entre múltimas máquinas ou instâncias em nuvem. Isso pode ser gerenciado usando ferramentas como o Celery com um broker de mensagens.

3. Agendamento Inteligente de Solicitações

Priorize solicitações para dados críticos e agende dados menos importantes para horários fora de pico. Implemente um mecanismo robusto de repetição para solicitações falhas com backoff exponencial.

4. Cache de Dados

Cacheie dados frequentemente acessados localmente para reduzir o número de solicitações à Amazon. Reescaneie dados apenas quando for conhecido que eles mudaram ou após um certo intervalo de tempo.

Resumo Comparativo: Coleta Manual vs. Automatizada vs. API

Escolher a abordagem correta para coleta de dados da Amazon depende da escala, complexidade e recursos do seu projeto. Aqui está uma comparação das principais abordagens, incluindo insights de vários APIs de coletor de dados da Amazon:

| Funcionalidade | Coleta Manual (Copiar e Colar) | Scraper Automatizado Personalizado (Python) | API de Produtos da Amazon (PA-API) | API de Coleta de Dados de Terceiros |

|---|---|---|---|---|

| Esforço | Alto | Médio a Alto | Médio | Baixo |

| Custo | Grátis (intensivo em tempo) | Baixo (tempo de desenvolvimento) | Varia (com base no uso) | Varia (com base no uso) |

| Flexibilidade | Muito Alta | Alta | Limitada (dados pré-definidos) | Alta |

| Velocidade | Muito Baixa | Média a Alta | Alta | Muito Alta |

| Anti-Coleta | N/A (humano) | Alta (requer atualizações constantes) | Tratado pela Amazon | Tratado pelo provedor |

| CAPTCHA | N/A (humano) | Alta (requer integração de solucionador) | N/A | Tratado pelo provedor |

| Legalidade/Ética | Baixo risco | Médio risco (se não for cuidadoso) | Baixo risco (API oficial) | Baixo risco (provedor trata conformidade) |

| Melhor Para | Tarefas pequenas, únicas | Necessidades de dados personalizadas, controle | Dados de produto oficiais, afiliados | Projetos em grande escala, projetos complexos, velocidade |

Notas: Embora a API de Produtos da Amazon (PA-API) ofereça uma forma legítima de acessar alguns dados de produtos, ela geralmente tem limitações sobre o tipo e volume de dados disponíveis, e requer adesão aos próprios termos de serviço. Para coleta de dados completa da Amazon, um scraper automatizado personalizado com mecanismos robustos de anti-bloqueio e resolução de CAPTCHA, como os fornecidos pelo CapSolver, frequentemente oferece o melhor equilíbrio entre flexibilidade e controle.

Conclusão

Coletar dados da Amazon em 2026 exige uma abordagem estratégica e adaptável. Desde a configuração cuidadosa do ambiente e considerações éticas até a superação avançada de bots e o processamento eficiente de dados, cada etapa desempenha um papel vital. A integração de ferramentas especializadas como o CapSolver para lidar com desafios de CAPTCHA do AWS WAF já não é opcional, mas uma necessidade para extração de dados confiável e ininterrupta. Ao seguir as diretrizes apresentadas neste guia, você pode construir uma solução de coleta de dados da Amazon resistente que forneça insights precisos, oportunos e valiosos da maior plataforma de comércio eletrônico do mundo. Lembre-se, práticas de coleta de dados responsáveis e éticas são a base de qualquer esforço de coleta de dados sustentável.

Pronto para melhorar suas capacidades de coleta de dados da Amazon e superar desafios de CAPTCHA? Explore os serviços avançados de resolução de CAPTCHA do CapSolver hoje e otimize seu fluxo de extração de dados. Comece a usar o CapSolver

Perguntas Frequentes

Q1: A coleta de dados da Amazon é legal?

A1: A legalidade da coleta de dados da Amazon é complexa e depende de vários fatores, incluindo os dados sendo coletados, o propósito da coleta e as regulamentações locais. Geralmente, coletar dados publicamente disponíveis é frequentemente considerado legal, mas violar os termos de serviço ou coletar dados privados ou pessoais pode levar a problemas legais. Sempre consulte um advogado para situações específicas. Práticas éticas, como respeitar o robots.txt e os limites de taxa, são cruciais.

Q2: Como posso evitar ser bloqueado pela Amazon?

A2: Para evitar bloqueios durante a coleta de dados da Amazon, implemente uma combinação de estratégias: use proxies rotativos, altere os agentes do usuário, introduza atrasos aleatórios entre as solicitações, gerencie cookies e sessões, e resolva CAPTCHAS eficientemente com serviços como o CapSolver. Evite padrões de solicitação agressivos que imitem comportamento de bot.

Q3: O que é CAPTCHA do AWS WAF e por que é difícil de resolver?

A3: O CAPTCHA do AWS WAF é um mecanismo de segurança usado pelo Amazon Web Services para proteger sites contra ameaças automatizadas. É difícil de resolver porque frequentemente envolve desafios complexos de JavaScript, tokens criptografados ou tarefas de reconhecimento de imagem projetadas para serem fáceis de resolver por humanos, mas desafiadoras para bots. O CapSolver especializa-se em resolver esses CAPTCHAS avançados de forma programática.

Q4: Posso coletar avaliações de produtos da Amazon?

A4: Sim, coletar avaliações de produtos publicamente disponíveis é um caso de uso comum para coleta de dados da Amazon. No entanto, esteja atento ao volume e frequência de suas solicitações para evitar disparar mecanismos de anti-coleta. Sempre certifique-se de que seus métodos estejam em conformidade com diretrizes éticas e os termos de serviço da Amazon.

Q5: Como o CapSolver ajuda na coleta de dados da Amazon?

A5: O CapSolver fornece serviços de API especializados para resolver automaticamente vários tipos de CAPTCHA, incluindo o CAPTCHA do AWS WAF, frequentemente encontrado durante a coleta de dados da Amazon. Ao integrar o CapSolver ao seu scraper, você pode contornar esses desafios de forma programática, garantindo fluxo contínuo de dados e melhorando a confiabilidade de suas operações de coleta de dados. Saiba mais sobre as soluções do CapSolver

Declaração de Conformidade: As informações fornecidas neste blog são apenas para fins informativos. A CapSolver está comprometida em cumprir todas as leis e regulamentos aplicáveis. O uso da rede CapSolver para atividades ilegais, fraudulentas ou abusivas é estritamente proibido e será investigado. Nossas soluções de resolução de captcha melhoram a experiência do usuário enquanto garantem 100% de conformidade ao ajudar a resolver dificuldades de captcha durante a coleta de dados públicos. Incentivamos o uso responsável de nossos serviços. Para mais informações, visite nossos Termos de Serviço e Política de Privacidade.

Mais

A IA pode resolver CAPTCHA? Como a Detecção e a Resolução Funcionam Realmente?

Explore como a IA detecta e resolve desafios CAPTCHA, do reconhecimento de imagem à análise comportamental. Entenda a tecnologia por trás dos solucionadores de CAPTCHA de IA e como o CapSolver auxilia fluxos de trabalho automatizados. Aprenda sobre a batalha em evolução entre IA e verificação humana.

Sora Fujimoto

14-Apr-2026

Erro CAPTCHA 600010: O que Significa e Como Resolver Rápido

Enfrentando o erro CAPTCHA 600010? Aprenda o que significa esse erro do Cloudflare Turnstile e obtenha soluções passo a passo para usuários e desenvolvedores, incluindo a integração com o CapSolver para automação.

Anh Tuan

14-Apr-2026

Como resolver desafios do AWS WAF usando extensão: um guia compreensivo

Aprenda a resolver CAPTCHAs e desafios do AWS WAF automaticamente usando a extensão CapSolver. Este guia abrange reconhecimento de imagem, modo token e automação com n8n.

Adélia Cruz

13-Apr-2026

Como raspar a Amazon: Guia de 2026 para Extração Ética de Dados e Resolução de CAPTCHA

Domine a raspagem da Amazon em 2026 com este guia completo. Aprenda técnicas passo a passo, exemplos de código e como superar os desafios de CAPTCHA da AWS usando o CapSolver para extração de dados eficiente e ética.

Emma Foster

10-Apr-2026

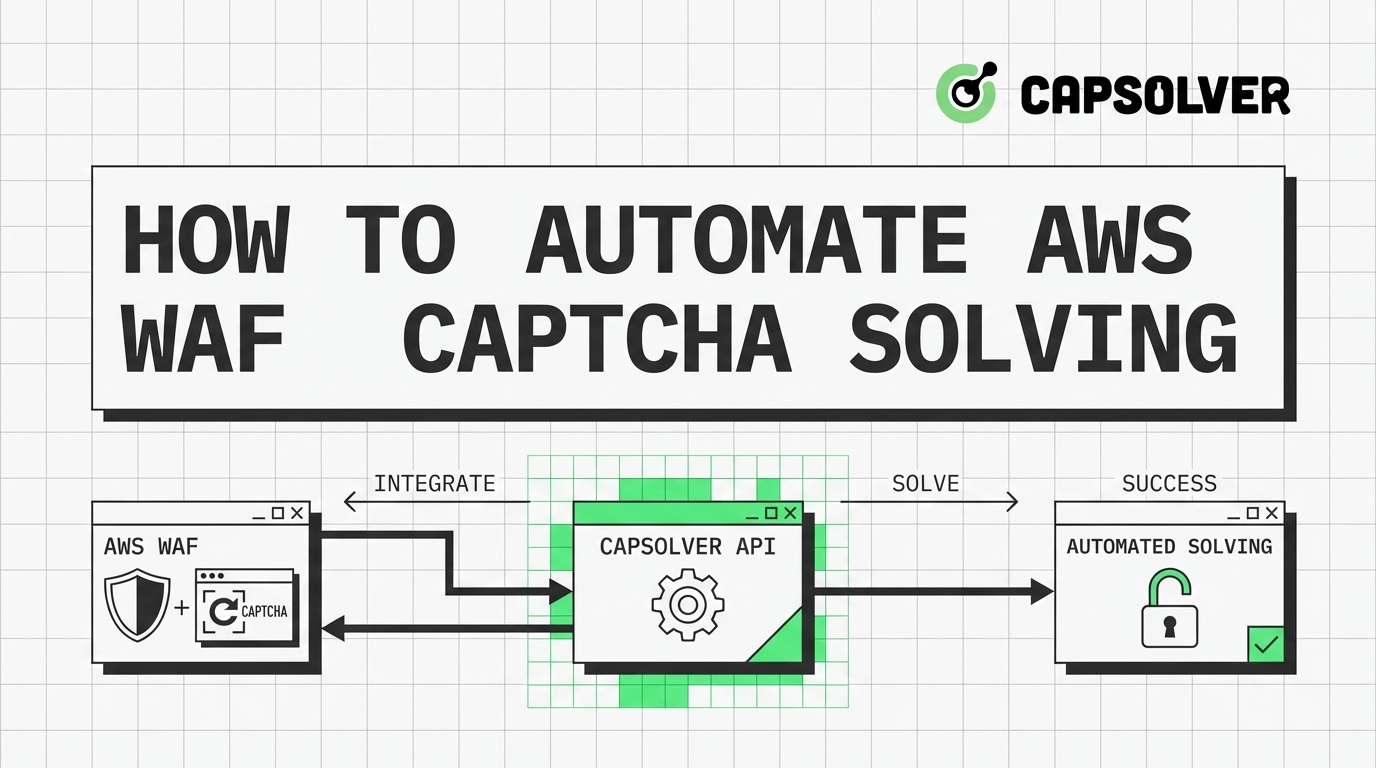

Como automatizar a resolução de CAPTCHA do AWS WAF: Ferramentas, Integração com API e Guia de Preços

Aprenda como automatizar a resolução de CAPTCHA do AWS WAF com as ferramentas certas, etapas de integração da API e uma análise completa dos custos. Compare os melhores serviços e comece rapidamente.

Ethan Collins

10-Apr-2026

API Confiável de Resolução de CAPTCHA para reCAPTCHA: O que Procurar

Procurando por uma API confiável de resolução de CAPTCHA para reCAPTCHA? Compare os melhores provedores em velocidade, custo e taxa de sucesso. Encontre a melhor solução para suas necessidades de automação.

Rajinder Singh

09-Apr-2026