Memperluas Pengumpulan Data untuk Pelatihan LLM: Menyelesaikan CAPTCHA Secara Skala

Nikolai Smirnov

Software Development Lead

TL;Dr:

- Kualitas Data adalah Raja: Pengumpulan data berkualitas tinggi adalah fondasi pelatihan model bahasa besar (LLM) yang efektif.

- Penghalang CAPTCHA: Situs web modern menggunakan tantangan canggih yang menghentikan ekstraksi data otomatis.

- Skalabilitas Penting: Intervensi manual tidak mungkin saat mengumpulkan miliaran token untuk model AI.

- Solusi CapSolver: Alat otomatis memberikan kecepatan dan keandalan yang diperlukan untuk pengumpulan data tingkat perusahaan.

- Efisiensi Biaya: Mengontrakkap penyelesaian CAPTCHA mengurangi beban infrastruktur dan mempercepat siklus pengembangan.

Pendahuluan

Membangun Model Bahasa Besar (LLM) yang kompetitif memerlukan akses ke dataset yang besar, beragam, dan berkualitas tinggi. Sebagian besar informasi ini berada di web terbuka, yang dilindungi oleh lapisan keamanan berbagai. Pengumpulan data dalam skala ini menimbulkan tantangan teknis unik yang tidak dapat diatasi metode scraping tradisional. Pengembang sering menemukan sistem otomatis mereka diblokir oleh teka-teki verifikasi yang kompleks. Penghalang ini ada untuk melindungi integritas situs, tetapi juga menghambat peneliti dan pengembang AI yang sah. Artikel ini menjelajahi cara memperluas pengumpulan data untuk pelatihan LLM dengan menangani tantangan yang terus-menerus dalam menyelesaikan CAPTCHA secara skala. Kami akan mengeksplorasi persimpangan antara otomatisasi web dan infrastruktur machine learning. Pembaca akan belajar cara mengintegrasikan CapSolver untuk mempertahankan aliran data pelatihan yang stabil tanpa hambatan manual.

Peran Data Web dalam Pelatihan LLM

Model Bahasa Besar berkembang berkat luasnya informasi yang tersedia di internet. Dari jurnal ilmiah hingga diskusi forum, setiap potongan teks berkontribusi pada kemampuan pemrosesan model. Namun, proses pengumpulan data ini semakin sulit. Banyak sumber berharga menerapkan batas kecepatan ketat dan pemeriksaan verifikasi. Langkah-langkah ini dirancang untuk membedakan antara pengguna manusia dan skrip otomatis. Bagi tim AI, pemeriksaan ini merupakan titik gesekan signifikan dalam alur data mereka.

Jumlah data yang diperlukan untuk model modern sangat besar. Misalnya, model seperti GPT-4 dilatih pada triliunan token. Mengumpulkan jumlah informasi ini membutuhkan infrastruktur penggalian yang sangat terdistribusi dan tangguh. Ketika penggali menghadapi teka-teki verifikasi, seluruh proses bisa berhenti total. Keterlambatan ini bukan hanya gangguan kecil; bisa menyebabkan dataset yang usang dan meningkatkan biaya operasional. Memastikan aliran data yang terus-menerus adalah krusial untuk mempertahankan keunggulan kompetitif produk AI.

Tantangan Umum dalam Ekstraksi Data Skala Besar

Mengekspansi upaya pengumpulan data melibatkan lebih dari sekadar menambah server. Anda harus menghadapi lingkungan protokol keamanan yang terus berkembang. Kebanyakan situs web sekarang menggunakan analisis perilaku untuk mendeteksi otomatisasi. Ketika skrip berperilaku terlalu prediktif, itu memicu CAPTCHA. Tantangan ini telah berkembang dari pengenalan teks sederhana menjadi tugas klasifikasi gambar kompleks dan penyelesaian teka-teki.

| Kategori Tantangan | Dampak pada Pengumpulan Data | Strategi Mitigasi |

|---|---|---|

| Pembatasan Kecepatan IP | Memblok permintaan dari pusat data tertentu. | Penggunaan proxy rumah tangga dan rotasi. |

| Konten Dinamis | Konten hanya dimuat setelah eksekusi JavaScript. | Browser tanpa antarmuka seperti Playwright atau Puppeteer. |

| Teka-Teki Verifikasi | Menghentikan alur otomatis hingga diselesaikan. | Integrasi penyelesaian CAPTCHA otomatis. |

| Fingerprinting | Mengidentifikasi penggali berdasarkan header browser. | Pengacakan header dan plugin stealth. |

Banyak pengembang mencoba membangun solver mereka sendiri menggunakan model machine learning dasar. Meskipun ini mungkin berfungsi untuk teka-teki sederhana, gagal menghadapi sistem keamanan modern yang didukung AI. Memelihara solver internal memerlukan pembaruan terus-menerus dan tim khusus peneliti. Ini mengalihkan fokus dari tugas inti pelatihan dan penyempurnaan LLM.

Mengapa Menyelesaikan CAPTCHA Secara Skala Penting

Dalam konteks pengembangan LLM, waktu adalah sumber daya kritis. Setiap jam yang dihabiskan memperbaiki penggali yang rusak adalah jam yang hilang dalam siklus pelatihan. Pengumpulan data otomatis harus tangguh cukup untuk menangani ribuan permintaan per detik. Jika sistem Anda tidak dapat menangani tantangan verifikasi secara otomatis, potensi skalabilitas Anda dibatasi oleh intervensi manusia.

AI modern dan penggali membutuhkan cara andal untuk melewati hambatan ini. Di sinilah layanan khusus menjadi tidak tergantikan. Dengan pendekatan API, pengembang dapat memindahkan kompleksitas penyelesaian CAPTCHA. Ini memungkinkan logika penggalian tetap sederhana dan fokus pada ekstraksi data. Untuk mereka yang tertarik pada implementasi teknis, memahami mengapa otomatisasi web terus gagal pada CAPTCHA adalah langkah pertama menuju sistem yang lebih tangguh.

Mengintegrasikan CapSolver ke Dalam Pipa Data AI Anda

CapSolver menyediakan API yang kuat yang terintegrasi langsung ke kerangka kerja otomatisasi yang ada. Baik Anda menggunakan Python, Node.js, atau Go, proses integrasi sederhana. Layanan ini mendukung berbagai tantangan, termasuk reCAPTCHA, dan versi khusus perusahaan. Fleksibilitas ini penting bagi tim yang melakukan pengumpulan data dari sumber global yang beragam.

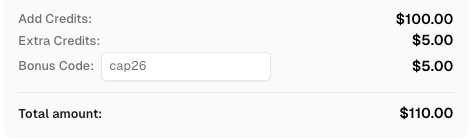

Gunakan kode

CAP26saat mendaftar di CapSolver untuk mendapatkan kredit tambahan!

Ketika penggali menghadapi tantangan, ia mengirimkan kunci situs dan URL ke API CapSolver. Layanan kemudian mengembalikan token solusi, yang penggali kirimkan ke situs web. Proses ini berlangsung dalam hitungan detik, memastikan aliran data tetap tidak terganggu. Tingkat otomatisasi ini yang memungkinkan pembuatan dataset berkualitas tinggi untuk machine learning dalam skala industri.

Ringkasan Perbandingan: Pengembangan Internal vs. API CapSolver

Memilih antara membangun solusi khusus atau menggunakan layanan profesional adalah dilema umum bagi startup AI. Tabel berikut merangkum perbedaan kunci.

| Fitur | Pengembangan Internal | API CapSolver |

|---|---|---|

| Biaya Awal | Tinggi (jam kerja teknik) | Rendah (bayar per penggunaan) |

| Pemeliharaan | Pembaruan terus-menerus diperlukan | Dikelola oleh penyedia |

| ** Tingkat Keberhasilan** | Variabel dan sering rendah | Tinggi (99,9% uptime) |

| Skalabilitas | Terbatas oleh perangkat keras lokal | Hampir tak terbatas |

| Fokus | Mengalihkan perhatian dari penelitian AI | Memungkinkan pengembangan inti |

Bagi sebagian besar organisasi, total biaya kepemilikan solusi internal jauh lebih tinggi. Biaya tersembunyi pemeliharaan dan kehilangan data sering kali melebihi biaya langganan layanan khusus.

Implementasi Teknis untuk Agens AI

Agen AI modern, seperti yang dibangun di atas LangChain atau AutoGPT, seringkali perlu menjelajahi web untuk menemukan informasi real-time. Agen ini sangat rentan terblokir karena pola menjelajah mereka unik. Mengintegrasikan solver ke dalam kumpulan alat agen memungkinkan mereka menyelesaikan tugas yang sebelumnya mustahil.

Misalnya, agen yang tugasnya mengumpulkan makalah penelitian terbaru mungkin menghadapi dinding verifikasi di perpustakaan digital. Dengan solver otomatis, agen dapat menyelesaikan CAPTCHA dan melanjutkan pencarian. Kemampuan ini penting untuk menciptakan sistem yang benar-benar otonom. Pengembang dapat mengeksplorasi lebih lanjut tentang AI CAPTCHA perusahaan LLM untuk melihat bagaimana teknologi ini saling melengkapi dalam lingkungan profesional.

Kualitas Data dan Pemrosesan Setelah Pengumpulan

Menyelesaikan CAPTCHA hanyalah tahap pertama. Setelah data dikumpulkan, harus dibersihkan dan difilter. Data web mentah sering mengandung noise, seperti iklan, menu navigasi, dan konten duplikat. Untuk pelatihan LLM, noise ini dapat menurunkan kinerja model.

Tim AI menggunakan berbagai teknik untuk memastikan kualitas data. Ini termasuk menggunakan model kecil untuk menilai relevansi teks atau menerapkan filter heuristik untuk menghilangkan kutipan berkualitas rendah. Tujuannya adalah menciptakan dataset yang besar dan bersih. Sintesis antara pengumpulan data yang efisien dan pemrosesan ketat adalah yang menghasilkan model AI terbaik. Anda dapat menemukan saran praktis lebih lanjut dalam panduan praktik AI & LLM.

Pertimbangan Etis dalam Pengumpulan Data Otomatis

Meskipun kemampuan teknis untuk mengumpulkan data luas, harus seimbang dengan pertimbangan etis. Menghormati file robots.txt dan tidak membebani situs kecil adalah praktik terbaik standar. Pengembang AI seharusnya berusaha menjadi warga web yang baik. Ini termasuk memberikan string user-agent yang jelas dan mematuhi regulasi privasi data seperti GDPR.

Menggunakan alat otomatis untuk menyelesaikan CAPTCHA harus dilakukan secara bertanggung jawab. Tujuannya adalah memfasilitasi pembuatan teknologi AI yang bermanfaat sambil meminimalkan dampak pada situs target. Banyak peneliti berargumen bahwa manfaat publik dari model LLM canggih membenarkan pengumpulan data yang luas dan tersedia secara publik. Perdebatan ini terus berkembang seiring matangnya teknologi.

Tren Masa Depan dalam Pengumpulan Data AI

Lanskap pengumpulan data bergerak menuju sistem yang lebih cerdas dan adaptif. Kita melihat munculnya pengumpulan data multi-modal, di mana model dilatih pada campuran teks, gambar, dan video. Ini meningkatkan kompleksitas tugas penggalian, karena jenis konten berbeda memerlukan strategi penanganan yang berbeda.

Selain itu, seiring situs web menjadi lebih baik dalam mendeteksi AI, alat yang digunakan untuk mengumpulkan data harus menjadi lebih canggih. Permainan "kucing dan tikus" antara sistem keamanan dan alat otomatis akan terus berlangsung. Layanan yang tetap di depan tren ini akan tetap menjadi krusial bagi industri AI. Untuk melihat lebih dalam ke masa depan, pertimbangkan untuk membaca tentang solusi masa depan AI-LLM dan bagaimana dampaknya terhadap ekosistem yang lebih luas.

Untuk mempertahankan keunggulan kompetitif, organisasi harus fokus pada optimisasi infrastruktur AI dalam skala. Ini termasuk memastikan setiap komponen pipa data, dari manajemen proxy hingga penyelesaian CAPTCHA, seefisien mungkin. Dengan memanfaatkan alat khusus, tim dapat membangun repositori data web skala besar yang menjadi dasar untuk kebangkitan masa depan. Seperti yang disebutkan dalam diskusi terbaru tentang meningkatkan penyimpanan untuk pelatihan dan inferensi AI, kemampuan menangani transfer data besar sebanding pentingnya dengan kekuatan komputasi itu sendiri.

Kesimpulan

Mengembangkan pengumpulan data untuk pelatihan LLM adalah tantangan dasar bagi generasi AI berikutnya. Dengan mengotomatisasi proses menyelesaikan CAPTCHA secara skala, pengembang dapat memastikan model mereka memiliki akses ke kekayaan informasi di internet. CapSolver menawarkan solusi yang andal, hemat biaya, dan skalabel yang terintegrasi ke dalam setiap pipa data modern. Ini memungkinkan tim AI fokus pada hal yang terbaik: membangun sistem cerdas yang mengubah dunia. Jangan biarkan teka-teki verifikasi melambatkan inovasi Anda. Mulailah menggunakan CapSolver hari ini untuk mempercepat pengumpulan data dan mempercepat pelatihan model Anda.

FAQ

1. Mengapa penyelesaian CAPTCHA otomatis diperlukan untuk pelatihan LLM?

Pelatihan LLM memerlukan triliunan titik data. Intervensi manual untuk setiap teka-teki verifikasi akan membuatnya mustahil untuk mengumpulkan data dengan kecepatan dan skala yang diperlukan.

2. Apakah penggunaan solver memengaruhi kualitas data yang dikumpulkan?

Tidak, solver hanya menangani penghalang verifikasi. Kualitas data bergantung pada logika penggalian Anda dan proses filtrasi berikutnya yang Anda terapkan pada teks mentah.

3. Apakah sulit mengintegrasikan CapSolver ke dalam penggali Python yang ada?

Integrasi sangat sederhana. CapSolver menyediakan API dan SDK yang terdokumentasi dengan baik, memungkinkan Anda menambahkan kemampuan penyelesaian teka-teki hanya dengan beberapa baris kode.

4. Apakah CapSolver dapat menangani versi terbaru reCAPTCHA?

Ya, layanan ini terus diperbarui untuk mendukung versi terbaru dan paling kompleks dari semua sistem verifikasi utama yang digunakan situs berlalu lintas tinggi.

5. Apa manfaat utama menggunakan API dibandingkan membangun solver khusus?

Manfaat utama termasuk tingkat keberhasilan yang lebih tinggi, tidak ada beban pemeliharaan, skalabilitas instan, dan biaya total yang jauh lebih rendah dibandingkan merekrut tim insinyur khusus.

Lihat Lebih Banyak

AIMar 27, 2026

Meningkatkan Otomatisasi Perusahaan: Infrastruktur Berbasis LLM untuk Pengenalan CAPTCHA yang Mulus & Efisiensi Operasional

Ketahui bagaimana Infrastruktur Otomatisasi AI yang didukung LLM mengubah pengenalan CAPTCHA, meningkatkan efisiensi proses bisnis dan mengurangi intervensi manual. Optimalkan operasi otomatis Anda dengan solusi verifikasi canggih.

AIMar 24, 2026

Cara Menyelesaikan CAPTCHA di OpenBrowser Menggunakan CapSolver (Panduan Otomatisasi Agen AI)

Selesaikan CAPTCHA di OpenBrowser dengan CapSolver. Otomatisasi reCAPTCHA, Turnstile, dan lainnya untuk agen AI dengan mudah.