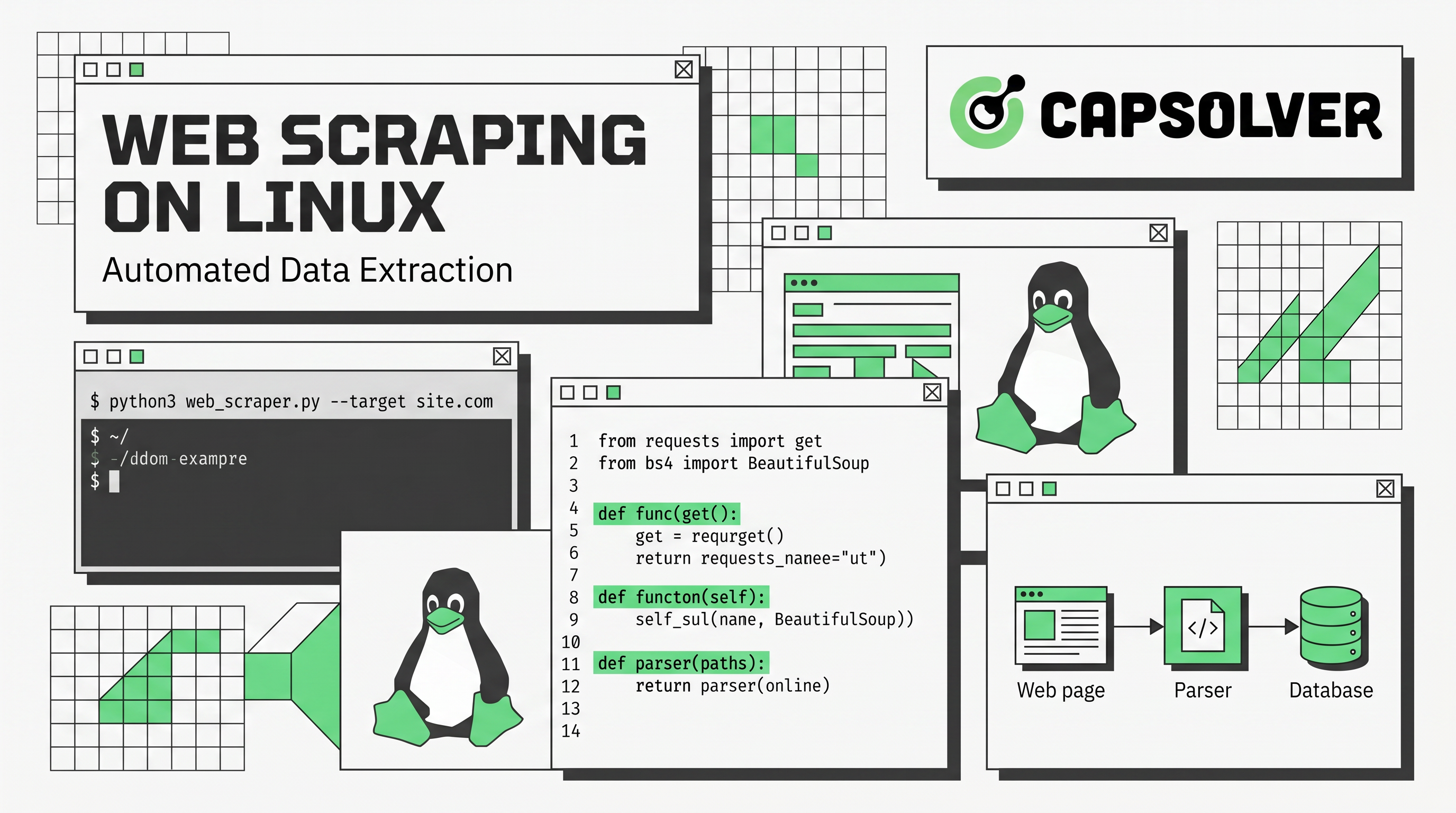

वेब स्क्रैपिंग लिनक्स पर: उपकरण, सेटअप एवं व्यावहारिक गाइड

Rajinder Singh

Deep Learning Researcher

टीएल;डीआर

- लिनक्स उत्पादन वेब स्क्रैपिंग के लिए प्रमुख प्लेटफॉर्म है क्योंकि इसकी स्थिरता, क्रॉन योजना और कम अवेज के कारण।

- कोर पायथन स्क्रैपिंग टूल्स — रिक्वेस्ट्स, ब्यूटीफुलस्पू, स्क्रैपी और प्लेयराइट अलग-अलग उपयोग मामलों के लिए उपयोगी हैं।

- बड़े पैमाने पर डेटा निकालने के लिए प्रॉक्सी रोटेशन आवश्यक है ताकि आईपी-आधारित दर सीमा लगाई जा सके।

- कैपचा चुनौतियां ऑटोमेटेड पाइपलाइन में एक सामान्य ब्लॉकर हैं; कैपसॉल्वर के एपीआई के माध्यम से इन्हें प्रोग्रामेटिक रूप से हल किया जाता है।

- लिनक्स पर एक पूर्ण डेटा निकालने पाइपलाइन क्रॉन, स्टोरेज (एसक्यूएलआईटीएस/पोस्टग्रेसक्यूएल), प्रॉक्सी प्रबंधन और कैपचा निपटान के साथ जुड़ी हुई है।

- हमेशा जिम्मेदारी से स्क्रैप करें:

robots.txtका सम्मान करें, अनुरोधों की दर को सीमित करें और लागू डेटा सुरक्षा कानूनों का पालन करें।

परिचय

लिनक्स वेब स्क्रैपिंग के बड़े पैमाने पर चलाने वाले डेवलपर्स के लिए चुना गया प्लेटफॉर्म है। इसकी मूल क्रॉन योजना, कम संसाधन खपत और परिपक्व पायथन पर्यावरण लंबे समय तक चलने वाले, स्वचालित डेटा निकालने पाइपलाइन के लिए अधिक व्यावहारिक है। इस गाइड लिनक्स में 2025 में वेब स्क्रैपिंग बनाने वाले डेवलपर्स के लिए एक व्यावहारिक संदर्भ के रूप में पर्यावेशन सेटअप, टूल चयन, प्रॉक्सी कॉन्फ़िगरेशन, कैपचा निपटान और पाइपलाइन वास्तुकला के माध्यम से चलता है।

लिनक्स वेब स्क्रैपिंग के लिए प्राथमिकता क्यों?

विश्वभर में 80% से अधिक वेब सर्वर लिनक्स पर चलते हैं, जैसा कि W3Techs सर्वर OS सांख्यिकी के अनुसार। इस नियंत्रण अकस्मात नहीं है — लिनक्स के एक सेट मूल क्षमताएं हैं जो लिनक्स पर किसी भी पैमाने पर वेब स्क्रैपिंग के लिए सबसे व्यावहारिक वातावरण हैं।

स्क्रैपिंग वर्कलोड के लिए मुख्य लाभ:

- क्रॉन योजना — किसी भी अंतराल पर स्क्रैपिंग स्क्रिप्ट को स्वचालित करें बिना तीसरे पक्ष के उपकरण के।

- कम स्मृति अंकन — छोटे हार्डवेयर पर हेडलेस ब्राउज़र और कई कार्यकर्ता एक साथ चलाएं।

- पैकेज प्रबंधन —

apt,pip, औरcondaडिपेंडेंसी प्रबंधन को साफ और पुनर्उत्पादन रखते हैं। - एसएसएच एक्सेस — ग्राफिकल यूजर इंटरफेस के बिना दूरस्थ स्क्रैपिंग सर्वर प्रबंधित करें।

- स्थिरता — लंबे समय तक चलने वाले कार्य ऑपरेटिंग सिस्टम आयोजन के कारण बाधित होने की संभावना कम होती है।

- मूल कमांड लाइन उपकरण —

wget,curl,grep,sed, औरawkटर्मिनल से सीधे हल्के स्क्रैपिंग कार्य करते हैं, जैसा कि लिनक्स कॉम के वेब स्क्रैपिंग गाइड में दस्तावेज़ीकृत है।

अधिकांश क्लाउड वीपीएस प्रदाता — एमजे़एस ईसी2, डिजिटलओशन, लिनोडे — ओएस एंड डेबियन के साथ डिफ़ॉल्ट होते हैं, जिसके कारण लिनक्स किसी भी गंभीर डेटा निकालने पाइपलाइन के लिए प्राकृतिक डेप्लॉयमेंट लक्ष्य है।

अपने लिनक्स स्क्रैपिंग वातावरण की स्थापना

केवल एक लाइन स्क्रैपिंग कोड लिखने से पहले, एक साफ और अलगाव वाला वातावरण सेट करें।

चरण 1 — पायथन और पिप स्थापित करें

अधिकांश आधुनिक लिनक्स वितरण पायथन 3 के साथ आते हैं। अपने संस्करण की जांच करें:

bash

python3 --version

pip3 --versionअगर पिप अनुपलब्ध है:

bash

sudo apt update && sudo apt install python3-pip -yचरण 2 — एक वर्चुअल पर्यावरण बनाएं

अलगाव डिपेंडेंसी के संघर्ष को रोकता है:

bash

python3 -m venv scraper-env

source scraper-env/bin/activateचरण 3 — कोर स्क्रैपिंग लाइब्रेरी स्थापित करें

bash

pip install requests beautifulsoup4 scrapy playwright lxml

playwright install chromiumचरण 4 — समर्थन उपकरण स्थापित करें

bash

pip install pandas sqlalchemy psycopg2-binary fake-useragentइस बेसलाइन ने स्थिर पृष्ठ स्क्रैपिंग, जावास्क्रिप्ट रेंडरिंग और डेटा संग्रहण को कवर किया है — लिनक्स वेब स्क्रैपिंग के कार्यक्रम में तीन मूल आधार।

पायथन स्क्रैपिंग टूल्स: सही चुनाव करें

सही टूल का चयन लक्ष्य साइट की जटिलता और आपकी बाहरी आवश्यकताओं पर निर्भर करता है। नीचे दी गई तालिका लिनक्स वातावरण में उपयोग किए जाने वाले मुख्य पायथन स्क्रैपिंग टूल्स का सारांश प्रस्तुत करती है।

तुलना सारांश

| टूल | सबसे अच्छा लिए | जेएस रेंडरिंग | गति | सीखने के ढाल |

|---|---|---|---|---|

| रिक्वेस्ट्स | सरल HTTP अनुरोध, स्थिर पृष्ठ | ✗ | तेज़ | कम |

| ब्यूटीफुलस्पू | HTML/XML पार्सिंग (रिक्वेस्ट्स के साथ संयुक्त) | ✗ | तेज़ | कम |

| स्क्रैपी | बड़े पैमाने पर, बार-बार क्रॉल | ✗ (प्लगइन द्वारा) | बहुत तेज़ | मध्यम |

| प्लेयराइट | डायनामिक, जेएस-भारित पृष्ठ | ✓ | मध्यम | मध्यम |

| सीलेनियम | पुराना ऑटोमेशन, जेएस पृष्ठ | ✓ | धीमा | मध्यम |

[रिक्वेस्ट्स + ब्यूटीफुलस्पू] लिनक्स में वेब स्क्रैपिंग के लिए मानक प्रवेश बिंदु है। इसका उपयोग अधिकांश स्थिर पृष्ठ को न्यूनतम सेटअप के साथ हैंडल करता है और शून्य से कार्यकर एजेंट तक तेज़ रास्ता है।

[स्क्रैपी] उत्पादन-कक्षा, बार-बार डेटा निकालने वाले पाइपलाइन के लिए सही चयन है। इसके लिए कॉकीज़, सत्र, संपीड़न, प्रमाणीकरण, कैशिंग और robots.txt के साथ-साथ अपने आप निपटान करता है, और इसकी मिडलवेयर वास्तुकला के लिए कस्टम प्रॉक्सी रोटेशन और कैपचा निपटान के समर्थन के साथ होती है। स्क्रैपी 2025 तक 52,000 से अधिक गिटहब स्टार्स के साथ एक अधिकतम व्यापक पायथन स्क्रैपिंग फ्रेमवर्क में से एक है (स्क्रैपी गिटहब पर)। वास्तविक दुनिया की स्थितियों में इन टूल्स के तुलना के लिए एक व्यापक अवलोकन के लिए, वेब स्क्रैपिंग टूल्स व्याख्या देखें।

स्क्रैपी उत्पादन-कक्षा, बार-बार डेटा निकालने वाले पाइपलाइन के लिए सही चयन है। यह कॉकीज़, सत्र, संपीड़न, प्रमाणीकरण, कैशिंग और robots.txt के बिना किसी भी अतिरिक्त सेटअप के निपटान करता है, और इसकी मिडलवेयर वास्तुकला कस्टम प्रॉक्सी रोटेशन और कैपचा निपटान के समर्थन के साथ होती है। प्लेयराइट जावास्क्रिप्ट रेंडरिंग की आवश्यकता होने पर सीलेनियम के आधुनिक स्थानापन्न है। यह लिनक्स पर नैतिक च्रोमियम चलाता है, एसिंक्रोनस निष्पादन समर्थन करता है और डायनामिक सामग्री के लिए काफी तेज़ है। ब्राउज़र ऑटोमेशन दृष्टिकोणों के बीच एक विस्तृत तुलना के लिए, नोड्राइवर वर्सस पारंपरिक ब्राउज़र ऑटोमेशन उपकरण विस्तार से व्यापार विकल्पों को कवर करता है।

लिनक्स वेब स्क्रैपिंग में प्रॉक्सी का उपयोग

लिनक्स वेब स्क्रैपिंग के किसी भी गंभीर सेटअप में प्रॉक्सी रोटेशन आवश्यक है। बिना इसके, आपके स्क्रैपर के आईपी बार-बार अनुरोधों के बाद ब्लॉक कर दिया जाएगा। स्थिर आवासीय प्रॉक्सी — आईपी पते जो आईएसपी द्वारा नियुक्त किए जाते हैं — विशेष रूप से प्रभावी हैं क्योंकि वे वास्तविक उपयोगकर्ता व्यवहार के समान होते हैं, जैसा कि लिनक्स सुरक्षा के एथिक स्क्रैपिंग अभ्यास के बारे में गाइड में उल्लेख किया गया है।

प्रॉक्सी के प्रकार

| प्रकार | पता लगाने का जोखिम | लागत | सबसे अच्छा लिए |

|---|---|---|---|

| डेटा सेंटर | उच्च | कम | गति-संवेदनशील, कम सुरक्षा लक्ष्य |

| आवासीय | कम | मध्यम | मध्यम बॉट पता लगाने वाले लक्ष्य |

| रोटेटिंग आवासीय | बहुत कम | अधिक | उच्च आउटपुट, लगातार पाइपलाइन |

पायथन रिक्वेस्ट्स में प्रॉक्सी कॉन्फ़िगरेशन

python

import requests

proxies = {

"http": "http://username:password@proxy-host:port",

"https": "http://username:password@proxy-host:port",

}

response = requests.get("https://example.com", proxies=proxies)

print(response.status_code)स्क्रैपी में प्रॉक्सी कॉन्फ़िगरेशन

settings.py में:

python

ROTATING_PROXY_LIST = [

"http://proxy1:port",

"http://proxy2:port",

]scrapy-rotating-proxies मिडलवेयर का उपयोग पूल प्रबंधन के लिए करें।

शीर्ष अभ्यास

fake-useragentके साथ आईपी रोटेशन के साथ यूजर-एजेंट स्ट्रिंग बदलें।- अनुरोधों के बीच यादृच्छिक देरी जोड़ें:

time.sleep(random.uniform(1, 3))। - प्रॉक्सी स्वास्थ्य की निगरानी करें और एक बार निष्क्रिय आईपी को अपने पूल से हटा दें।

- टीएलएस जांच के लिए एचटीटीपीएस प्रॉक्सी का उपयोग करें।

लिनक्स पर वेब स्क्रैपिंग के साथ काम करने वाले प्रॉक्सी प्रदाताओं की एक संकलित सूची के लिए, वेब स्क्रैपिंग के लिए सर्वोत्तम प्रॉक्सी सेवाएं एक उपयोगी शुरुआत है।

डेटा निकालने पाइपलाइन में कैपचा निपटान

कैपचा चुनौतियां लिनक्स में उत्पादन वेब स्क्रैपिंग के सबसे आम ब्लॉकर हैं। साइट ऑटोमेटेड डेटा निकालने पाइपलाइन को बाधित करने के लिए reCAPTCHA v2/v3, hCaptcha, Cloudflare Turnstile और अन्य चुनौतियां लगातार उपयोग करते हैं। reCAPTCHA v2 के उपयोग के बारे में CapSolver के reCAPTCHA v2 एपीआई एक्सेस गाइड के अनुसार दुनिया भर में 5 मिलियन से अधिक साइटों द्वारा उपयोग किया जाता है।

कैपचा का हाथ से हल करना स्केलेबल नहीं है। व्यावहारिक समाधान अपने स्क्रैपिंग वर्कफ़्लो में सीधे प्रोग्रामेटिक कैपचा हल करने वाले एपीआई के साथ एकीकरण है। CapSolver एक आर्टिफिशियल इंटेलिजेंस पर आधारित सेवा है जो reCAPTCHA, hCaptcha, Cloudflare Turnstile, GeeTest, AWS WAF और अन्य चुनौति प्रकारों के माध्यम से एक आरएसटी एपीआई के माध्यम से हल करता है, आमतौर पर 1-5 सेकंड में एक वैध टोकन लौटाता है — बिना मानव हस्तक्षेप के।

CapSolver बोनस कोड के साथ अपना लाभ लें

अपने स्वचालन बजट को तत्काल बढ़ाएं!

CapSolver खाता में रीचार्ज करते समय बोनस कोड CAP26 का उपयोग करें ताकि प्रत्येक रीचार्ज पर 5% बोनस प्राप्त करें — कोई सीमा नहीं।

अपने CapSolver डैशबोर्ड में अब बोनस कोड का उपयोग करें

CapSolver कैसे काम करता है

- आपका स्क्रैपर लक्ष्य पृष्ठ पर कैपचा की पहचान करता है।

- आप एपीआई के

createTaskएंडपॉइंट पर साइट URL और साइट कुंजी भेजते हैं। - CapSolver के आर्टिफिशियल इंटेलिजेंस मॉडल कैपचा चुनौती हल करता है और एक टोकन लौटाता है।

- आप टोकन को अपने फॉर्म उपस्थापना या अनुरोध हेडर में डालते हैं।

- स्क्रैपर बाधा के बिना जारी रहता है।

पायथन एकीकरण उदाहरण (reCAPTCHA v2 — प्रॉक्सी बिना)

निम्नलिखित उदाहरण CapSolver के आधिकारिक एपीआई दस्तावेज़ के आधार पर है:

python

import requests

import time

# आपका CapSolver API कुंजी

API_KEY = "YOUR_CAPSOLVER_API_KEY"

WEBSITE_URL = "https://example.com"

WEBSITE_KEY = "YOUR_RECAPTCHA_SITE_KEY"

def create_task():

payload = {

"clientKey": API_KEY,

"task": {

"type": "ReCaptchaV2TaskProxyLess",

"websiteURL": WEBSITE_URL,

"websiteKey": WEBSITE_KEY,

}

}

response = requests.post(

"https://api.capsolver.com/createTask",

json=payload

)

return response.json().get("taskId")

def get_task_result(task_id):

payload = {

"clientKey": API_KEY,

"taskId": task_id,

}

while True:

response = requests.post(

"https://api.capsolver.com/getTaskResult",

json=payload

)

result = response.json()

if result.get("status") == "ready":

return result["solution"]["gRecaptchaResponse"]

time.sleep(2)

task_id = create_task()

token = get_task_result(task_id)

print("कैपचा टोकन:", token)इस टोकन को फॉर्म के g-recaptcha-response क्षेत्र में डाला जाता है, जिससे आपका स्क्रैपर कैपचा गेट के पार चलता रहता है। प्रॉक्सी-आधारित कार्य के लिए, कार्य प्रकार के साथ ReCaptchaV2Task पर बदलें और अपने प्रॉक्सी विवरण के साथ पैलोड में जोड़ें।

CapSolver दो कार्य मोड समर्थन करता है:

ReCaptchaV2TaskProxyLess— CapSolver के अपने संरचना का उपयोग करता है; सरल सेटअप।ReCaptchaV2Task— आपके अपने प्रॉक्सी का उपयोग करता है; अक्सर भू-सीमा नियमों के सख्त लक्ष्य के लिए बेहतर।

पूर्ण सूची के लिए समर्थित कार्य प्रकार — reCAPTCHA v3, Cloudflare Turnstile, और AWS WAF सहित — CapSolver कार्य प्रकार दस्तावेज़ देखें।

लिनक्स पर पूर्ण डेटा निकालने पाइपलाइन बनाएं

लिनक्स पर उत्पादन-कक्षा वेब स्क्रैपिंग सेटअप एक एकल स्क्रिप्ट से अधिक है। यह अलग-अलग, एक साथ काम करने वाले चरणों के साथ एक पाइपलाइन है।

पाइपलाइन वास्तुकला

[स्केड्यूलर: क्रॉन]

→ [स्क्रैपर: स्क्रैपी / प्लेयराइट]

→ [प्रॉक्सी लेयर: रोटेटिंग आवासीय]

→ [कैपचा हैंडलर: CapSolver API]

→ [पार्सर: BeautifulSoup / lxml]

→ [संग्रह: SQLite / PostgreSQL]

→ [एक्सपोर्ट: CSV / JSON / आरएसटी एपीआई]क्रॉन के साथ स्केड्यूलिंग

हर घंटे एक स्क्रैपिंग कार्य चलाने के लिए अपना क्रॉनटैब संपादित करें:

bash

crontab -eनिम्नलिखित पंक्ति जोड़ें:

0 * * * * /home/user/scraper-env/bin/python /home/user/scraper/run.py >> /home/user/scraper/logs/scrape.log 2>&1स्क्रैप किया डेटा संग्रहीत करें

छोटे परियोजनाओं के लिए SQLite पर्याप्त है:

python

import sqlite3

conn = sqlite3.connect("data.db")

cursor = conn.cursor()

cursor.execute(

"CREATE TABLE IF NOT EXISTS products (name TEXT, price TEXT, url TEXT)"

)

cursor.execute(

"INSERT INTO products VALUES (?, ?, ?)", (name, price, url)

)

conn.commit()

conn.close()बड़े पाइपलाइन के लिए, SQL एलक्यूएल के साथ पोस्टग्रेसक्यूएल बेहतर समानांतरता और अनुरोध प्रदर्शन प्रदान करता है।

लॉगिंग और त्रुटि निपटान

हमेशा स्क्रैपिंग गतिविधि के लॉग करें। पायथन के आंतरिक logging मॉड्यूल का उपयोग करें:

python

import logging

logging.basicConfig(

filename="scrape.log",

level=logging.INFO,

format="%(asctime)s %(levelname)s %(message)s"

)

logging.info("स्क्रैप शुरू हो गया")संरचित लॉगिंग लंबे समय तक चलने वाले लिनक्स वेब स्क्रैपिंग कार्य में असफलता के निरीक्षण को बहुत आसान बनाता है — विशेष रूप से जब प्रॉक्सी त्रुटियां और कैपचा समय सीमा शामिल होते हैं।

सुसंगतता और जिम्मेदार स्क्रैपिंग

लिनक्स पर स्क्रैपिंग एक शक्तिशाली क्षमता है, लेकिन इसका जिम्मेदारी से उपयोग करना आवश्यक है।

robots.txtकी जांच करें — स्क्रैपिंग से पहले हमेशाhttps://example.com/robots.txtकी जांच करें।Disallowनिर्देशों का सम्मान करें।- दर सीमा — सर्वर को नुकसान न करें। अनुरोधों के बीच देरी जोड़ें ताकि साइट प्रदर्शन कम न हो।

- सेवा की शर्तें — लक्ष्य साइट की शर्तों की समीक्षा करें। कुछ साइट ऑटोमेटेड डेटा एकत्र करने के विरोध में होते हैं।

- व्यक्तिगत डेटा — एप्लीकेबल नियमों के अनुसार कानूनी आधार के बिना व्यक्तिगत रूप से पहचाने जाने वाले जानकारी के निकालने से बचें, जैसे कि जीडीपीआर।

- कॉपीराइट — स्क्रैप किया डेटा कॉपीराइट से सुरक्षित हो सकता है। डेटा विश्लेषण के लिए उपयोग करें, न कि प्रकाशन।

जिम्मेदार स्क्रैपिंग नैतिक विचार के अलावा एक कानूनी विचार है। ऑटोमेटेड डेटा एकत्र करने के ढांचा बदलते रहते हैं, और अपने पाइपलाइन में सुसंगतता शुरू से शामिल करना बेहतर है जबकि बाद में इसे जोड़ने के बजाय।

निष्कर्ष

लिनक्स पर स्क्रैपिंग डेटा निकालने के लिए किसी भी पैमाने पर एक स्थिर, स्क्रिप्टेबल और लागत-प्रभावी आधार प्रदान करता है। पायथन स्क्रैपिंग टूल्स के संयोजन के साथ एक अच्छी तरह से कॉन्फ़िगरेशन प्रॉक्सी लेयर और प्रोग्रामेटिक कैपचा हल करने वाली सेवा के साथ पूरा चुनौतियों के व्यापक श्रृंखला को कवर करता है। शुरू में एक साफ वर्चुअल पर्यावरण के साथ शुरू करें, लक्ष्य साइट की जटिलता के आधार पर अपने टूल्स चुनें और अपने पाइपलाइन को धीरे-धीरे बनाएं — स्केड्यूलिंग, संग्रह और त्रुटि निपटान शामिल होते हैं।

यदि CAPTCHA चुनौतियां आपके स्क्रैपिंग वर्कफ़्लो को अवरुद्ध कर रही हैं, CapSolver के साथ शुरू करें और कुछ मिनटों में अपने पाइपलाइन में AI-शक्ति CAPTCHA हल करने के साथ जुड़ें।

अक्सर पूछे जाने वाले प्रश्न

Q1: लिनक्स पर वेब स्क्रैपिंग के लिए सबसे अच्छा पायथन लाइब्रेरी क्या है?

इसका उत्तर उपयोग के मामले पर निर्भर करता है। स्थिर पृष्ठों के लिए, Requests और BeautifulSoup के साथ जुड़े हुए सबसे तेज और सरल विकल्प है। बड़े पैमाने पर, नियमित खोजों के लिए, Scrapy उद्योग मानक है। जावास्क्रिप्ट-भारी पृष्ठों के लिए, लिनक्स पर Playwright सिफारिश की गई चयन है।

Q2: लिनक्स पर वेब स्क्रैपर को स्वचालित रूप से कैसे चलाएं?

क्रॉन जॉब्स का उपयोग करें। crontab -e के साथ अपने क्रॉनटैब को संपादित करें और आवश्यक योजना और पायथन स्क्रिप्ट के मार्ग के साथ एक पंक्ति जोड़ें। इससे आपका स्क्रैपर किसी भी अंतराल पर हाथ बिना हस्तक्षेप के चलता है।

Q3: वेब स्क्रैपिंग पाइपलाइन में CAPTCHA कैसे संभालें?

CapSolver जैसे CAPTCHA हल करने वाले API के साथ जुड़ें। आपका स्क्रैपर एपीआई को साइट के यूआरएल और साइट कुंजी भेजता है, एपीआई से हल किया गया टोकन प्राप्त करता है, और उसे अनुरोध में डाल देता है। इस प्रक्रिया को पूरी तरह से स्वचालित रखा गया है और प्रत्येक CAPTCHA के सामना करने पर केवल कुछ सेकंड की देरी जोड़ता है।

Q4: लिनक्स पर वेब स्क्रैपिंग के लिए प्रॉक्सी आवश्यक हैं?

छोटे या अपेक्षाकृत दुर्लभ स्क्रैपिंग कार्यों के लिए, प्रॉक्सी की आवश्यकता नहीं हो सकती है। बड़े पैमाने पर या लगातार डेटा निकालने के पाइपलाइन में, आईपी-आधारित दर सीमा लगाने और ब्लॉक करने से बचने के लिए घूमते प्रॉक्सी आवश्यक हैं।

Q5: लिनक्स पर वेब स्क्रैपिंग कानूनी है?

वेब स्क्रैपिंग सामान्य रूप से जनता के लिए उपलब्ध डेटा पर लागू करने पर कानूनी होती है। हालांकि, आपको लक्षित साइट के robots.txt, उपयोग के शर्तों और लागू डेटा सुरक्षा कानूनों के सम्मान करना आवश्यक है। अनुमति के बिना व्यक्तिगत डेटा या कॉपीराइट वाली सामग्री के स्क्रैपिंग कानूनी जोखिम ले सकता है।

और देखें

Apr 30, 2026

क्लाउडफ़्लेयर त्रुटि 1020: पहुंच अस्वीकृत कर दिया गया वेब स्क्रैपिंग & WAF सुरक्षा में

जानें कि क्लाउडफ़्लेयर एरर 1020 एक्सेस अस्वीकृत के क्या कारण होते हैं, कैसे वेब एप्लिकेशन फ़ायरवॉल और बॉट डिटेक्शन काम करते हैं, और विकासकर्ता कैसे वैध स्वचालन प्रक्रियाओं में गलत सकारात्मकों को कम कर सकते हैं।

Apr 29, 2026

2026 में क्रोम के लिए सर्वश्रेष्ठ ऑटो CAPTCHA सॉल्वर एक्सटेंशन्स

2026 में सबसे अच्छे ऑटो CAPTCHA सॉल्वर क्रोम एक्सटेंशन्स खोजें। गति, समर्थित प्रकार और गोपनीयता के आधार पर CapSolver, NopeCHA और SolveCaptcha की तुलना करें ताकि सही फिट खोजें।