AI एजेंट्स वेब स्क्रैपिंग एवं प्रतिस्पर्धी जानकारी गाइड

Rajinder Singh

Deep Learning Researcher

TL;DR

- AI एजेंट्स स्वायत्त सॉफ्टवेयर प्रणालियाँ हैं जो बिना लगातार मानव इनपुट के बहु-चरणीय डेटा संग्रह कार्यकलापों को योजना बनाते, कार्यान्वित करते और अनुकूलित करते हैं।

- AI एजेंट्स उद्योग में, वेब स्क्रैपिंग और प्रतिस्पर्धी बुद्धिमता सबसे तेजी से बढ़ते अनुप्रयोग क्षेत्र हैं।

- AI एजेंट्स प्रतिद्वंद्वी मूल्य निगरानी कर सकते हैं, उत्पाद परिवर्तनों का ट्रैक कर सकते हैं, और मानवीय टीम के बराबर के पैमाने पर संरचित डेटा निकाल सकते हैं।

- आधुनिक वेबसाइट CAPTCHA, दर-सीमा निर्धारण और बॉट-पहचान परतें लगाती हैं जो स्वचालित पाइपलाइन को बाधित करती हैं — CAPTCHA हल करने वाली सेवाएं जैसे CapSolver एजेंट्स के लिए निरंतरता बनाए रखने में मदद करती हैं।

- डेटा संग्रह के लिए AI एजेंट्स के जिम्मेदार और संगत उपयोग के लिए robots.txt, उपयोग के शर्तों और लागू डेटा नियमों का सम्मान करना आवश्यक है।

परिचय

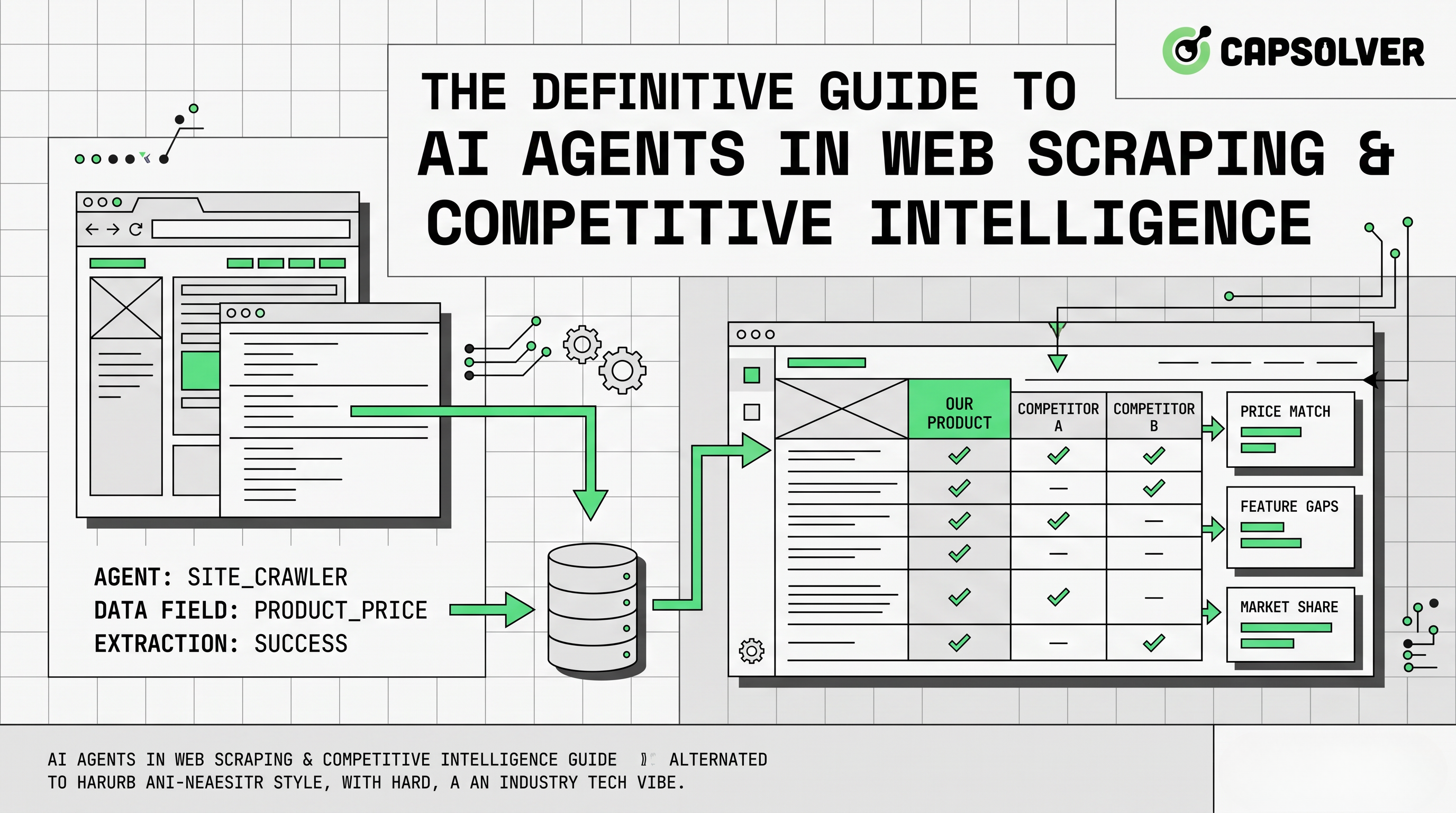

AI एजेंट्स बिजनेस के बाहरी डेटा के संग्रह और क्रियान्वयन के तरीके को बदल रहे हैं। AI एजेंट्स उद्योग में, दो उपयोग केस लगभग किसी अन्य के बराबर तेजी से उत्पादन में आए हैं: वेब स्क्रैपिंग और प्रतिस्पर्धी बुद्धिमता। कंपनियां अब एजेंट्स लगाती हैं जो स्वतंत्र रूप से वेब पर ब्राउज़ करते हैं, संरचित जानकारी निकालते हैं, और इसे मूल्य इंजन, बाजार डैशबोर्ड और रणनीतिक रिपोर्ट में सीधे भेजते हैं — बिना किसी मानव द्वारा किसी भी बटन पर क्लिक किए। यह लेख यह समझाता है कि ये एजेंट क्या हैं, वे कैसे काम करते हैं, जहां वे सबसे अधिक मूल्य जोड़ते हैं, और जब टीम जिम्मेदार और उत्पादन-मानक पाइपलाइन बनाते हैं तो वे कौन-कौन सी तकनीकी बाधाओं (शामिल हैं CAPTCHA) को योजना बनाने के लिए आवश्यकता होती है।

AI एजेंट्स क्या हैं, और डेटा संग्रह के लिए वे क्यों महत्वपूर्ण हैं?

एक AI एजेंट एक सॉफ्टवेयर प्रोग्राम है जो अपने वातावरण को देखता है, लक्ष्य के बारे में तर्क करता है, और इसे पूरा करने के लिए क्रम में कार्य करता है — फिर जो वह देखता है उस पर अनुकूलित करता है। एक सरल स्क्रिप्ट के विपरीत, जो एक निश्चित पथ का पालन करता है, एजेंट कौन सा पेज अगला देखेगा, कैसे अप्रत्याशित लेआउट परिवर्तन का निपटारा करेगा, और कब एक विफल अनुरोध की पुनर्प्रयास करेगा, इसका निर्णय ले सकता है।

IBM AI एजेंट्स की परिभाषा के अनुसार एजेंट्स एक लगातार लूप में अवलोकन, तर्क और कार्य करते हैं। यह लूप ठीक वही है जो उन्हें डेटा संग्रह के लिए शक्तिशाली बनाता है: वेब काफी असंगठित, डायनामिक और अस्थिर है, और एक तर्क परत इस विचरण के साथ बेहतर तरीके से निपटती है जबकि एक कठोर स्क्रैपर नहीं कर सकता।

AI एजेंट्स उद्योग अद्भुत गति से बढ़ रहा है। MarketsandMarkets के अनुसार, वैश्विक AI एजेंट्स बाजार 2025 में 7.84 बिलियन अमेरिकी डॉलर से 2030 तक 52.62 बिलियन अमेरिकी डॉलर तक बढ़ेगा, 46.3% के CAGR के साथ। अनुसंधान और डेटा संग्रह अब उत्पादन उपयोग केस के शीर्ष तीन में से एक हैं। LangChain AI एजेंट्स रिपोर्ट पाया गया कि 2024 तक जांच करने वाली कंपनियों में 51% एजेंट्स उत्पादन में चल रहे थे, जबकि अनुसंधान और डेटा एकत्रीकरण को अग्रणी अनुप्रयोग के रूप में बताया गया था — ग्राहक सेवा और व्यक्तिगत उत्पादकता के आगे।

मुख्य आर्किटेक्चर: AI एजेंट कैसे स्क्रैपिंग पाइपलाइन में काम करते हैं

आर्किटेक्चर की समझ टीमों के लिए अधिक विश्वसनीय प्रणालियाँ बनाने में मदद करती है। एक पारंपरिक AI एजेंट्स उद्योग स्क्रैपिंग पाइपलाइन में चार परतें होती हैं:

1. योजना परत

एजेंट को एक उच्च-स्तरीय लक्ष्य मिलता है — उदाहरण के लिए, "तीन प्रतिद्वंद्वी साइटों पर शीर्ष 50 SKUs के दैनिक मूल्य एकत्र करें।" यह इसे उप-कार्यों में विभाजित करता है: URL पहचानें, अनुरोध योजना बनाएं, निकालने के नियम परिभाषित करें। अधिक उन्नत सेटअप में, योजना परत LLM का उपयोग करती है जो एक चरण-दर-चरण कार्यान्वयन योजना बनाती है जिसे चलते समय स्थिति में परिवर्तन के साथ बदला जा सकता है।

2. कार्यान्वित परत

एजेंट HTTP अनुरोध भेजता है या एक बिना स्क्रीन ब्राउज़र (Playwright, Puppeteer, Selenium) को नियंत्रित करता है। यह HTML, JSON APIs, या रेंडर्ड जावास्क्रिप्ट सामग्री का विश्लेषण करता है और इसे संरचित आउटपुट फॉर्मेट में मैप करता है। कार्यान्वित परत को पैजिनेशन, असीमित स्क्रॉल, लॉगिन प्रवाह और क्लाइंट-साइड डायनामिक सामग्री का निपटारा करना आवश्यक है — ये सभी ऐसे मामले हैं जहां एक स्थिर स्क्रैपर विफल हो जाएगा।

3. अवलोकन और अनुकूलन परत

प्रत्येक कार्य के बाद, एजेंट परिणाम जांचता है। क्या पेज सही तरीके से लोड हुआ? क्या अपेक्षित डेटा उपलब्ध था? क्या एक CAPTCHA दिखाई दिया? अवलोकन के आधार पर, यह अगला कदम निर्णय करता है — पुनर्प्रयास, उत्थान या आगे बढ़ें। यह परत एजेंट्स को स्क्रिप्ट से वास्तविक रूप से अलग करती है: वे केवल कार्यान्वित नहीं करते, बल्कि मूल्यांकन भी करते हैं।

4. स्मृति और संग्रहण परत

निकाला गया डेटा डेटाबेस, डेटा वर्चस्व या अगले पाइपलाइन में लिखा जाता है। कुछ एजेंट्स लघुकालीन स्मृति (सत्र संदर्भ) और दीर्घकालीन स्मृति (इतिहास मूल्य ट्रेंड, ज्ञात URL पैटर्न) बनाए रखते हैं। दीर्घकालीन स्मृति एजेंट को असामान्यता की पहचान करने में सक्षम बनाती है — उदाहरण के लिए, एक मूल्य जो एक रात में 80% तक गिर जाता है, एक डेटा त्रुटि हो सकती है, न कि वास्तविक छूट।

इस चार-परत मॉडल के कारण आधुनिक डेटा संग्रह पाइपलाइन पारंपरिक cron-जॉब स्क्रैपर से अलग होती है। एजेंट केवल पृष्ठ नहीं ले रहा है — यह कार्य के बारे में तर्क कर रहा है, और इस अंतर का उत्पादन पैमाने पर महत्व है।

प्रतिस्पर्धी बुद्धिमता में मुख्य उपयोग मामले

प्रतिस्पर्धी बुद्धिमता AI एजेंट्स उद्योग के उपकरणों के सबसे उच्च मूल्य वाले अनुप्रयोग है। यहां वे सबसे सामान्य स्थितियां हैं जहां टीम आज एजेंट्स का उपयोग करती हैं:

मूल्य निगरानी

ई-कॉमर्स टीम लगभग वास्तविक समय में हजारों SKUs के आसपास प्रतिद्वंद्वी मूल्य ट्रैक करने के लिए एजेंट्स का उपयोग करती हैं। एजेंट उत्पाद पृष्ठों पर जाता है, मूल्य और उपलब्धता डेटा निकालता है, और इसे एक मूल्य इंजन में लिखता है जो स्वचालित समायोजन के लिए चल सकता है। इस पैमाने पर मानव निगरानी व्यवहार्य नहीं है — एक एकल विश्लेषक दिन में 50 उत्पादों की निगरानी कर सकता है; एजेंट 50,000 उत्पादों की निगरानी कर सकता है।

एजेंट की अवलोकन परत यहां आवश्यक है। यदि एक उत्पाद पृष्ठ 429 (बहुत अधिक अनुरोध) स्थिति लौटाता है, तो एजेंट पीछे हट जाता है और एक्स्पोनेंशियल देरी के साथ पुनर्प्रयास करता है। यदि पृष्ठ लेआउट बदल जाता है — जो वेबसाइट पुनर्डिज़ाइन के दौरान आम बात है — तो एजेंट LLM का उपयोग करके मूल्य तत्व की पहचान कर सकता है बजाय खामोश रूप से विफल होने के।

उत्पाद और विशेषता ट्रैकिंग

SaaS कंपनियां प्रतिद्वंद्वी चेंजलॉग पृष्ठ, जारी नोट्स और विशेषता घोषणा ब्लॉग की निगरानी करने के लिए एजेंट्स लगाती हैं। जब एक प्रतिद्वंद्वी एक नई एकीकरण जारी करता है या मूल्य श्रेणी बदलता है, तो एजेंट घंटों में इसे चिह्नित करता है बजाय दिनों में। उत्पाद प्रबंधकों को कच्चे HTML डंप के बजाय संरचित सारांश मिलते हैं, क्योंकि एजेंट के निकालने की परत सामग्री को पूर्वनिर्धारित स्कीमा में मैप करती है: विशेषता का नाम, जारी तिथि, प्रभावित श्रेणी और सारांश।

इस तरह के सतत निगरानी के लिए पहले एक विशेष विश्लेषक की आवश्यकता होती थी। आज AI एजेंट्स उद्योग में, यह एक योजना बैकग्राउंड प्रक्रिया के रूप में चलता है।

समीक्षा और भावना संग्रह

एजेंट्स G2, Trustpilot और एप्प स्टोर जैसे प्लेटफॉर्म से ग्राहक समीक्षाओं को एकत्र करते हैं। फिर प्राकृतिक भाषा प्रसंस्करण परत भावना वर्गीकरण करती है, बार-बार विषय निकालती है और उत्पाद अंतर उजागर करती है — जो उत्पाद टीमों के लिए बाजार से एक सतत संकेत देता है। एक टीम यह पहचान सकती है कि एक प्रतिद्वंद्वी के उपयोक्ता लगातार धीमी एनओएन शिकायत करते हैं, फिर इस जानकारी का उपयोग अपनी स्थिति को अधिक स्पष्ट करने के लिए कर सकती है।

SERP और सामग्री निगरानी

SEO और सामग्री टीम शब्दांकन रैंकिंग, बैकलिंक प्रोफाइल की निगरानी करती हैं और प्रतिद्वंद्वी द्वारा जारी नई सामग्री की पहचान करती हैं। यह सीधे संपादकीय कैलेंडर और लिंक-निर्माण रणनीतियों में लगातार जाता है। एजेंट्स यह भी पहचान सकते हैं कि क्या एक प्रतिद्वंद्वी आपके वर्तमान रैंकिंग वाले शब्दांकन के लिए सामग्री जारी करता है, जिससे रैंकिंग बदलने से पहले चेतावनी देने के लिए एक चेतावनी उत्पन्न होती है।

नौकरी पोस्टिंग बुद्धिमता

प्रतिद्वंद्वी नौकरी पोस्टिंग का ट्रैक करना रणनीतिक इरादा बताता है। एक अचानक बढ़त डेटा इंजीनियरिंग नियुक्ति में एक प्लेटफॉर्म पुनर्निर्माण के संकेत के रूप में दिखाई देती है। एंटरप्राइज सेल्स भागों के एक समूह के संकेत बाजार विस्तार के रूप में दिखाई देते हैं। एजेंट्स दिन-प्रतिदिन कैरियर पृष्ठों की निगरानी कर सकते हैं और इस संकेत को स्वचालित रूप से एकत्रित कर सकते हैं, जो रणनीति टीमों के लिए एक प्रमुख संकेत होता है जो अक्सर विज्ञप्ति विज्ञप्ति से अधिक विश्वसनीय होता है।

एक व्यापक दृष्टिकोण के लिए, देखें 2026 में शीर्ष वेब स्क्रैपिंग उपकरण और शीर्ष डेटा निकालने उपकरण।

तुलना: पारंपरिक स्क्रैपर्स वर्सेस AI एजेंट्स

| आयाम | पारंपरिक स्क्रैपर | AI एजेंट |

|---|---|---|

| कार्य परिभाषा | निश्चित सेलेक्टर, कठोर पथ | लक्ष्य-आधारित, अनुकूलित |

| लेआउट परिवर्तन का निपटारा | टूट जाता है, हस्तचालित ठीक करने की आवश्यकता होती है | पहचानता है और अनुकूलित करता है |

| बहु-चरण नेविगेशन | सीमित | मूलभूत क्षमता |

| त्रुटि बहाली | हस्तचालित हस्तक्षेप | स्वचालित पुनर्प्रयास तंत्र |

| CAPTCHA निपटारा | पाइपलाइन रोक देता है | समाधान सेवाओं के साथ एकीकरण कर सकता है |

| एक्स्पैंसिबिलिटी | इंजीनियरिंग प्रयास के साथ रैखिक | गणना के साथ बढ़ता है |

| संगतता जागरूकता | कोई निर्मित नहीं | नियमों के सम्मान करने के लिए निर्देशित किया जा सकता है |

CAPTCHA समस्या: जहां AI एजेंट्स एक दीवार तक पहुंचते हैं

अधिकतम उन्नत AI एजेंट्स उद्योग पाइपलाइन अंततः CAPTCHA का सामना करता है। वेबसाइट इसका उपयोग ऑटोमेटिक एक्सेस के खिलाफ एक प्राथमिक रक्षा के रूप में करते हैं। सबसे आम प्रकार शामिल हैं:

- reCAPTCHA v2 — चित्र-चयन चुनौतियां ("सभी ट्रैफिक लाइट चुनें")

- reCAPTCHA v3 — अदृश्य, स्कोर-आधारित जोखिम मूल्यांकन

- Cloudflare Turnstile — एक नए, गोपनीयता-केंद्रित चुनौती जो पारंपरिक CAPTCHA के स्थान ले लेता है

- GeeTest — एशियाई प्लेटफॉर्म पर स्लाइडर और व्यवहार चुनौतियां सामान्य हैं

जब एजेंट CAPTCHA का सामना करता है, तो पाइपलाइन रुक जाती है। एजेंट के पास वैध टोकन या पूरा चुनौती बिना कोई रुकावट नहीं होती। यह एक संरचनात्मक समस्या है, एक अलग मामला नहीं — उच्च-मूल्य डेटा स्रोत लगभग हमेशा सुरक्षित होते हैं।

संगत समाधान एजेंट के अवलोकन परत में CAPTCHA हल करने वाली API के एकीकरण के साथ होता है। जब एजेंट चुनौती का पता लगाता है, तो वह संबंधित पैरामीटर को समाधान सेवा को पास करता है, टोकन प्राप्त करता है, और इसे अनुरोध में डालता है ताकि आगे बढ़ सके। एजेंट को कभी भी रुकने की आवश्यकता नहीं होती।

CapSolver एक AI-शक्ति CAPTCHA हल करने वाली सेवा है जो इस एकीकरण पैटर्न के लिए विशेष रूप से बनाई गई है। यह reCAPTCHA v2/v3/Enterprise, Cloudflare Turnstile, GeeTest और AWS WAF CAPTCHA का समर्थन करता है। समाधान 1-5 सेकंड में REST API के माध्यम से लौटाए जाते हैं, कोई मानव भागीदारी बिना — पूरा प्रवाह स्वचालित रहता है।

पायथन में AI एजेंट्स उद्योग पाइपलाइन बनाने वाली टीम के लिए, एकीकरण पैटर्न CapSolver के आधिकारिक API दस्तावेज़ में दस्तावेज़ के अनुसार अनुसरण करता है। एजेंट एक कार्य जमा करता है, परिणाम के लिए पॉल करता है, और वापस टोकन का उपयोग रक्षित अनुरोध पूरा करने के लिए करता है। यह पाइपलाइन को हस्तक्षेप के बिना चलता रहता है।

आप वेब स्क्रैपिंग के दौरान CAPTCHA हल करने के बारे में जान सकते हैं आम एकीकरण पैटर्न के एक व्यावहारिक चलाने के लिए।

CapSolver बोनस कोड के लिए बीमा करें

अपने स्वचालन बजट को तुरंत बढ़ाएं!

CapSolver खाता में जाते समय बोनस कोड CAP26 का उपयोग करें ताकि हर भरोसा पर 5% बोनस मिले — कोई सीमा नहीं।

अब अपने CapSolver डैशबोर्ड में बीमा करें

स्क्रैपिंग वर्कफ़्लो में उपयोग किए जाने वाले AI एजेंट फ्रेमवर्क

कई खुले स्रोत और वाणिज्यिक फ्रेमवर्क डेटा संग्रह के लिए AI एजेंट्स उद्योग उपयोग केस के लिए विशेष रूप से विकसित हुए हैं:

- LangChain / LangGraph — उपकरणों के साथ बहु-चरणीय तर्क एजेंट बनाने के लिए लोकप्रिय

- AutoGen (माइक्रोसॉफ्ट) — बहु-एजेंट सहयोग का समर्थन करता है, जो समानांतर स्क्रैपिंग कार्यों के लिए उपयोगी है

- CrewAI — भूमिका-आधारित एजेंट नियंत्रण, प्रतिस्पर्धी बुद्धिमता वर्कफ़्लो के लिए अच्छी तरह से अनुकूलित

- Crawl4AI — AI-मित्र वेब बुलाने के लिए उद्देश्य-आधारित, संरचित आउटपुट के साथ

- ScrapeGraph AI — LLM के साथ स्क्रैपिंग के संयोजन करता है ताकि प्राकृतिक भाषा निर्देशों के उपयोग से डेटा निकाला जा सके

अग्रणी विकल्पों के विस्तृत विश्लेषण के लिए, देखें 2026 में शीर्ष 9 AI एजेंट फ्रेमवर्क।

प्रत्येक फ्रेमवर्क योजना और कार्यान्वित परत को अलग-अलग तरीके से संभालता है, लेकिन सभी अंततः एक ही बुनियादी चुनौतियों का सामना करते हैं: दर-सीमा, IP ब्लॉकिंग, और CAPTCHA। फ्रेमवर्क चयन आर्किटेक्चर को प्रभावित करता है; CAPTCHA हल करने वाली परत एक अलग, संयोजित घटक है।

संगतता और जिम्मेदार उपयोग

AI एजेंट्स उद्योग कानूनी और नैतिक वातावरण में काम करता है जिसे टीमों को गंभीरता से लेना चाहिए। स्वचालित डेटा संग्रह अपन आप अवैध नहीं होता है, लेकिन जिम्मेदारी से किया जाना चाहिए।

मुख्य सिद्धांत:

- robots.txt का सम्मान करें — यह फ़ाइल संकेत देता है कि कौन से मार्ग एक साइट मालिक ऑटोमेटिक एक्सेस की अनुमति देता है। एजेंट्स को इसे पार्स करना चाहिए और इसका सम्मान करना चाहिए।

- उपयोग की शर्तों की समीक्षा करें — कई साइटें ऑटोमेटिक स्क्रैपिंग के खिलाफ व्यक्तिगत रूप से रोकती हैं। उच्च आयतन या व्यावसायिक रूप से संवेदनशील उपयोग केस के लिए कानूनी समीक्षा उपयुक्त है।

- दर-सीमा निर्धारण — एजेंट्स को देरी के साथ अनुरोध करना चाहिए और रीट्री-एफ्टर हेडर का सम्मान करना चाहिए ताकि लक्ष्य सर्वर को अतिभार न लगे।

- व्यक्तिगत डेटा — निजी रूप से पहचाने जाने वाले जानकारी के संग्रह के लिए GDPR, CCPA और अन्य नियम लागू होते हैं। एजेंट्स केवल आवश्यक डेटा के लिए सीमित होना चाहिए।

- डेटा ताजगी और सटीकता — प्रतिस्पर्धी बुद्धिमता केवल तभी मूल्यवान होता है जब डेटा विश्वसनीय हो। एजेंट्स को असामान्यता के लिए वैधता चरण शामिल करना चाहिए।

Agentic AI पर Deloitte के अनुसंधान उन एजेंट्स के उत्पादन में एकीकरण करने वाली एंटरप्राइज टीमों के लिए नियमन और निगरानी शीर्ष चिंताएं बताता है। एजेंट के निर्देश सेट में संगतता शामिल करना बाद में इसे बनाने के बजाय शुरू से बनाना बहुत आसान होता है।

निष्कर्ष

AI एजेंट्स AI एजेंट्स उद्योग में अनुसंधान अवधारणा से उत्पादन उपकरण में बदल गए हैं, और वेब स्क्रैपिंग के साथ प्रतिस्पर्धी बुद्धिमता उनके मूल्य के सबसे स्पष्ट उदाहरण है। वे डायनामिक पृष्ठों के साथ निपटते हैं, लेआउट परिवर्तनों के अनुकूलित करते हैं, बहु-चरण नेविगेशन कार्यान्वित करते हैं, और ऐसे आयाम तक पहुंचते हैं जिसके लिए कोई मानवीय प्रक्रिया असंभव है।

तकनीकी चुनौतियां वास्तविक हैं — CAPTCHA, दर-सीमा, और बॉट-पहचान प्रणालियां ठीक इस प्रकार के स्वचालन को बाधित करने के लिए बनाई गई हैं। एजेंट के पाइपलाइन में CapSolver जैसी भरोसेमंद CAPTCHA हल करने वाली सेवा के एकीकरण एक सबसे आम विफलता के बिंदु को हटा देता है, डेटा संग्रह को निरंतर रखता है और संगतता को बरकरार रखता है।

यदि आप प्रतिस्पर्धी जानकारी के लिए एआई एजेंट उद्योग पाइपलाइन के निर्माण या मूल्यांकन कर रहे हैं, तो स्पष्ट डेटा लक्ष्य से शुरू करें, अपने ऑर्केस्ट्रेशन आवश्यकताओं के अनुरूप एक फ्रेमवर्क चुनें, और उत्पादन में जाने से पहले इंफ्रास्ट्रक्चर लेयर - शामिल करें CAPTCHA का निपटारा - की योजना बनाएं।

एफक्यूए

Q1: डेटा संग्रह के लिए वेब स्क्रैपर और AI एजेंट में क्या अंतर है?

एक पारंपरिक वेब स्क्रैपर एक निश्चित सेट निर्देशों का पालन करता है - विशिष्ट सेलेक्टर, पूर्वनिर्धारित यूआरएल, और एक कठोर निष्पादन पथ। AI एजेंट एक तर्क लेयर जोड़ता है: यह एक लक्ष्य की व्याख्या कर सकता है, इसे प्राप्त करने के लिए आवश्यक चरणों की योजना बना सकता है, पृष्ठ में परिवर्तन होने पर अनुकूलित हो सकता है, और त्रुटियों से स्वतः बरामद हो सकता है। पैमाने पर प्रतिस्पर्धी जानकारी के लिए, अनुकूलन क्षमता आवश्यक अंतर है।

Q2: प्रतिस्पर्धी जानकारी के लिए वेब स्क्रैपिंग के लिए AI एजेंट का उपयोग करना कानूनी है क्या?

कई विधि में स्वचालित डेटा संग्रह सार्वजनिक रूप से उपलब्ध जानकारी के लक्ष्य पर और साइट के शर्तों के सेवा और लागू डेटा सुरक्षा कानूनों के पालन के साथ कानूनी है। कानूनी ताकत देश और उपयोग के मामले के आधार पर भिन्न होती है। टीमें पैमाने पर एजेंट डेप्लॉय करने से पहले रोबोट्स.टीएक्स्ट, शर्तों की सेवा और संबंधित नियमों (जीडीपीआर, सीसीपीए) की समीक्षा करनी चाहिए।

Q3: स्क्रैपिंग के दौरान AI एजेंट CAPTCHA का निपटारा कैसे करते हैं?

जब एजेंट के सामने CAPTCHA आता है, तो यह CAPTCHA हल करने वाले API के साथ एकीकृत हो सकता है। एजेंट चुनौती के पैरामीटर को API के पास भेजता है, एक वैध टोकन प्राप्त करता है, और अनुरोध में इसे डालता है ताकि आगे बढ़ सके। सेवाएं जैसे कैपसॉल्वर इस पैटर्न का समर्थन करती हैं जो reCAPTCHA, hCaptcha, Cloudflare Turnstile, और अन्य सामान्य चुनौति प्रकार के लिए करती हैं, एक REST API के माध्यम से सेकंड में समाधान वापस करती हैं।

Q4: प्रतिस्पर्धी जानकारी पाइपलाइन के लिए कौन सा AI एजेंट फ्रेमवर्क सबसे अच्छा है?

सही चयन आपके स्टैक और वर्कफ़्लो की जटिलता पर निर्भर करता है। LangChain और LangGraph व्यापक रूप से अपनाए गए हैं और मजबूत समुदाय समर्थन है। CrewAI भूमिका-आधारित बहु-एजेंट वर्कफ़्लो के लिए उपयुक्त है। Crawl4AI और ScrapeGraph AI वेब डेटा निकालने के लिए उद्देश्य-निर्मित हैं। अधिकांश टीमें एक फ्रेमवर्क से शुरू करती हैं और पाइपलाइन के परिपक्व होने पर एकजुट इंफ्रास्ट्रक्चर घटकों - प्रॉक्सी, CAPTCHA हल करने वाले, भंडारण - को जोड़ती हैं।

Q5: प्रतिस्पर्धी जानकारी एजेंट कितनी बार चलाए जाने चाहिए?

आवृत्ति डेटा के अस्थिरता पर निर्भर करती है। ई-कॉमर्स के लिए मूल्य डेटा के घंटे बाद अपडेट की आवश्यकता हो सकती है। विशेषता ट्रैकिंग और नौकरी पोस्टिंग जानकारी को दिन या सप्ताह में चलाया जा सकता है। SERP मॉनिटरिंग आमतौर पर दिन में चलती है। एजेंट को लेआउट के आधार पर योजना बनाई जानी चाहिए कि नीचे वाले डेटा कितनी जल्दी बदलता है, लक्ष्य सर्वर पर भार और गणना की लागत के बीच संतुलन रखते हुए।

और देखें

Apr 30, 2026

क्लाउडफ़्लेयर त्रुटि 1020: पहुंच अस्वीकृत कर दिया गया वेब स्क्रैपिंग & WAF सुरक्षा में

जानें कि क्लाउडफ़्लेयर एरर 1020 एक्सेस अस्वीकृत के क्या कारण होते हैं, कैसे वेब एप्लिकेशन फ़ायरवॉल और बॉट डिटेक्शन काम करते हैं, और विकासकर्ता कैसे वैध स्वचालन प्रक्रियाओं में गलत सकारात्मकों को कम कर सकते हैं।

Apr 29, 2026

मॉनिटर करें AWS WAF-सुरक्षित उत्पाद की कीमतें n8n में CapSolver के साथ

सीखें कैसे कैपसॉल्वर n8n टेम्पलेट का उपयोग AWS WAF-सुरक्षित उत्पाद पृष्ठों को मॉनिटर करने, चुनौतियां हल करने, मूल्य निकालने, परिवर्तनों की तुलना करने और स्वचालित रूप से चेतावनियां ट्रिगर करने के लिए करें।