アマゾンをスクレイピングする方法:2026年 倫理的なデータ抽出とCAPTCHAの解決ガイド

Emma Foster

Machine Learning Engineer

10-Apr-2026

TL;Dr:

- 2026年のAmazonスクリーピングには、高度な技術が必要です。これにより、高度なボット対策を乗り越えることができます。

- ロボット.txtを尊重し、リクエストレートを管理するなど、倫理的なスクリーピングの実践が不可欠です。

- プロキシとローテーションするUser-Agentは、匿名性を維持し、IPブロックを回避するために不可欠です。

- CAPTCHAチャレンジ、特にAWS WAFは一般的であり、CapSolverなどの専門サービスを使用して効果的に解決できます。

- 環境のセットアップ、APIの統合、リクエストの処理、データの処理をカバーするステップバイステップアプローチが、成功したデータ抽出を確保します。

- コンカレンシーと分散スクリーピングを通じたパフォーマンス最適化は、効率を大幅に向上させます。

はじめに

小売業の動的な環境において、Amazonからのデータ抽出は、企業や研究者にとって重要なタスクのままです。競争分析、価格モニタリング、製品リサーチ、マーケットトレンドの特定など、さまざまな目的でAmazonスクリーピングは貴重な洞察を提供します。しかし、ウェブスクリーピング技術が進化するにつれて、Amazonなどの主要プラットフォームが採用するボット対策も進化しています。2026年のこのガイドでは、倫理的かつ効率的なAmazonスクリーピングの包括的で実用的なフレームワークを提供します。実践的なステップ、コード例、一般的な課題(特に広く普及しているAWS CAPTCHA)の解決策に焦点を当てています。WAFバイパスに関する追加の視点が必要な場合は、このAmazonスクリーピングガイド(WAFバイパス付き)を参照してください。データ抽出の成功と持続可能性を確保するために必要なツール、技術、ベストプラクティスについて詳しく説明します。

Amazonのスクリーピング対策の理解

Amazonは、多くの大規模なオンラインプラットフォームと同様に、データを保護し、公平な利用を確保するために、高度なスクリーピング対策技術のセットを採用しています。これらのメカニズムは、自動アクセスを検出および妨害するように設計されており、単純なIPブロックから高度なCAPTCHAチャレンジに至るまで、さまざまな対策が講じられています。これらの防御を理解することは、信頼性の高い[ウェブスクリーピングの回避技術](https://www.capsolver.com/blog/web scraping/web-scraping-anti-detection-techniques)の構築における第一歩です。

一般的なスクリーピング対策技術:

- IPブロックとレート制限: 短時間のうちに同一IPアドレスから繰り返しリクエストを行うと、一時的または永続的なブロックの対象になります。Amazonはリクエストの頻度とパターンを監視し、自動トラフィックを識別して制限します。

- User-Agentとヘッダーのチェック: ウェブサイトはHTTPヘッダー、特に

User-Agent文字列をチェックして、正当なブラウザトラフィックを識別します。非標準的または欠如しているUser-Agentはアラームを発動させることがあります。 - CAPTCHAチャレンジ: CAPTCHA(Completely Automated Public Turing test to tell Computers and Humans Apart)は、人間のユーザーとボットを区別するように設計されています。Amazonは頻繁にAWS WAF CAPTCHAを使用しており、複雑なJavaScriptベースのチャレンジや画像認識タスクを含みます。

- ハニーポットとトラップ: 人間のユーザーには見えないが、自動スクリーパーによって検出可能なページ上の隠しリンクや要素は、ボットの識別とブロックに使用されるトラップとなることがあります。

- 動的コンテンツの読み込み: Amazonのページの多くの部分はJavaScriptを使用して動的に読み込まれるため、単純なHTTPリクエストベースのスクリーパーではすべてのデータにアクセスするのが難しい場合があります。

倫理的なスクリーピング: 最良の実践とコンプライアンス

ウェブスクリーピングのあらゆる取り組みにおいて、倫理的および法的な考慮事項は最も重要です。これらの原則を遵守することは、コンプライアンスを確保するだけでなく、スクリーピング作業の長期的な持続可能性にも貢献します。データ収集を責任を持って行い、法的トラブルを避けるだけでなく、データソースとの良好な関係を維持することが重要です。

倫理的なガイドラインの主な点:

robots.txtを確認する: いつもrobots.txtファイル(例:https://www.amazon.com/robots.txt)をチェックし、ウェブサイトのどの部分がクローリングに禁止されているかを理解してください。これらの指示を尊重することは基本的な倫理的実践です。- 利用規約を尊重する: Amazonの利用規約に精通してください。一部の規約はスクリーピングを制限しているかもしれませんが、それらを理解することで、リスクを軽減し、情報に基づいた決定を行うことができます。

- レートリミットを実装する: リクエスト間に遅延を導入して、Amazonのサーバーを過負荷にしないようにしてください。これにより、IPブロックを防ぎ、ターゲットウェブサイトへの負荷を減らすことができます。一般的な実践として、5〜15秒のランダムな遅延を導入することが推奨されます。

- 自己紹介(責任を持って): コンタクト情報を含む説明的な

User-Agent文字列を使用してください。これにより、ウェブサイトの管理者が懸念がある場合に連絡を取ることができます。透明性を促進します。 - 公開されているデータのみをスクリーピングする: ログイン資格情報が必要ない公開データに焦点を当ててください。個人的または機密情報のスクリーピングを避けてください。

2026年のAmazonスクリーピングのステップバイステップガイド

このセクションでは、スクリーピング環境のセットアップ、リクエストの処理、データの処理を詳細に説明するアプローチを提示します。CAPTCHA解決の統合に特に焦点を当てています。

ステップ1: 環境の準備

コードを書く前に、開発環境が適切にセットアップされていることを確認してください。Pythonは、Pythonでのウェブスクリーピングに人気があり、ライブラリの豊富なエコシステムが利用できます。

目的: スクリーピングプロジェクトの安定した効率的な基盤を確立すること。

操作:

-

Pythonのインストール: まだインストールされていない場合は、公式ウェブサイトからPython 3.8+をダウンロードしてインストールしてください。

-

仮想環境の作成: このプロジェクトの依存関係を隔離します。

bashpython3 -m venv amazon_scraper_env source amazon_scraper_env/bin/activate # Windowsの場合、`amazon_scraper_env\Scripts\activate`を使用 -

必須ライブラリのインストール:

requests: HTTPリクエストを行うため。BeautifulSoup4: HTMLコンテンツを解析するため。lxml: 高速なHTMLパーサーで、BeautifulSoupとよく一緒に使用されます。selenium(オプション): 必要に応じて動的コンテンツのレンダリングに使用。webdriver_manager(オプション): Selenium用のブラウザドライバを管理するため。

bashpip install requests beautifulsoup4 lxml # Seleniumを使用する場合: # pip install selenium webdriver_manager

ノート: 定期的にライブラリを更新して、最新の機能とセキュリティパッチの恩恵を受けましょう。

ステップ2: 初期リクエストの作成と基本的なスクリーピング対策の処理

基本的なリクエストから始め、User-Agentのローテーションと遅延の実装に注力して、人間のブラウジングパターンを模倣します。

目的: Amazonにリクエストを送信し、HTMLコンテンツを取得しながら、即時のブロックのリスクを最小限に抑えること。

操作:

- User-Agentのローテーション: 常に一般的なブラウザのUser-Agentのリストを保持し、各リクエストでローテーションします。これにより、スクリーパーが異なるブラウザのように見えるようになります。

- 遅延の実装: リクエスト間にランダムな遅延を導入して、レートリミットをトリガーしないようにします。

python

import requests

import time

import random

from bs4 import BeautifulSoup

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/109.0.0.0 Safari/537.36',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/109.0.0.0 Safari/537.36',

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/108.0.0.0 Safari/537.36',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/108.0.0.0 Safari/537.36',

'Mozilla/5.0 (X11; Linux x86_64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/108.0.0.0 Safari/537.36',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/16.1 Safari/605.1.15',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 13_1) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/16.1 Safari/605.1.15',

]

def fetch_amazon_page(url):

headers = {'User-Agent': random.choice(user_agents)}

try:

response = requests.get(url, headers=headers, timeout=10)

response.raise_for_status() # HTTPエラーで例外を発生

time.sleep(random.uniform(5, 15)) # ランダムな遅延

return response.text

except requests.exceptions.RequestException as e:

print(f"リクエストに失敗しました: {e}")

return None

# 例の使用:

# product_page_url = "https://www.amazon.com/dp/B08XYZ123"

# html_content = fetch_amazon_page(product_page_url)

# if html_content:

# soup = BeautifulSoup(html_content, 'lxml')

# # soupオブジェクトを処理ノート: より高度なシナリオでは、IPアドレスのプールを管理するプロキシローテーションサービスを使用することを検討してください。これにより、Amazonスクリーピング時にさらに匿名性を高めることができます。プロキシの統合に関するより多くの洞察が必要な場合は、CAPTCHA解決のためのプロキシ統合を参照してください。これは大規模な運用において不可欠です。

ステップ3: CapSolverを使用したCAPTCHAチャレンジの処理

Amazonは頻繁にAWS WAF CAPTCHAを導入して自動リクエストをブロックしています。これらのチャレンジは、実際のブラウザ環境を必要とするトークンベースのものや、画像分類ベースのものがあります。CapSolverは、これらのタイプの両方に対して強力な解決策を提供し、AmazonスクリーピングワークフローにCAPTCHA解決をシームレスに統合できます。

目的: AWS WAF CAPTCHAチャレンジをプログラム的に解決し、データ抽出を妨げることなく継続すること。

操作:

CapSolverは、AWS WAF CAPTCHAの2つの主要なタスクタイプを提供しています。

AntiAwsWafTask: トークンベースのチャレンジ用、通常awsKey、awsIv、awsContext、awsChallengeJSなどのパラメータが必要です。AwsWafClassification: 画像分類チャレンジ用、画像と質問を提供します。

トークンベースのAWS WAF CAPTCHA(Python例)

この例では、CapSolverのAntiAwsWafTaskタイプを使用して、トークンベースのAWS WAF CAPTCHAを解決する方法を示します。これは、AmazonがJavaScriptベースのチャレンジを提示する場合に特に役立ちます。

python

import requests

import time

CAPSOLVER_API_KEY = "YOUR_CAPSOLVER_API_KEY" # 実際のCapSolver APIキーに置き換えてください

def create_aws_waf_task(website_url, aws_key, aws_iv, aws_context, aws_challenge_js, proxy=None):

payload = {

"clientKey": CAPSOLVER_API_KEY,

"task": {

"type": "AntiAwsWafTask", # 自分のプロキシを使用しない場合、"AntiAwsWafTaskProxyless"を使用

"websiteURL": website_url,

"awsKey": aws_key,

"awsIv": aws_iv,

"awsContext": aws_context,

"awsChallengeJS": aws_challenge_js

}

}

if proxy:

payload["task"]["proxy"] = proxy # プロキシが提供されている場合に追加

response = requests.post("https://api.capsolver.com/createTask", json=payload)

response.raise_for_status()

return response.json().get("taskId")

def get_task_result(task_id):

payload = {

"clientKey": CAPSOLVER_API_KEY,

"taskId": task_id

}

while True:

response = requests.post("https://api.capsolver.com/getTaskResult", json=payload)

response.raise_for_status()

result = response.json()

if result.get("status") == "ready":

return result.get("solution")

elif result.get("status") == "failed":

raise Exception(f"CapSolverタスクに失敗: {result.get('errorDescription')}")

time.sleep(3) # 3秒ごとにポーリング

# 例の使用(Amazonのチャレンジページから実際の値に置き換えてください):

# website_url = "https://efw47fpad9.execute-api.us-east-1.amazonaws.com/latest"

# aws_key = "AmazonページからのawsKeyの値"

# aws_iv = "AmazonページからのawsIvの値"

# aws_context = "AmazonページからのawsContextの値"

# aws_challenge_js = "JSチャレンジスクリプトのURL"

# proxy_string = "http://user:pass@proxy:port" # AntiAwsWafTaskを使用する場合にオプション

# try:

# task_id = create_aws_waf_task(website_url, aws_key, aws_iv, aws_context, aws_challenge_js, proxy_string)

# print(f"CapSolverタスクID: {task_id}")

# solution = get_task_result(task_id)

# aws_waf_token = solution.get("cookie")

# print(f"AWS WAFトークン: {aws_waf_token}")

# # このトークンを以降のリクエストでクッキーとして使用:

# # cookies = {'aws-waf-token': aws_waf_token}

# # response = requests.get(target_url, headers=headers, cookies=cookies)

# except Exception as e:

# print(f"CAPTCHAを解決中にエラー: {e}")ノート: CapSolverを統合する際には、Amazonのチャレンジページから必要なすべてのパラメータ(awsKey、awsIv、awsContext、awsChallengeJS)をキャプチャしてください。これらのパラメータは、405ステータスコードが返されるAmazonのチャレンジページのHTMLソースに通常含まれています。詳細については、CapSolverのAWS WAFに関するドキュメントを参照してください。

CapSolverに登録する際にはコード

CAP26を使用してください。CapSolverでボーナスクレジットを獲得できます!

画像分類AWS WAF CAPTCHA(Python例)

画像ベースのCAPTCHAの場合、CapSolverのAwsWafClassificationタスクタイプを使用できます。これは、CAPTCHA画像と関連する質問をCapSolverに送信して認識させます。

python

import requests

import base64

import time

CAPSOLVER_API_KEY = "YOUR_CAPSOLVER_API_KEY" # 実際のCapSolver APIキーに置き換えてください

def solve_aws_waf_classification(image_path, question):

with open(image_path, "rb") as f:

image_base64 = base64.b64encode(f.read()).decode("utf-8")

payload = {

"clientKey": CAPSOLVER_API_KEY,

"task": {

"type": "AwsWafClassification",

"image": image_base64,

"question": question

}

}

response = requests.post("https://api.capsolver.com/createTask", json=payload)

response.raise_for_status()

task_id = response.json().get("taskId")

get_payload = {"clientKey": CAPSOLVER_API_KEY, "taskId": task_id}

while True:

res = requests.post("https://api.capsolver.com/getTaskResult", json=get_payload)

res.raise_for_status()

data = res.json()

if data.get("status") == "ready":

return data.get("solution")

elif data.get("status") == "failed":

raise Exception(f"CapSolver分類タスクに失敗: {data.get('errorDescription')}")

time.sleep(2)

# 例の使用:

# 'captcha_image.png'がダウンロードされたCAPTCHA画像ファイルであると仮定

# question_text = "自転車が含まれるすべての画像を選択してください" # 画像に伴う質問

# try:

# result = solve_aws_waf_classification("captcha_image.png", question_text)

# print(f"Selected indices: {result}")

# # The result will be a list of indices corresponding to the selected images.

# # You would then use these indices to interact with the Amazon page.

# except Exception as e:

# print(f"Error solving image CAPTCHA: {e}")ノート: この方法では、まずアマゾンページからCAPTCHA画像と関連する質問をキャプチャする必要があります。これは、Seleniumなどのヘッドレスブラウザを使用してページをレンダリングし、CAPTCHA要素のスクリーンショットを取得する必要があります。CapSolverは認識プロセスを簡略化し、アマゾンのスクレイピングをより信頼性高くします。

ステップ4: データ抽出と処理

HTMLコンテンツを成功裏に取得した後、次のステップは構造を解析し、必要なデータを抽出することです。BeautifulSoupはこの目的に最適なライブラリです。

目的: HTML構造から特定のデータポイントを体系的に抽出すること。

操作:

- HTML構造を確認する: ブラウザの開発者ツールを使用して、アマゾンページのHTML構造を確認し、必要なデータ(例: 商品名、価格、レビュー)のCSSセレクターやXPath式を特定します。

- BeautifulSoupで解析する: HTMLコンテンツをBeautifulSoupオブジェクトに読み込み、find、find_all、selectなどのメソッドを使用してデータをナビゲートし抽出します。

python

# ... (以前のHTMLコンテンツを取得するコード)

def parse_amazon_product_page(html_content):

soup = BeautifulSoup(html_content, 'lxml')

product_data = {}

# 例: 商品タイトルの抽出

title_element = soup.select_one('#productTitle')

if title_element:

product_data['title'] = title_element.get_text(strip=True)

# 例: 商品価格の抽出

price_element = soup.select_one('.a-price .a-offscreen')

if price_element:

product_data['price'] = price_element.get_text(strip=True)

# 例: 商品評価の抽出

rating_element = soup.select_one('#acrCustomerReviewText')

if rating_element:

product_data['reviews_count'] = rating_element.get_text(strip=True)

# 必要に応じて他のデータポイントの抽出ロジックを追加します

return product_data

# 例の使用方法:

# html_content = fetch_amazon_page("https://www.amazon.com/dp/B08XYZ123")

# if html_content:

# data = parse_amazon_product_page(html_content)

# print(data)ノート: アマゾンのHTML構造は変更されることがあるため、定期的にセレクターを確認し更新する必要があります。データ品質を確保するためには、堅牢なエラー処理と検証が不可欠です。

ステップ5: データの保存と管理

抽出後、構造化された形式でデータを保存して、後の分析に備えます。一般的な形式にはCSV、JSON、またはデータベースがあります。

目的: 抽出されたデータを整理され、アクセス可能な形で永続化すること。

操作:

- 保存形式を選択する: 小規模なデータセットにはCSVまたはJSONファイルが便利です。より大規模で複雑なデータセットには、データベース(例: SQLite、PostgreSQL、MongoDB)を検討してください。

- 保存ロジックを実装する: 抽出されたデータを選択した形式に保存するコードを記述します。

python

import json

import csv

def save_to_json(data, filename):

with open(filename, 'w', encoding='utf-8') as f:

json.dump(data, f, ensure_ascii=False, indent=4)

print(f"データを{filename}に保存しました")

def save_to_csv(data, filename, fieldnames):

with open(filename, 'w', newline='', encoding='utf-8') as f:

writer = csv.DictWriter(f, fieldnames=fieldnames)

writer.writeheader()

writer.writerows(data)

print(f"データを{filename}に保存しました")

# 例の使用方法:

# all_product_data = [

# {'title': '製品A', 'price': '$10.99', 'reviews_count': '1,234件の評価'},

# {'title': '製品B', 'price': '$25.00', 'reviews_count': '567件の評価'},

# ]

# save_to_json(all_product_data, 'amazon_products.json')

# save_to_csv(all_product_data, 'amazon_products.csv', ['title', 'price', 'reviews_count'])ノート: 大量のデータを扱う際には、既存の情報を再スクレイピングせずに、保存に増分更新を適用することを検討してください。これにより、アマゾンスクレイピングプロセスが最適化されます。

アマゾンスクレイピングにおける一般的な問題のトラブルシューティング

最善の準備をしても、アマゾンスクレイピング中に問題に遭遇する可能性があります。以下に一般的な問題とその解決策を示します。

問題1: IPアドレスがブロックされるか、レートリミットに達する

説明: スクレイパーはHTTP 403(Forbidden)または429(Too Many Requests)エラーを受け取る、またはリクエストが単にタイムアウトします。

解決策:

- プロキシを導入する: 複数のIPアドレスにリクエストを分散するローテーションプロキシサービスを使用してください。これは、アマゾンスクレイピングにおけるIPブロックを回避する最も効果的な方法の一つです。ブロックを回避するための詳細については、ウェブスクレイピングでブロックされない方法を参照してください。

- 遅延を増やす: リクエスト間のtime.sleep()の期間を長くし、より多くのランダム性を導入してください。

- セッション管理: 複数のリクエストにわたってクッキーとヘッダーを保持するため、requests.Session()を使用してください。これにより、より自然なブラウジングセッションをシミュレートできます。

問題2: CAPTCHAに遭遇する

説明: アマゾンがCAPTCHAチャレンジを提示し、スクレイピングプロセスが停止します。

解決策:

- CapSolverを統合する: ステップ3で示したように、CapSolverのAPIを使用してAWS WAF CAPTCHAを自動的に解決してください。これは、アマゾンスクレイピング中に遭遇する複雑なチャレンジに対する信頼性の高い解決策です。

- ヘッドレスブラウザを使用する: 非常に複雑なJavaScriptベースのCAPTCHAの場合、ページをレンダリングし、CAPTCHAをキャプチャするためにSeleniumなどのヘッドレスブラウザ(Chrome/Firefox)を使用する必要があります。

問題3: HTML構造が変更される

説明: アマゾンがウェブサイトのHTML構造を更新したため、データ抽出ロジックが動作しなくなります。

解決策:

- 定期的なモニタリング: スクレイパーの出力とターゲットのアマゾンページを定期的に確認してください。予期せぬデータ形式や欠損フィールドに対してアラートを設定してください。

- 柔軟なセレクターを使用する: 変更されにくい一般的なCSSセレクターやXPath式を使用してください。非常に特定的または自動生成されたクラス名に依存しないでください。

- エラー処理を実装する: パースロジックの周りにtry-exceptブロックを実装し、欠損要素を円滑に処理し、後でレビューするためのエラーをログに記録してください。

問題4: ダイナミックコンテンツが読み込まれない

説明: 期待していたデータが初期HTML応答に含まれていません。

解決策:

- ヘッドレスブラウザを使用する: SeleniumやPlaywrightを使用して、JavaScriptで読み込まれたコンテンツを含む完全なページをレンダリングしてください。これにより、アマゾンスクレイピングの完全なDOMにアクセスできます。

- APIのモニタリング: ブラウザの開発者ツールでネットワークリクエストを確認し、データが内部APIコールによって読み込まれているかどうかを確認してください。その場合、そのAPIを直接呼び出すことができます。

大規模なアマゾンスクレイピングのパフォーマンス最適化

大規模なアマゾンスクレイピング作業では、効率が鍵となります。スクリーパーのパフォーマンスを最適化することで、時間とリソースを節約できます。

1. 並列処理と並行処理

ページを順番にスクレイピングする代わりに、スレッドや非同期プログラミングを使用して複数のページを同時に処理します。

- スレッド: I/Oバウンドタスク(ネットワーク応答を待つこと)にPythonのthreadingモジュールを使用してください。

- Asyncio: 非同期I/Oバウンド操作に、aiohttpとasyncioを使用すると非常に効率的です。

注意: 並列処理を使用する際は、アマゾンのレートリミットに特に注意してください。リクエストを慎重に配分し、サーバーを過負荷にしないようにしてください。ブロックをトリガーしないようにしてください。

2. 分散スクレイピング

非常に大規模なプロジェクトの場合、スクレイピングタスクを複数のマシンやクラウドインスタンスに分散する検討してください。これは、Celeryなどのメッセージブローカーを使用して管理できます。

3. スマートなリクエストスケジューリング

重要なデータのリクエストを優先し、余分なデータはピーク時間以外にスケジュールしてください。失敗したリクエストには指数バックオフを備えた堅牢なリトライメカニズムを実装してください。

4. データキャッシュ

頻繁にアクセスされるデータをローカルにキャッシュして、アマゾンへのリクエスト数を減らしてください。データが変更されていることがわかっている場合、または一定の時間間隔後に再スクレイピングしてください。

手動 vs 自動化 vs APIスクレイピングの比較概要

アマゾンスクレイピングの正しいアプローチを選ぶことは、プロジェクトの規模、複雑さ、リソースに依存します。一般的な方法の比較、およびさまざまな最高のアマゾンスクリーパーアプリケーションプログラミングインターフェース(API)の洞察を以下に示します:

| 特徴 | 手動スクレイピング(コピーペースト) | カスタム自動スクリーパー(Python) | アマゾン製品広告API(PA-API) | 第三者スクレイピングAPI |

|---|---|---|---|---|

| 努力 | 高い | 中程度から高い | 中程度 | 低い |

| コスト | 無料(時間のかかる) | 低(開発時間) | 変動(使用量に応じて) | 変動(使用量に応じて) |

| 柔軟性 | 非常に高い | 高い | 限られている(事前に定義されたデータ) | 高い |

| スピード | 非常に低い | 中程度から高い | 高い | 非常に高い |

| スクレイピング防止 | N/A(人間) | 高い(常に更新が必要) | アマゾンが処理 | 提供者が処理 |

| CAPTCHA | N/A(人間) | 高い(ソルバーの統合が必要) | N/A | 提供者が処理 |

| 法的・倫理的 | 低いリスク | 中程度のリスク(注意が必要) | 低いリスク(公式API) | 低いリスク(提供者がコンプライアンスを処理) |

| 最適な用途 | 小規模で一度限りのタスク | カスタムデータの必要、コントロール | 公式製品データ、アフィリエイト | 大規模、複雑なプロジェクト、スピード |

ノート: アマゾン製品広告API(PA-API)は、一部の製品データにアクセスする合法的な方法を提供しますが、利用可能なデータの種類や量には制限があり、独自の利用規約に準拠する必要があります。包括的なアマゾンスクレイピングには、CapSolverが提供するような、堅牢なブロック回避およびCAPTCHAソルバーメカニズムを備えたカスタム自動スクリーパーが、柔軟性とコントロールの最良のバランスを提供することが多いです。

結論

2026年のアマゾンスクレイピングは、戦略的で柔軟なアプローチが不可欠です。詳細な環境の準備と倫理的な配慮から、高度なボット回避と効率的なデータ処理に至るまで、各ステップが重要な役割を果たします。AWS WAF CAPTCHAの複雑なチャレンジを扱う専門ツールの統合は、今や必須ではなく、信頼性の高いデータ抽出を実現するための必要条件となっています。このガイドで提示されたガイドラインに従うことで、世界最大のECプラットフォームから正確でタイムリーで価値のあるインサイトを提供する、耐障害性のあるアマゾンスクレイピングソリューションを構築できます。責任あるおよび倫理的なスクレイピングの実践が、持続可能なデータ収集活動の基盤であることを忘れないでください。

アマゾンスクレイピングの能力を向上させ、CAPTCHAの課題を乗り越えたいですか?今日、CapSolverの高度なCAPTCHAソルビングサービスを探索し、データ抽出ワークフローを効率化してください。CapSolverで始める

FAQ

Q1: アマゾンスクレイピングは合法ですか?

A1: アマゾンスクレイピングの合法性は、データの種類、スクレイピングの目的、および地域の規制に応じて複雑です。一般的に、公開されているデータをスクレイピングすることはしばしば合法と見なされますが、利用規約に違反したり、プライベート/個人データをスクレイピングしたりすると法的問題につながる可能性があります。特定の状況では法的相談を受けることが重要です。ロボット.txtやレートリミットを尊重する倫理的な実践は不可欠です。

Q2: アマゾンからブロックされるのをどうやって防げますか?

A2: アマゾンスクレイピング中にブロックを避けるために、戦略の組み合わせを実装してください: ローテーションプロキシを使用し、User-Agentをローテーションし、リクエスト間にランダムな遅延を導入し、クッキーとセッションを管理し、CapSolverなどのサービスを使用してCAPTCHAを効果的に処理してください。ボットの動作に似た攻撃的なリクエストパターンを避けてください。

Q3: AWS WAF CAPTCHAとは何か、なぜ解決するのが難しいのか?

A3: AWS WAF CAPTCHAは、ウェブサイトを自動的な脅威から保護するためにアマゾンウェブサービスで使用されるセキュリティメジャーです。解決するのが難しいのは、複雑なJavaScriptチャレンジ、暗号化されたトークン、またはボットに対しては困難で人間には簡単に解決可能な画像認識タスクを含んでいるためです。CapSolverはこれらの高度なCAPTCHAをプログラム的に解決する専門性を持っています。

Q4: アマゾン製品のレビューをスクレイピングできますか?

A4: はい、公開されている製品レビューをスクレイピングすることはアマゾンスクレイピングの一般的なユースケースです。アンチスクレイピングメカニズムをトリガーしないように、リクエストの量と頻度に注意してください。常に倫理的なガイドラインとアマゾンの利用規約に準拠していることを確認してください。

Q5: CapSolverはアマゾンスクレイピングにどのように役立ちますか?

A5: CapSolverは、アマゾンスクレイピング中に頻繁に遭遇するAWS WAF CAPTCHAを自動的に解決する専門のAPIサービスを提供します。スクリーパーにCapSolverを統合することで、これらのチャレンジをプログラム的に回避し、データフローを途切れることなく保証し、スクリーピング作業の信頼性を向上させることができます。CapSolverのソリューションについて詳しく知る

コンプライアンス免責事項: このブログで提供される情報は、情報提供のみを目的としています。CapSolverは、すべての適用される法律および規制の遵守に努めています。CapSolverネットワークの不法、詐欺、または悪用の目的での使用は厳格に禁止され、調査されます。私たちのキャプチャ解決ソリューションは、公共データのクローリング中にキャプチャの問題を解決する際に100%のコンプライアンスを確保しながら、ユーザーエクスペリエンスを向上させます。私たちは、サービスの責任ある使用を奨励します。詳細については、サービス利用規約およびプライバシーポリシーをご覧ください。

もっと見る

AIはCAPTCHAを解けるか?検出と解く本当の仕組みは?

AIがCAPTCHAのチャレンジを検出および解決する方法を探索し、画像認識から行動分析に至るまでをカバーします。AIによるCAPTCHAソルバーの技術を理解し、CapSolverが自動ワークフローを支援する方法を学びます。人工知能と人間の認証の間で進化する戦いについて学びます。

Sora Fujimoto

14-Apr-2026

CAPTCHA エラー 600010: とは何かと速く直す方法

CAPTCHAエラー600010に遭遇していますか?このCloudflare Turnstileエラーの意味を理解し、ユーザーと開発者のためのステップバイステップの解決策を取得し、自動化用のCapSolver統合を含みます。

Anh Tuan

14-Apr-2026

AWS WAFの課題を拡張機能を使って解決する方法: 包括的なガイド

AWS WAF CAPTCHAとチャレンジを自動的に回避する方法をCapSolver拡張機能を使って学びましょう。このガイドでは画像認識、トークンモード、およびn8nの自動化をカバーしています。

Sora Fujimoto

13-Apr-2026

アマゾンをスクレイピングする方法:2026年 倫理的なデータ抽出とCAPTCHAの解決ガイド

2026年のアマゾンスクリーピングをこの詳細なガイドでマスターしましょう。ステップバイステップのテクニック、コード例、およびCapSolverを使用してAWS CAPTCHAを回避する方法を学び、効率的で倫理的なデータ抽出を実現します。

Emma Foster

10-Apr-2026

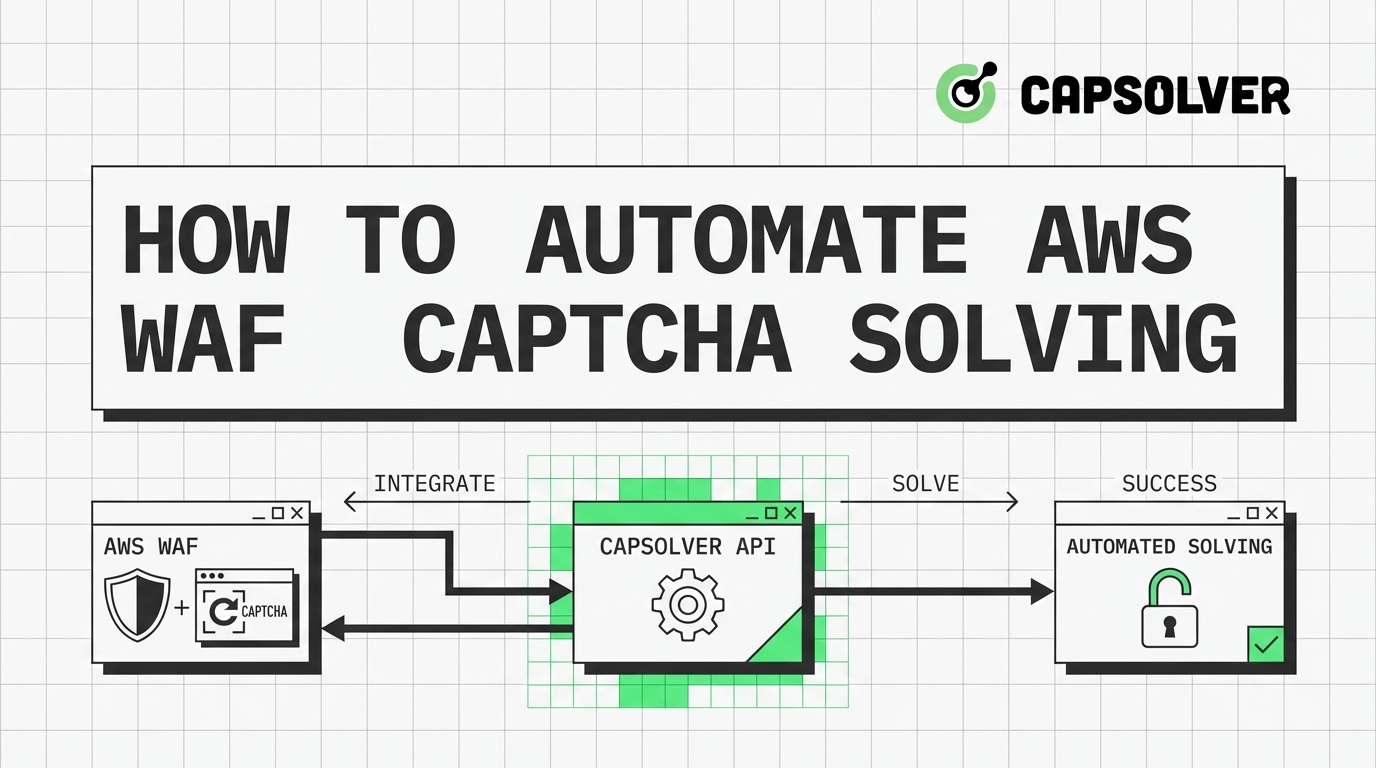

AWS WAF CAPTCHAの解決を自動化する方法:ツール、API統合 & 価格ガイド

AWS WAFのCAPTCHAを自動化する方法を学び、適切なツール、API統合手順、および総コストの明細を活用しましょう。上位のサービスを比較し、すぐに始めましょう。

Ethan Collins

10-Apr-2026

リカプチャ用の信頼性のあるキャプチャ解決API:注目すべきポイント

reCAPTCHA用の信頼性のあるCAPTCHAを解決するAPIを探していますか?速度、コスト、および成功確率に基づいて上位のプロバイダーを比較してください。あなたのオートメーションのニーズに最適なソリューションを見つけてください。

Rajinder Singh

09-Apr-2026