ReCAPTCHA dalam Pengambilan Data Ecommerce: Panduan Berfokus pada Kepatuhan

Emma Foster

Machine Learning Engineer

TL;DR

- ReCAPTCHA muncul ketika situs e-commerce membutuhkan pemeriksaan kepercayaan yang lebih kuat.

- Tangani reCAPTCHA sebagai sinyal alur kerja, bukan hanya teka-teki.

- Periksa izin, robots.txt, syarat, dan cakupan data terlebih dahulu.

- Kurangi tantangan yang tidak perlu melalui pacing dan sesi yang stabil.

- Gunakan API atau aliran resmi kapan pun tersedia.

- Gunakan CapSolver hanya untuk otomatisasi yang sah dan pekerjaan data yang diizinkan.

- Pertahankan log, batas kecepatan, dan aturan eskalasi untuk setiap crawler.

Pendahuluan

Pengelolaan reCAPTCHA dalam pengambilan data e-commerce harus dilakukan dengan proses kepatuhan terlebih dahulu. Respons yang benar bukanlah pengambilan data yang lebih agresif. Itu adalah alur kerja yang lebih bersih yang menghormati izin, mengurangi lalu lintas yang bising, dan menggunakan langkah penyelesaian yang terdokumentasi hanya ketika diizinkan. Panduan ini ditujukan untuk insinyur data, tim SEO, analis harga, dan tim pertumbuhan yang mengumpulkan data e-commerce publik secara bertanggung jawab. Ini menjelaskan mengapa reCAPTCHA muncul, kapan harus melambatkan, dan kapan CapSolver cocok dalam proses yang sah.

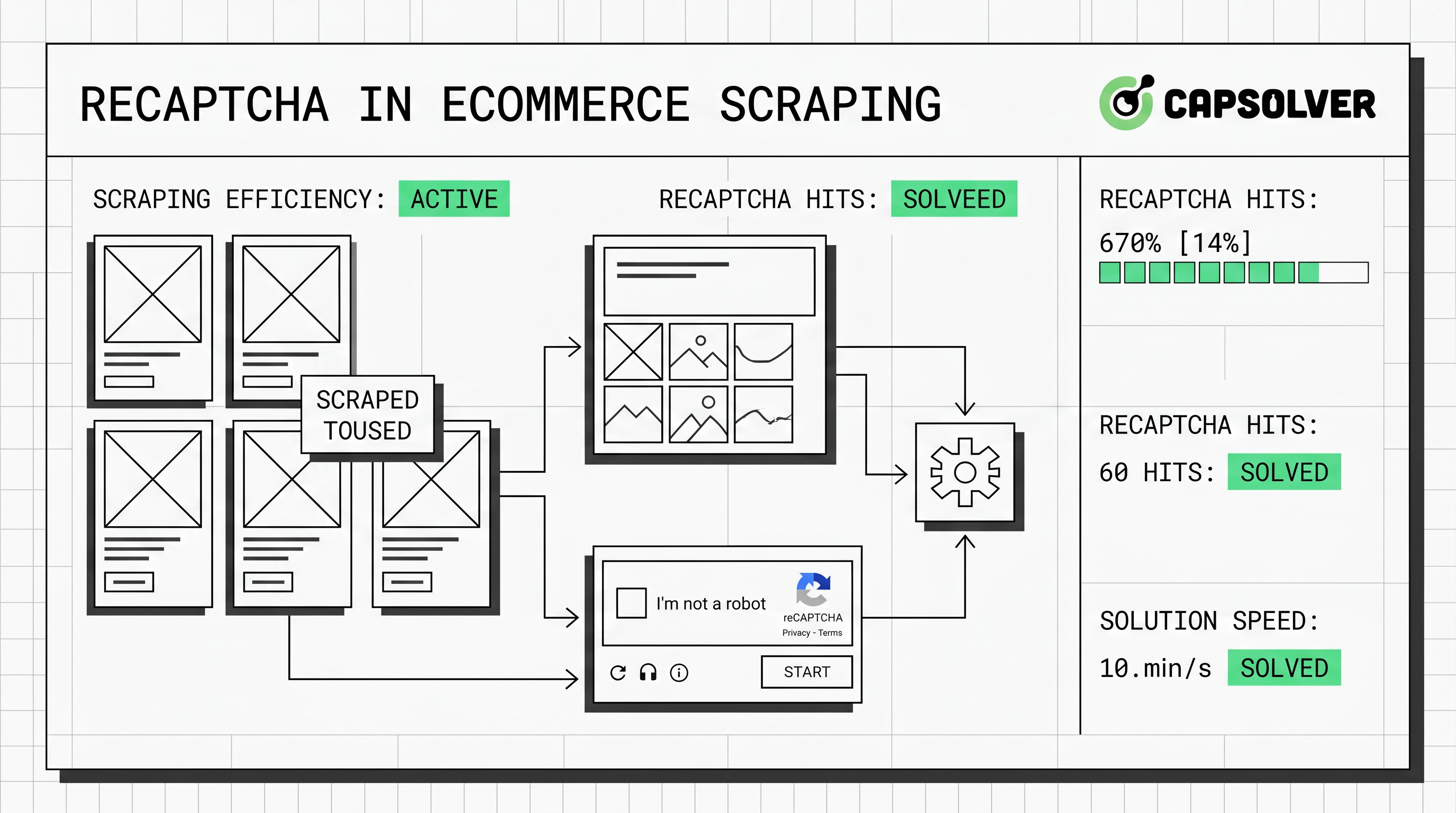

Mengapa Crawlers E-commerce Menghadapi reCAPTCHA

reCAPTCHA muncul karena situs e-commerce melindungi alur pelanggan dan bisnis yang berharga. Halaman produk, halaman pencarian, keranjang belanja, dan halaman login semuanya membawa risiko komersial. Google menggambarkan reCAPTCHA sebagai layanan yang melindungi situs web dari spam dan penyalahgunaan dengan menggunakan analisis risiko lanjutan untuk membedakan manusia dari bot melalui sinyal dan skor dokumentasi reCAPTCHA Google.

Tim e-commerce menambahkan reCAPTCHA karena lalu lintas otomatis sekarang umum. Thales dan Imperva melaporkan bahwa lalu lintas otomatis mencapai 51% dari lalu lintas web pada 2024. Mereka juga melaporkan bahwa aktivitas otomatis yang merugikan mewakili 37% dari lalu lintas internet, sementara serangan yang diarahkan melalui API mencapai 44% dari bot lanjutan Laporan Bot Jahat 2025 Imperva. Konteks ini menjelaskan mengapa situs segera menantang pola pengambilan data yang tidak biasa.

reCAPTCHA juga umum di dekat alur pembayaran dan akun. Google Cloud mengatakan bahwa Transaction Defense untuk reCAPTCHA membantu melindungi transaksi pembayaran dari serangan carding dan transaksi penipuan Transaction Defense Google Cloud. Sebuah crawler yang menyentuh halaman keranjang, checkout, atau akun menghadapi pemeriksaan yang lebih ketat dibandingkan pengawasan produk publik.

Aturan Pertama: Pastikan Data Diizinkan

Kepatuhan harus diutamakan sebelum perubahan teknis. Sebuah crawler hanya boleh mengumpulkan data publik, diizinkan, dan diperlukan. Harus menghindari halaman yang hanya bisa diakses melalui login, data pelanggan pribadi, langkah checkout, dan area yang dibatasi tanpa izin eksplisit.

Protokol Pengecualian Robots juga penting. RFC 9309 menyatakan bahwa robots.txt memberi pemilik layanan cara untuk mengontrol bagaimana crawler mengakses ruang URI, dan crawler diminta untuk menghormati aturan tersebut Protokol Pengecualian Robots RFC 9309. robots.txt bukanlah satu-satunya uji hukum. Namun, crawler yang bertanggung jawab harus mem-parsingnya sebelum menjalankannya.

Sebelum menangani reCAPTCHA, dokumentasikan empat item. Tetapkan tujuan bisnis, halaman sumber, bidang data, jalur yang diizinkan, syarat, batas permintaan, konkurensi, dan masa retensi. Ini membuat pengelolaan reCAPTCHA menjadi proses data yang teratur.

Panduan CapSolver tentang apa itu reCAPTCHA dapat membantu pemangku kepentingan memahami jenis tantangan ini.

Diagnosa Jenis reCAPTCHA

Diagnosa harus dilakukan sebelum perubahan kode. reCAPTCHA v2 sering muncul sebagai kotak centang atau tantangan visual. reCAPTCHA v3 biasanya mengembalikan skor tanpa interaksi pengguna, jadi halaman mungkin mengalami penurunan, blokir tindakan, atau meminta pemeriksaan yang lebih kuat nanti. Google mencatat bahwa reCAPTCHA v3 mengembalikan skor sehingga pemilik situs dapat memilih tindakan tanpa menampilkan tantangan kepada pengguna ringkasan reCAPTCHA v3 Google.

| Situasi | Arti yang Mungkin | Respons yang Direkomendasikan |

|---|---|---|

| Tantangan muncul setelah banyak permintaan cepat | Pola lalu lintas terlihat tidak normal | Kurangi konkurensi dan tambahkan pacing |

| Tantangan hanya muncul di halaman login atau checkout | Halaman berisiko tinggi | Berhenti kecuali secara eksplisit diizinkan |

| Tantangan muncul di halaman produk publik | Pola sesi atau permintaan perlu ditinjau | Stabilkan cookie dan kurangi lonjakan |

| Skor v3 menyebabkan halaman kosong atau rusak | Skor kepercayaan rendah | Tinjau konteks browser dan kecepatan permintaan |

| Tantangan muncul setelah redirect | Alur state tidak konsisten | Pertahankan sesi dan urutan halaman |

Diagnosa ini juga mengontrol biaya. Crawler yang lebih tenang sering memicu tantangan yang lebih sedikit dan menghasilkan data e-commerce yang lebih bersih.

Ringkasan Perbandingan

Crawler e-commerce yang berguna dimulai dengan opsi yang paling tidak mengganggu. Tabel di bawah ini membandingkan pilihan umum.

| Pendekatan | Kasus Penggunaan Terbaik | Catatan Kepatuhan | Risiko Operasional | Profil Biaya |

|---|---|---|---|---|

| API resmi atau aliran pedagang | Akses data mitra | Opsi terbaik ketika tersedia | Rendah | Prediktif |

| Pengambilan data halaman publik dengan pacing | Pemantauan produk dan harga publik | Hormati robots.txt dan syarat | Menengah | Rendah hingga menengah |

| Otomasi browser | Halaman produk yang berbasis JavaScript | Hindari alur yang dibatasi | Menengah | Menengah |

| Antrean tinjauan manusia | Pemeriksaan langka dengan nilai tinggi | Jejak audit yang kuat | Rendah | Biaya tenaga kerja yang lebih tinggi |

| Integrasi CapSolver | Otomatisasi yang sah yang menghadapi reCAPTCHA | Gunakan hanya untuk alur kerja yang sah | Menengah | Berdasarkan penggunaan |

Tabel ini menunjukkan titik praktis. reCAPTCHA harus menjadi jalur pengecualian dalam crawler yang menghormati aturan dan batasan.

Bangun Alur Kerja Pengambilan Data E-commerce yang Lebih Bersih

Alur kerja yang lebih bersih mengurangi tantangan reCAPTCHA yang tidak perlu. Mulailah dengan pemilihan halaman. Crawl hanya halaman kategori atau produk publik dan diizinkan. Hindari menambahkan item ke keranjang, mengirimkan formulir, atau membuka halaman akun kecuali bisnis memiliki akun dan izin.

Selanjutnya, kendalikan bentuk lalu lintas. Gunakan konkurensi yang moderat, aturan backoff, dan jadwal yang stabil. Situs e-commerce sensitif selama penjualan, peluncuran, dan lonjakan liburan. Crawler yang menghormati jendela tersebut lebih sedikit kemungkinannya menyebabkan beban operasional.

Pengelolaan sesi juga penting. Pertahankan cookie konsisten selama pengambilan data singkat. Jangan mencampur alur halaman yang tidak terkait dalam satu sesi. Jalur penemuan produk tidak boleh tiba-tiba meminta halaman checkout. Pola ini dapat menyebabkan munculnya reCAPTCHA.

Lacak tingkat tantangan, halaman kosong, kode HTTP, kegagalan parsing harga, dan duplikat. Tingkat reCAPTCHA yang meningkat adalah peringatan dini.

Jika tim Anda memilih antara pengambilan data langsung dan akses data resmi, artikel CapSolver tentang pengambilan data web versus API adalah tautan diskusi internal yang berguna.

Di Mana CapSolver Cocok

CapSolver cocok ketika proses otomatisasi yang sah menghadapi reCAPTCHA setelah pemeriksaan kepatuhan. Ini berguna untuk audit SEO, verifikasi iklan, dan crawler yang tidak merugikan ketika data target diizinkan. Posisi CapSolver sendiri menyatakan bahwa aktivitas ilegal, penipuan, atau penyalahgunaan dilarang, dan menyebutkan kasus audit SEO, verifikasi iklan, crawler yang tidak merugikan, dan skenario pertumbuhan bisnis sebagai penggunaan yang dimaksudkan pernyataan kepatuhan CapSolver.

Posisi ini penting. Integrasi CapSolver tidak boleh pernah menargetkan akun pribadi, langkah pembayaran, konten terbatas, atau data yang jelas dilarang.

CapSolver sangat relevan ketika crawler Anda sudah mengikuti kecepatan yang sopan tetapi masih menghadapi reCAPTCHA di halaman publik yang diizinkan. Ini dapat membantu mempertahankan alur kerja yang stabil tanpa memaksa pekerjaan manual untuk setiap tantangan. Untuk skenario e-commerce yang fokus, lihat panduan CapSolver tentang cara menyelesaikan CAPTCHA saat mengambil data e-commerce.

Referensi Kode Resmi CapSolver

Kode berikut mengikuti dokumentasi resmi CapSolver untuk reCAPTCHA v2. Jangan ubah jenis tugas atau parameter tanpa memeriksa dokumen saat ini. Gunakan ini hanya dalam alur kerja yang diizinkan dan dengan kunci API yang valid.

python

# pip install requests

import requests

import time

# TODO: atur konfigurasi Anda

api_key = "KUNCI_API_ANDA" # kunci API Anda dari CapSolver

site_key = "6Le-wvkSAAAAAPBMRTvw0Q4Muexq9bi0DJwx_mJ-" # kunci situs dari situs target Anda

site_url = "https://www.google.com/recaptcha/api2/demo" # url halaman dari situs target Anda

def capsolver():

payload = {

"clientKey": api_key,

"task": {

"type": 'ReCaptchaV2TaskProxyLess',

"websiteKey": site_key,

"websiteURL": site_url

}

}

res = requests.post("https://api.capsolver.com/createTask", json=payload)

resp = res.json()

task_id = resp.get("taskId")

if not task_id:

print("Gagal membuat tugas:", res.text)

return

print(f"Dapatkan taskId: {task_id} / Mendapatkan hasil...")

while True:

time.sleep(1) # jeda

payload = {"clientKey": api_key, "taskId": task_id}

res = requests.post("https://api.capsolver.com/getTaskResult", json=payload)

resp = res.json()

status = resp.get("status")

if status == "ready":

return resp.get("solution", {}).get('gRecaptchaResponse')

if status == "failed" or resp.get("errorId"):

print("Penyelesaian gagal! respons:", res.text)

return

token = capsolver()

print(token)Dokumentasi resmi CapSolver menyatakan untuk membuat tugas dengan createTask dan mengambil hasil dengan getTaskResult. Juga menjelaskan bahwa bidang seperti websiteURL dan websiteKey diperlukan untuk tugas. Untuk konteks implementasi yang lebih lanjut, baca panduan resmi CapSolver tentang cara menyelesaikan reCAPTCHA dalam pengambilan data web menggunakan Python.

Tukarkan Kode Bonus CapSolver Anda

Meningkatkan anggaran otomatisasi Anda secara instan!

Gunakan kode bonus CAP26 saat menambahkan dana ke akun CapSolver Anda untuk mendapatkan bonus tambahan 5% pada setiap recharge — tanpa batas.

Tukarkan sekarang di Dashboard CapSolver Anda

Kontrol Praktis untuk Produksi

Pengambilan data e-commerce produksi membutuhkan kontrol yang dapat diaudit oleh non-engineer. Buat kebijakan crawler sebelum pemasangan. Kebijakan tersebut harus menyebutkan pemilik data, domain yang diizinkan, jalur yang diizinkan, konkurensi maksimum, permintaan harian maksimum, periode retensi, dan kontak eskalasi.

Gunakan tingkat pengenalan reCAPTCHA sebagai metrik utama. Jika tingkatnya melebihi ambang batas yang ditentukan, kurangi kecepatan pengambilan data atau jeda. Jika tantangan muncul di alur yang dibatasi, hentikan pekerjaan. Jika target mengubah robots.txt atau syaratnya, tinjau crawler sebelum melanjutkan.

Pertahankan data yang sempit. Harga, ketersediaan, judul, URL gambar, dan jumlah ulasan publik mungkin valid untuk beberapa kasus bisnis. Nama pelanggan, ulasan pribadi di balik login, token keranjang belanja, dan data akun harus tetap di luar cakupan kecuali pemilik situs memberikan akses yang diizinkan.

Ini juga merupakan tempat di mana antrean cadangan membantu. Crawler dapat menyimpan halaman yang belum terselesaikan untuk tinjauan alih-alih mengulang terus-menerus. Pilihan desain ini mengurangi beban, mengurangi biaya, dan menjadikan pengelolaan reCAPTCHA lebih dapat dipertanggungjawabkan.

Untuk pola teknik tambahan, artikel CapSolver tentang tiga cara menyelesaikan CAPTCHA saat mengambil data dapat mendukung perencanaan implementasi.

Kesalahan Umum yang Harus Dihindari

Kesalahan pertama adalah memperlakukan reCAPTCHA hanya sebagai penghalang teknis. Itu sering menjadi tanda bahwa crawler terlalu luas, terlalu cepat, atau di luar alur yang dimaksudkan. Perbaiki alur kerja sebelum menambahkan alat.

Kesalahan kedua adalah mengabaikan konteks halaman. Situs e-commerce memperlakukan halaman pencarian, produk, keranjang belanja, login, dan checkout secara berbeda. Crawler Anda juga harus demikian. Pemantauan produk publik memiliki profil risiko yang berbeda dari otomatisasi akun.

Kesalahan ketiga adalah tidak memiliki log audit. Setiap peristiwa reCAPTCHA harus mencatat kelompok URL, timestamp, versi crawler, kode respons, dan tindakan yang diambil.

Kesalahan keempat adalah menggunakan kode yang usang. Implementasi reCAPTCHA berubah. Dokumentasi CapSolver harus menjadi sumber struktur kode, jenis tugas, dan bidang yang diperlukan.

Kesimpulan dan CTA

reCAPTCHA dalam pengambilan data e-commerce sebaiknya ditangani melalui tata kelola, diagnosis, dan alat yang hati-hati. Mulai dengan pemeriksaan izin, robots.txt, syarat, dan minimisasi data. Lalu kurangi tantangan yang tidak perlu dengan pacing, sesi yang stabil, dan cakupan yang terbatas. Jika reCAPTCHA masih muncul dalam alur kerja otomatisasi yang sah dan diizinkan, CapSolver dapat menyediakan lapisan penyelesaian yang praktis berdasarkan dokumentasi resmi.

Jika tim Anda membutuhkan cara terkendali untuk menangani reCAPTCHA selama pengumpulan data e-commerce, tinjau dokumentasi CapSolver, tentukan aturan kepatuhan Anda, dan uji pada halaman publik dengan volume rendah terlebih dahulu. Crawler yang bertanggung jawab hanya mengumpulkan apa yang diperlukan, berhenti ketika aturan berubah, dan meninggalkan jejak audit yang jelas.

FAQ

Apakah ilegal menangani reCAPTCHA saat pengambilan data e-commerce?

Tergantung pada izin, jenis data, yurisdiksi, dan syarat situs. Alur kerja yang lebih aman menggunakan halaman yang diizinkan publik, menghormati robots.txt, menghindari data pribadi, dan mengikuti batasan yang terdokumentasi. Tinjauan hukum bijak untuk proyek komersial.

Mengapa reCAPTCHA muncul di halaman produk?

reCAPTCHA bisa muncul ketika volume permintaan, riwayat sesi, konteks browser, atau waktu lalu lintas terlihat tidak biasa. Bisa juga muncul karena situs menerapkan perlindungan ketat pada halaman harga dan ketersediaan.

Haruskah saya menyelesaikan setiap reCAPTCHA yang saya lihat?

Tidak. Tingkat reCAPTCHA yang tinggi biasanya berarti crawler perlu ditinjau. Perlambat, kurangi cakupan, periksa jalur yang diizinkan, dan gunakan penyelesaian hanya untuk kasus pengecualian yang diizinkan.

Apakah CapSolver bisa membantu dalam pengambilan data e-commerce?

Ya, CapSolver dapat membantu ketika alur kerja otomatisasi e-commerce yang sah menghadapi recaptcha. Gunakan hanya untuk pekerjaan data yang sah, baik, dan diizinkan, serta ikuti dokumentasi resmi.

Apa yang harus saya pantau setelah penerapan?

Pantau tingkat recaptcha, kode status, kesalahan parsing, volume, kelompok jalur, dan antrian yang belum terselesaikan. Jeda crawler saat ambang batas terlampaui.

Lihat Lebih Banyak

May 08, 2026

Bagaimana Cara Kerja Ekstraksi Data AI: Penyelesaian CAPTCHA, Parsing LLM & Pipeline Data Web Terstruktur

Pelajari bagaimana ekstraksi data yang didukung AI bekerja dari pengambilan data dari web dan menyelesaikan CAPTCHA hingga pembersihan HTML, parsing LLM, dan generasi JSON terstruktur. Eksplor strategi menghindari bot, kerangka kerja ekstraksi semantik seperti AXE, dan pipa pengambilan data web AI yang dapat diskalakan.

May 07, 2026

Terbaik Framework Agen AI untuk Otomatisasi Web dan Pemecahan CAPTCHA

Bandingkan kerangka kerja agen AI terbaik untuk otomatisasi web, penyelesaian CAPTCHA, kepatuhan, dan alur kerja agen yang siap produksi pada tahun 2026.