¿Cómo dejo de obtener CAPTCHA al hacer scraping?

Aloísio Vítor

Image Processing Expert

Si alguna vez has intentado el scraping web, probablemente te hayas encontrado con CAPTCHAs: esas molestas pruebas de "demuéstrame que eres humano" que bloquean las solicitudes automatizadas. En esta guía, compartiré estrategias prácticas para minimizar las interrupciones de CAPTCHA y te mostraré cómo manejarlas cuando aparezcan. ¡Vamos a sumergirnos!

¿Por qué aparecen los CAPTCHAs durante el scraping web? 🤖

Los CAPTCHAs están diseñados para bloquear bots, lo que significa que tu scraper podría ser marcado si:

- Envías demasiadas solicitudes demasiado rápido.

- Tus solicitudes carecen de encabezados de navegador o cadenas de agente de usuario realistas.

- El sitio web detecta patrones de IP sospechosos (por ejemplo, solicitudes repetidas desde la misma IP).

Consejo profesional: Comienza imitando el comportamiento humano: ralentiza tus solicitudes, rota los agentes de usuario y usa proxies. Pero si los CAPTCHAs siguen apareciendo, necesitarás una solución más robusta.

Cómo resolver CAPTCHAs automáticamente usando solucionadores de CAPTCHA

Cuando la evitación no es suficiente, servicios como Capsolver pueden automatizar la resolución de CAPTCHA. Así es como funciona:

Ejemplo: Resolviendo reCAPTCHA v2 con Python

python

# pip install requests

import requests

import time

api_key = "YOUR_API_KEY" # Reemplaza con tu clave Capsolver

site_key = "" # Del sitio objetivo

site_url = "" # Tu URL objetivo

def solve_captcha():

payload = {

"clientKey": api_key,

"task": {

"type": "ReCaptchaV2TaskProxyLess",

"websiteKey": site_key,

"websiteURL": site_url

}

}

response = requests.post("https://api.capsolver.com/createTask", json=payload)

task_id = response.json().get("taskId")

# Recuperar el resultado

while True:

time.sleep(3)

result = requests.post("https://api.capsolver.com/getTaskResult", json={"clientKey": api_key, "taskId": task_id})

status = result.json().get("status")

if status == "ready":

return result.json()["solution"]["gRecaptchaResponse"]

elif status == "failed":

print("Error al resolver el CAPTCHA")

return None

captcha_token = solve_captcha()

print(f"Token CAPTCHA resuelto: {captcha_token}")Cómo funciona:

- La API de Capsolver crea una tarea para resolver el CAPTCHA en tu sitio objetivo.

- Devuelve un token que puedes inyectar en tu scraper para omitir el CAPTCHA.

¿Te enfrentas a fallos repetidos al resolver completamente los captchas mientras haces scraping web?

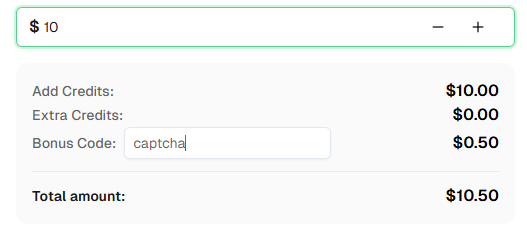

Reclama tu Código de bonificación para las mejores soluciones de captcha -CapSolver: CAPTCHA. Después de canjearlo, obtendrás un bono adicional del 5% después de cada recarga, Ilimitado

Scraping sin CAPTCHA: Un ejemplo más simple

No todos los sitios usan CAPTCHA. Vamos a raspar books.toscrape.com, un sandbox sin CAPTCHA:

python

import requests

from bs4 import BeautifulSoup

url = "http://books.toscrape.com/"

response = requests.get(url)

soup = BeautifulSoup(response.text, "html.parser")

# Extraer títulos y precios de libros

for book in soup.select("article.product_pod"):

title = book.h3.a["title"]

price = book.select(".price_color")[0].get_text()

print(f"Título: {title}, Precio: {price}")Por qué funciona:

Este sitio no tiene medidas anti-bot, pero siempre verifica el robots.txt de un sitio web antes de realizar scraping.

Identificando tipos y parámetros de CAPTCHA 🔍

Antes de resolver un CAPTCHA, necesitas saber su tipo (por ejemplo, reCAPTCHA v2, hCaptcha). Usa herramientas como la Guía de identificación de CAPTCHA de Capsolver para:

- Detectar el proveedor de CAPTCHA.

- Encontrar los parámetros necesarios como

sitekeyopageurl.

Ejemplos de parámetros para reCAPTCHA v2:

websiteKey: "6Le-wvkSAAAAAPBMRTvw0Q4Muexq9bi0DJwx_mJ-"websiteURL: La URL de tu página objetivo.

Mejores prácticas para evitar CAPTCHAs por completo

- Ralentiza: Agrega retrasos entre solicitudes con

time.sleep(). - Rota proxies: Usa servicios como Nst Proxy para evitar bloqueos de IP.

- Usa encabezados realistas: Imita el

User-AgentyAccept-Languagede un navegador.

Preguntas frecuentes: Manejando CAPTCHAs durante el Scraping

1. ¿Cómo funcionan los solucionadores de CAPTCHA?

Utilizan una combinación de IA y trabajadores humanos para resolver CAPTCHAs y devolver tokens para la automatización.

2. ¿Se pueden automatizar todos los CAPTCHAs?

La mayoría de los tipos comunes (reCAPTCHA, hCaptcha) se pueden resolver, pero los avanzados requieren métodos más sofisticados.

4. ¿Cuál es la manera más fácil de evitar CAPTCHAs?

- Usa navegadores headless como Puppeteer o Playwright para simular interacciones humanas

- Usa proxies móviles

- Usa la última versión del agente de usuario

- Usa un cliente TLS

- Usa los encabezados correctos / orden de encabezados de la versión del agente de usuario

Reflexiones finales

Los CAPTCHAs son un obstáculo, pero no un callejón sin salida. Combina prácticas de scraping inteligentes con herramientas como Capsolver para minimizar las interrupciones. ¡Feliz scraping! 🚀