Cara Mengatasi Hambatan Penyedotan Web: Metode Praktis yang Efektif

Ethan Collins

Pattern Recognition Specialist

TL;Dr:

- Pahami Mekanisme: Situs web menggunakan pelacakan IP, pemindaian browser, dan analisis perilaku untuk mengidentifikasi dan memblokir skrip otomatis.

- Terapkan Rotasi: Gunakan proxy residensial yang berputar dan string User-Agent yang beragam untuk meniru pola lalu lintas manusia.

- Atasi Tantangan: Integrasikan alat khusus untuk menyelesaikan CAPTCHA dan mengelola sistem deteksi bot yang kompleks secara efisien.

- Jaga Etika: Selalu ikuti panduan robots.txt dan terapkan penurunan kecepatan permintaan untuk mempertahankan dampak rendah pada server target.

Pendahuluan

Web scraping telah menjadi komponen penting dalam pengambilan keputusan berbasis data modern, namun lingkungan pengumpulan data otomatis semakin menantang. Seiring dengan penerapan keamanan yang lebih canggih, mempelajari cara mengatasi pemblokiran web scraping tidak lagi menjadi keuntungan—ini menjadi keharusan bagi proyek ekstraksi yang sukses. Panduan ini memberikan gambaran menyeluruh tentang mengapa pemblokiran terjadi, teknologi di balik mekanisme deteksi, dan strategi paling efektif serta etis untuk memastikan scraper Anda tetap beroperasi. Baik Anda seorang pengembang yang membangun crawler kustom atau seorang analis data yang mengawasi operasi skala besar, memahami metode praktis ini akan membantu Anda mempertahankan akses konsisten terhadap informasi yang Anda butuhkan.

Memahami Sifat Pemblokiran Web Scraping

Untuk mengelola hambatan secara efektif, seseorang harus terlebih dahulu memahami apa yang mereka hadapi dan mengapa mereka ada. Pemblokiran web scraping adalah tindakan defensif yang diterapkan oleh situs web untuk mencegah skrip otomatis mengakses kontennya. Langkah-langkah ini sering merupakan bagian dari strategi keamanan yang lebih luas yang dirancang untuk melindungi sumber daya server, mencegah pencurian kekayaan intelektual, atau mempertahankan integritas data pengguna.

Menurut data industri terbaru, lalu lintas otomatis menyumbang bagian signifikan dari semua permintaan web, menyebabkan banyak platform menerapkan filter agresif. Anda dapat menemukan detail lebih lanjut tentang tren global dalam laporan Data Lalu Lintas Bot Statista. Ketika server mendeteksi pola yang menyimpang dari perilaku manusia standar, ia mungkin merespons dengan menampilkan CAPTCHA, memperlambat koneksi, atau memberikan pemblokiran IP lengkap. Memahami cara mengatasi pemblokiran web scraping dalam skenario ini sangat penting untuk menjaga kelangsungan data.

Latar Belakang Teknis: Cara Mekanisme Deteksi Bekerja

Sistem keamanan modern tidak bergantung pada satu faktor untuk mengidentifikasi bot. Sebaliknya, mereka menggunakan kombinasi teknik untuk membangun profil risiko untuk setiap permintaan yang masuk.

1. Pelacakan Berbasis IP

Ini adalah lapisan pertahanan yang paling dasar. Server memantau jumlah permintaan yang datang dari satu alamat IP dalam jangka waktu tertentu. Jika frekuensinya melebihi ambang batas yang ditentukan, IP tersebut akan dicurigai. Inilah sebabnya mengapa mengetahui cara mengatasi pemblokiran web scraping pada tingkat jaringan sangat penting. Data center sering diblokir secara proaktif karena jarang digunakan oleh pengunjung manusia yang sah.

2. Pemindaian Browser

Di luar alamat IP, situs web dapat mengumpulkan berbagai informasi dari lingkungan browser Anda. Ini termasuk resolusi layar, font yang terinstal, zona waktu, dan spesifikasi perangkat keras. Jika detail ini tampak tidak konsisten atau terlalu "bersih" (biasa ditemukan pada browser tanpa GUI), sistem mengidentifikasi permintaan sebagai otomatis.

3. Analisis Perilaku

Platform yang canggih melacak bagaimana pengguna berinteraksi dengan halaman. Manusia bergerak mouse dalam pola yang tidak linear, menghabiskan waktu untuk membaca konten, dan mengklik elemen dengan ritme yang berbeda. Sebaliknya, skrip mungkin langsung melompat ke URL dan mengekstrak data dalam milidetik. Setiap penyimpangan dari perilaku manusia yang diharapkan memicu alarm merah. Deteksi berbasis perilaku ini adalah salah satu tantangan terberat ketika mencari cara mengatasi pemblokiran web scraping.

Jenis-Jenis Tantangan CAPTCHA yang Umum

Ketika sistem ragu namun mencurigakan, ia sering menampilkan CAPTCHA. Memahami jenis-jenis ini sangat penting untuk mengetahui cara mengatasi pemblokiran web scraping secara efektif.

| Jenis CAPTCHA | Deskripsi | Logika Deteksi Utama |

|---|---|---|

| Pengenalan Gambar | Pengguna harus memilih objek tertentu (misalnya, lampu lalu lintas) dari grid. | Menguji kemampuan memproses data visual dan mengidentifikasi pola klik yang mirip manusia. |

| CAPTCHA Tak Terlihat | Berjalan di latar belakang tanpa interaksi pengguna. | Menganalisis lingkungan browser dan perilaku historis untuk menetapkan skor risiko. |

| Tantangan Teks/Matematika | Membutuhkan menyelesaikan persamaan sederhana atau mengetik teks yang terdistorsi. | Mengandalkan kesulitan OCR (Optical Character Recognition) untuk bot lama. |

| Puzzle/Slider | Pengguna harus menyeret bagian untuk menyelesaikan gambar. | Fokus pada gerakan fisik kursor dan waktu tindakan. |

Metode Praktis untuk Mengatasi Pemblokiran Web Scraping

Menerapkan strategi teknis yang tepat dapat secara signifikan mengurangi kemungkinan terdeteksi. Berikut adalah metode paling efektif yang digunakan oleh profesional saat ini.

Gunakan Proxy Residensial yang Berputar

Karena pemblokiran IP umum, menggunakan kumpulan proxy residensial adalah salah satu cara terbaik untuk menghindari pemblokiran IP dan memastikan tingkat keberhasilan yang tinggi. Proxy ini adalah fondasi dari praktik terbaik web scraping. Berbeda dengan IP data center, IP residensial terkait dengan koneksi internet rumah nyata, membuatnya jauh lebih sulit dibedakan dari pengguna sah. Dengan memutar IP ini untuk setiap beberapa permintaan, Anda dapat mendistribusikan lalu lintas dan tetap di bawah radar.

Kelola Header dan User-Agent Permintaan

Setiap permintaan HTTP mencakup header yang memberi tahu server tentang klien. Kesalahan umum adalah menggunakan header perpustakaan default seperti "python-requests/2.25.1". Sebaliknya, Anda seharusnya menggunakan berbagai string User-Agent nyata. Merujuk pada Dokumentasi User-Agent MDN untuk memahami cara mengstruktur ini dengan benar. Pastikan header Anda mencakup bidang seperti "Accept-Language" dan "Referer" untuk meniru sesi penjelajahan nyata.

Terapkan Penurunan Kecepatan Permintaan

Kecepatan sering kali menjadi petunjuk terbesar untuk bot. Dengan menambahkan penundaan acak antara permintaan Anda, Anda dapat meniru perilaku penjelajahan manusia. Teknik ini, yang dikenal sebagai throttling, mencegah Anda membanjiri server target dan mengurangi kemungkinan memicu alarm pembatasan kecepatan. Menerapkan praktik terbaik web scraping ini akan membantu Anda mempertahankan akses ke data sensitif sambil juga membantu Anda menghindari pemblokiran IP selama operasi skala besar.

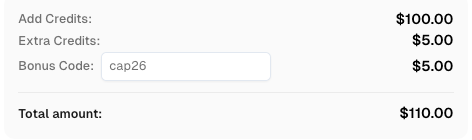

Gunakan kode

CAP26saat mendaftar di CapSolver untuk mendapatkan kredit tambahan!

Selesaikan CAPTCHA Secara Otomatis

Bahkan dengan header dan proxy yang sempurna, Anda akan akhirnya menghadapi tantangan. Ini adalah saat layanan khusus menjadi tak ternilai harganya. Misalnya, CapSolver menyediakan API yang kuat untuk menyelesaikan berbagai jenis tantangan, seperti ReCaptcha dan FriendlyCaptcha, memastikan alur kerja otomatis Anda tetap tidak terganggu. Alat ini adalah inti dari cara mengatasi pemblokiran web scraping di lingkungan modern.

Jika Anda menggunakan alat seperti cURL atau Python untuk otomasi Anda, Anda dapat mengintegrasikan solusi berdasarkan alur kerja umum ini:

- Kirim Tugas: Kirim detail CAPTCHA (site key, URL) ke layanan.

- Dapatkan Solusi: Poll API menggunakan ID Tugas hingga solusi siap.

- Kirim Token: Gunakan token yang dikembalikan untuk melewati tantangan di situs target.

Berikut adalah contoh sederhana berdasarkan dokumentasi CapSolver untuk mengirim tugas:

json

{

"clientKey": "YOUR_API_KEY",

"task": {

"type": "ReCaptchaV2TaskProxyLess",

"websiteURL": "https://www.example.com",

"websiteKey": "6LcR_okUAAAAAPYrPe-z_bx1oYxq6zz_S0vO49zV"

}

}Ringkasan Perbandingan: Teknik Scraping

Untuk membantu Anda memilih pendekatan yang tepat, berikut adalah perbandingan metode umum.

| Metode | Efektivitas | Kompleksitas Implementasi | Biaya |

|---|---|---|---|

| Header Dasar | Rendah | Rendah | Gratis |

| Proxy Data Center | Sedang | Sedang | Rendah |

| Proxy Residensial | Tinggi | Sedang | Sedang |

| Browser Tanpa GUI | Tinggi | Tinggi | Tinggi (Sumber Daya) |

| Pemecah CAPTCHA | Essensial | Rendah | Rendah |

Pertimbangan Etis dan Kepatuhan

Ketika mempelajari cara mengatasi pemblokiran web scraping, sangat penting untuk menekankan praktik etis. Pengumpulan data otomatis harus selalu dilakukan dengan cara yang menghormati ketentuan situs web target dan kesehatan server. Selalu periksa file robots.txt dari domain untuk melihat area yang dibatasi. Mengikuti praktik terbaik web scraping ini tidak hanya melindungi Anda secara hukum tetapi juga memastikan kelangsungan sumber data Anda.

Bagi yang mencari alat lanjutan, menjelajahi alat ekstraksi data terbaik dapat memberikan wawasan tambahan tentang membangun sistem yang tangguh.

Transisi Alami ke Solusi

Seiring dengan perkembangan teknologi deteksi bot, kompleksitas mempertahankan scraper meningkat. Banyak pengembang menemukan bahwa mengapa otomasi web terus gagal pada CAPTCHA sering disebabkan oleh kurangnya strategi penanganan khusus. Menggunakan pemecah CAPTCHA terbaik memungkinkan Anda fokus pada analisis data daripada terus memperbaiki skrip yang rusak. Dengan mengintegrasikan layanan profesional ini ke dalam stack Anda, Anda dapat memastikan tingkat keberhasilan tinggi bahkan di platform yang paling dilindungi.

Kesimpulan

Menguasai cara mengatasi pemblokiran web scraping membutuhkan pendekatan berlapis yang menggabungkan presisi teknis dengan tanggung jawab etis. Dengan memahami logika deteksi, menerapkan manajemen proxy yang kuat, dan menggunakan layanan penyelesaian khusus, Anda dapat membangun saluran data yang andal. Ingatlah bahwa tujuannya bukan hanya melewati penghalang tunggal, tetapi menciptakan sistem yang berkelanjutan yang menghormati ekosistem digital sambil memberikan wawasan yang dibutuhkan bisnis Anda.

FAQ

1. Mengapa saya masih diblokir meskipun menggunakan proxy?

Pemblokiran dapat terjadi karena pemindaian browser atau header yang tidak konsisten. Pastikan User-Agent Anda sesuai dengan lokasi yang dipersepsikan proxy dan bahwa Anda tidak mengungkap IP asli melalui WebRTC.

2. Apakah ilegal untuk melewati pemblokiran web scraping?

Kepatuhan hukum tergantung pada yurisdiksi Anda dan jenis data yang Anda kumpulkan. Secara umum, scraping data yang tersedia publik adalah ilegal, tetapi Anda harus menghormati hukum hak cipta dan perlindungan data pribadi.

3. Seberapa sering saya harus memutar User-Agent saya?

Lebih baik menggunakan User-Agent baru untuk setiap sesi baru atau setiap beberapa ratus permintaan, terutama jika Anda juga memutar IP Anda.

4. Apakah browser tanpa GUI dapat mencegah semua pemblokiran?

Meskipun membantu, browser tanpa GUI seperti Puppeteer atau Playwright masih dapat dideteksi melalui properti tertentu. Anda harus menggunakan "stealth" plugin untuk menyembunyikan sifat otomatisnya.

5. Apa cara yang paling hemat biaya untuk menyelesaikan CAPTCHA?

Menggunakan layanan pemecah berbasis API seperti CapSolver biasanya lebih hemat biaya daripada membangun model ML sendiri atau menggunakan tenaga manual, karena menawarkan kecepatan dan akurasi tinggi dengan biaya per tugas yang rendah.

Lihat Lebih Banyak

The Other CAPTCHAMay 15, 2026

API Pemecahan CAPTCHA Cepat untuk Alur Kerja Otomasi

API penyelesaian CAPTCHA cepat untuk otomatisasi: bandingkan alur kerja token, tantangan yang didukung, pemeriksaan latensi, dan integrasi CapSolver yang bertanggung jawab.

The Other CAPTCHAApr 03, 2026

Penjelasan Waktu Respons API Penyelesaian CAPTCHA: Faktor Kecepatan dan Kinerja

Pahami waktu respons API penyelesaian CAPTCHA, dampaknya terhadap otomatisasi, dan faktor kunci yang memengaruhi kecepatan. Pelajari cara mengoptimalkan kinerja dan memanfaatkan solusi efisien seperti CapSolver untuk penyelesaian CAPTCHA yang cepat.