ウェブスクリーピングのしくみをステップバイステップで解説

回答

ウェブスクラビングは、自動化されたHTTPリクエストをサイトに送信し、そのHTMLコンテンツを取得して、そのコンテンツを解析して特定のデータポイントを抽出することによって動作します。抽出された情報は、JSONやCSVなどの形式に構造化されて、保存、分析、または自動化ワークフローに使用されます。

詳細な説明

ウェブスクラビングは、ブラウザがウェブページを読み込む方法の自動化バージョンです。ユーザーがサイトにアクセスするとき、ブラウザはサーバーにHTTPリクエストを送信し、HTMLを受信して視覚的にレンダリングします。スクラッパーは最初の2つのステップを再現しますが、ページをレンダリングする代わりに、HTML構造からの生データの抽出に焦点を当てます。

プロセスは、ターゲットURLにリクエストを送信することから始まります。サーバーはHTML、JavaScript参照、および場合によってはページに埋め込まれたJSONを返します。静的ウェブサイトの場合、このHTMLにはほとんどのデータがすでに含まれています。動的ウェブサイトの場合、JavaScriptを実行して最終的なDOMをレンダリングするためのヘッドレスブラウザなどの追加ツールが必要になることがあります。ページが読み込まれると、スクラッパーはDOMツリーを分析し、CSSパスやXPath式などのセレクターを使用して関連する要素を検索します。

必要な要素を特定した後、スクラッパーはテキスト、属性、または価格、製品名、メタデータなどの構造化された値を抽出します。最後に、クリーン化されたデータは正規化され、データベース、スプレッドシート、またはAPIなどの構造化された形式に保存されて、後続の使用のために準備されます。この全体のプロセスはスケール可能で、複数のウェブソースから大規模なデータセットを収集できます。

解決策 / 方法

- HTTPリクエストフェッチング: requestsやaxiosなどのライブラリを使用して、ターゲットページから効率的に生のHTMLを取得します。

- HTMLパースとDOM抽出: BeautifulSoupやCheerioなどのパーサーを使用して、セレクターを使用してDOMをナビゲートし、対象の要素を抽出します。

- 自動化ツールによる動的レンダリング: JavaScriptを多く使用するウェブサイトの場合、ヘッドレスブラウザが実際のユーザー行動をシミュレートします。より高度なセキュリティ管理環境では、CapSolverなどのソリューションが、自動データ抽出ワークフロー中のCAPTCHAチャレンジの処理を補助します。

最適な実践 / ポイント

効果的なウェブスクラビングには、ウェブサイトの構造を尊重し、不要なリクエストを最小限に抑えることが必要です。常にセレクターを最適化して、脆弱なスクラビングロジックを避けるようにし、ネットワークの障害に対するリトライメカニズムを実装し、サーバー負荷を減らすためにスロットリングを適用してください。大規模なスクラビングシステムの場合、構造化されたパーシングと耐障害性のある自動化フレームワークを組み合わせることで、より安定性とスケーラビリティが確保されます。

👉 関連:

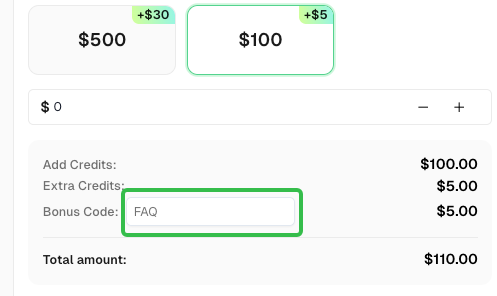

CapSolverで登録する際、コード

FAQを使用して、再充電時に追加の5%のボーナスを取得してください。

CapSolver FAQ — capsolver.com