Mejores alternativas a la biblioteca Python Requests para la automatización HTTP

Respuesta

Las alternativas más comunes a la biblioteca Python Requests son clientes HTTP modernos como HTTPX y AIOHTTP, junto con marcos de scraping de nivel superior como Scrapy. Estas herramientas admiten ejecución asíncrona, mejor escalabilidad y un mejor rendimiento para cargas de trabajo de escaneo web de alto volumen y automatización de APIs en comparación con el manejo sincrónico tradicional.

Explicación Detallada

La biblioteca Requests es ampliamente utilizada debido a su simplicidad y diseño sincrónico estable, pero se vuelve limitante al manejar cargas de trabajo HTTP a gran escala o concurrentes. En el I/O tradicional bloqueante, cada solicitud espera una respuesta antes de que la siguiente comience, lo que reduce significativamente la eficiencia bajo tráfico intenso.

Las tareas modernas de automatización web, como la extracción de datos, la agregación de APIs o los flujos de trabajo impulsados por bots, suelen requerir manejar cientos o miles de conexiones simultáneas. Es aquí donde los clientes HTTP asíncronos se vuelven esenciales. Las bibliotecas como HTTPX y AIOHTTP aprovechan el marco asyncio de Python para permitir una comunicación de red no bloqueante, mejorando el rendimiento y la respuesta.

Además, los sitios web modernos utilizan con frecuencia sistemas de gestión de seguridad, limitación de tasas y desafíos CAPTCHA para restringir el tráfico automatizado. Esto introduce complejidad adicional para los clientes HTTP, haciendo necesarias herramientas avanzadas y estrategias de mitigación en los sistemas de scraping en producción.

Soluciones / Métodos

- Requests (Enfoque Sincrónico): Ideal para llamadas simples a APIs, prototipos y scripts de bajo volumen donde no se requiera concurrencia.

- HTTPX (Cliente Híbrido Moderno): Admite solicitudes sincrónicas y asíncronas con soporte para HTTP/2, lo que lo convierte en una ruta de actualización flexible para aplicaciones en evolución.

- AIOHTTP (Async de Alta Concurrency): Optimizado para sistemas de scraping a gran escala y pipelines en tiempo real donde el rendimiento y la concurrencia sean críticos. Para entornos protegidos por CAPTCHA o sistemas de gestión de seguridad, soluciones como CapSolver pueden ayudar a automatizar la resolución de desafíos y mantener un flujo ininterrumpido de datos.

Mejores Prácticas / Consejos

Al elegir un cliente HTTP, prioriza la arquitectura sobre la conveniencia de la sintaxis. Si tu carga de trabajo es pequeña y secuencial, Requests es suficiente. Para sistemas escalables, prefieren bibliotecas con enfoque asíncrono como HTTPX o AIOHTTP. Además, diseña tu pipeline de scraping con lógica de reintentos, rotación de proxies y estrategias para manejar CAPTCHA, para garantizar la estabilidad frente a las defensas web modernas.

👉 Relacionado:

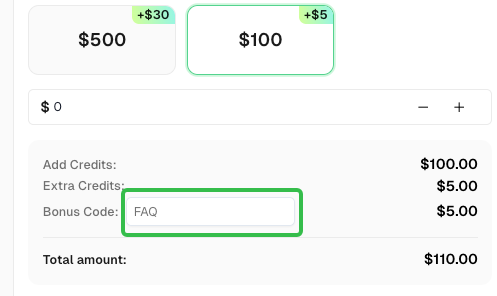

Usa el código

FAQal registrarte en CapSolver para recibir un 5% adicional en recarga.

FAQ de CapSolver - capsolver.com