Bagaimana Cara Kerja Web Scraping Dijelaskan Langkah Demi Langkah

Jawaban

Pengambilan data web bekerja dengan mengirimkan permintaan HTTP otomatis ke sebuah situs web, mengambil konten HTML-nya, lalu menganalisis konten tersebut untuk mengekstrak titik data tertentu. Informasi yang diekstrak disusun dalam format seperti JSON atau CSV untuk penyimpanan, analisis, atau alur kerja otomatis.

Penjelasan Detail

Pengambilan data web pada dasarnya adalah versi otomatis dari cara browser memuat halaman web. Ketika pengguna mengunjungi situs, browser mengirimkan permintaan HTTP ke server, menerima HTML, dan merender halaman tersebut secara visual. Sebuah scraper meniru dua langkah pertama tetapi alih-alih merender halaman, fokusnya adalah mengekstrak data mentah dari struktur HTML.

Proses dimulai dengan mengirimkan permintaan ke URL tujuan. Server merespons dengan HTML, referensi JavaScript, dan terkadang JSON yang tertanam di halaman. Untuk situs web statis, HTML ini sudah berisi sebagian besar data. Untuk situs web dinamis, alat tambahan seperti browser tanpa antarmuka (headless browser) mungkin diperlukan untuk menjalankan JavaScript dan merender DOM akhir sebelum ekstraksi. Setelah halaman dimuat, scraper menganalisis pohon DOM dan menemukan elemen yang relevan menggunakan selektor seperti jalur CSS atau ekspresi XPath.

Setelah mengidentifikasi elemen yang diperlukan, scraper mengekstrak teks, atribut, atau nilai terstruktur seperti harga, nama produk, atau metadata. Akhirnya, data yang telah dibersihkan dinormalisasi dan disimpan dalam format terstruktur seperti basis data, spreadsheet, atau API untuk penggunaan lebih lanjut. Seluruh proses ini dapat dijalankan dalam skala besar untuk mengumpulkan dataset besar dari sumber web yang berbeda.

Solusi / Metode

- Pengambilan Permintaan HTTP: Gunakan perpustakaan seperti requests atau axios untuk mengirimkan permintaan GET/POST dan mengambil HTML mentah dari halaman tujuan secara efisien.

- Pemrosesan HTML & Ekstraksi DOM: Gunakan parser seperti BeautifulSoup atau Cheerio untuk menelusuri DOM dan mengekstrak elemen yang ditargetkan menggunakan selektor.

- Penggunaan Alat Otomasi untuk Rendering Dinamis: Untuk situs web yang berat JavaScript, browser tanpa antarmuka (headless browser) meniru perilaku pengguna nyata. Dalam lingkungan manajemen keamanan yang lebih canggih, solusi seperti CapSolver dapat membantu menangani tantangan CAPTCHA selama alur kerja ekstraksi data otomatis.

Praktik Terbaik / Tips

Pengambilan data web yang efektif memerlukan penghormatan terhadap struktur situs dan meminimalkan permintaan yang tidak perlu. Selalu optimalkan selektor untuk menghindari logika pengambilan data yang rapuh, implementasikan mekanisme ulang untuk kegagalan jaringan, dan gunakan pengaturan kecepatan untuk mengurangi beban server. Untuk sistem pengambilan data skala besar, menggabungkan pemrosesan terstruktur dengan kerangka otomasi yang tangguh memastikan stabilitas dan skalabilitas yang lebih baik.

👉 Terkait:

- Hukum Pengambilan Data Web

- Pengambilan Data Web dengan Curl Cffi

- Tantangan Pengambilan Data Web dan Cara Mengatasinya

- Pengambilan Data Web Tanpa Terblokir

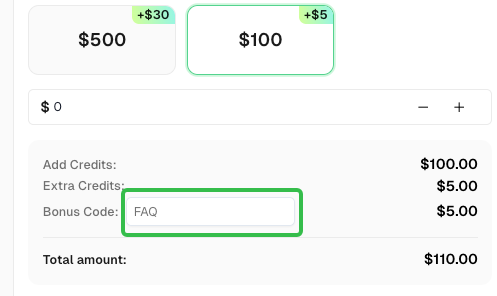

Gunakan kode

FAQsaat mendaftar di CapSolver untuk mendapatkan tambahan 5% bonus pada recharge Anda.

FAQ CapSolver — capsolver.com